Inhalt

ToggleWer kein Geschicht' hat,

der auch kein Gesicht hat.

Botho Strauß

Zum Thema

In diesem Jahr feiert ein epochemachendes Buch sein Centennium alias seine Hundertjahrfeier. Und niemand feiert mit. Nicht einmal Leute, die auf Professuren sitzen, die ihre Existenz Licht und Gesundheit verdanken. In den drei Ausgaben des Buchs Human Factors in Lighting von Peter Boyce findet man zwar den Namen Luckiesh, aber keine Spuren von seinem Buch Light and Health, obwohl dem gleichen Thema unter dem gleichen Titel ein ganzes Kapitel gewidmet ist. Selbst John N. Ott, der mit dem Buch „Health and Light“ (1973, über 3 Millionen verkaufte Exemplare) viel Furore gemacht hat, nennt ihn nicht.

Die Veranstaltung, die 2026 die BAuA veranstaltet, Licht und Gesundheit (mehr hier), hat ihren Namen nicht diesem Buch zu verdanken. Den Titel „Licht und Gesundheit“ haben meine Frau und ich gefunden. Beide haben Lichttechnik studiert, aber nie etwas von dem Buch gehört gehabt. Es hat aber mehrere Jahrzehnte des 20. Jahrhunderts geprägt. Gemeint ist das Buch Light And Health - A Discussion Of Light and Other Radiations In Relation To Life and Health von Matthew Luckiesh und A.J. Pacini. Es hat es nicht verdient, in den Annalen der Geschichte zu verschwinden.

Erbschaft von Luckiesh und Pacini

Künstliches Habitat für Menschen

Zunächst die wichtigste Erbschaft des Buches: Der Glaube, dass man mit dem künstlichen Licht in Innenräumen ein gesundes Habitat für Menschen schaffen kann. Sogar meine Technische Universität, die einst das humanistische Studium für Techniker zur Pflicht gemacht hatte, um später den Fachbereich Umwelttechnik zu gründen, vermittelte uns denselben Glauben.

Zwar fehlte dem Konzept von Luckiesh noch die künstliche Belüftung, aber sie war längst erfunden. So träumten Ende der 1920er viele von unterirdischen Städten, die von den Launen der Natur unabhängig wären. Luckiesh und Pacini repräsentierten die Idee des Scientific Management – die Idee, dass man den Menschen wie eine Maschine durch physische Parameter (Licht, Temperatur) optimieren kann. Ein technokratischer Ansatz, der unendlich vielen Menschen ihre Leiden verschlimmert hat. Das In den 1970ern aufgekommene Sick Building Syndrome geht auf diesen Ansatz zurück.

Das Ganze wurzelt tief im Ingenieurs-Ethos. Im frühen 20. Jahrhundert entstand die Überzeugung, dass Ingenieure aufgrund ihrer Sachkenntnis besser zur Steuerung der Gesellschaft geeignet seien als Politiker oder Unternehmer. Heute zeigt sich dieser Ansatz oft in der Einsetzung von „Expertenregierungen“ in Krisenzeiten oder in der wachsenden Rolle von Algorithmen und Datenanalysen in der Verwaltung. Es lohnt sich, zu den Wurzeln dieser Denke zurückzukehren, um unsere heutige Welt zu verstehen. Das künstliche Licht stellt sich aus der Sicht des Buches Genesis 2.0 - Die Schöpfung der elektrischen Sonne als einer der wichtigsten Autoren der Industriegeschichte dar und ist daher ein hervorragendes Beispiel zum Lernen.

Die Besonderheit der Erbschaft

Die Besonderheit Erbschaft von Luckiesh und Pacini verdankt man den beruflichen Hintergründen der beiden Autoren: Luckiesh war Physiker und Direktor des Lighting Research Laboratory (1924–1949) von General Electric. Pacini war Vieles: Wissenschaftler und Biochemiker, Röntgenologe und Mediziner. Er war ein Pionier in der Erforschung von Vitaminen, insbesondere von Vitamin E. Pacini war ein Experte für die medizinische Anwendung von UV-Strahlen (Aktinotherapie). So kann man ihr Erbe auch so bezeichnen: Licht dient nicht nur dazu, dass wir etwas sehen können, sondern es beeinflusst den gesamten menschlichen Organismus – psychisch wie physisch. Auf diese Formel sollte die CIE und die technisch orientierte Lichttechnik erst rund 100 Jahre später kommen.

Das stimmt nicht ganz. Denn ihre im Jahre 2022 offiziell gewordene Erkenntnis, dass man bei den Wirkungen des Lichts auf den Menschen auch gesundheitliche Wirkungen einbeziehen müsse, geht von sichtbarem Licht allein aus, hingegen haben Luckiesh und Pacini bereits im Jahre 1926 in dem Titel ihres Buches alle Strahlungen eingeschlossen. So waren sie vor einem Jahrhundert der CIE voraus, die Licht als sichtbare Strahlung definiert und die gesundheitlichen Wirkungen der optischen Strahlung außerhalb des sichtbaren Bereichs zwar nicht ignoriert, aber der Photobiologie zuschreibt.

Das Konzept des “integrative” lighting wurde mit ISO/CIE TR 21783 Light and lighting — Integrative lighting — Non-visual effects im Jahr 2022 eingeführt und definiert: “lighting integrating both visual and non-visual effects, and producing physiological and/or psychological benefits upon humans” Es berücksichtigt nur ein “Licht”, also auch ein Tageslicht, das nie ein Mensch erleben kann. Luckiesh und Pacini sahen die Sache 100 Jahre zuvor ganzheitlich und ganzheitlicher.

Zu den Autoren Luckiesh und Pacini

Die Autoren von Light and Health gehörten zu den geistigen Vätern der Hawthorne Experimente (hier), die in einem großen Trauma für alle Geisteswissenschaften endeten, dem Hawthorne Effekt. Luckiesh befürwortete die Experimente, weil er den Nachweis erreichen wollte, dass besseres Licht auch zu einer besseren Leistung führte. Der Nachweis misslang.

Dieses unerwartete Ergebnis führte andererseits zu der Human Relations Bewegung, weil mit diesen Experimenten – wenn auch unbeabsichtigt und unfreiwillig – nachgewiesen wurde, dass Arbeitsbeziehungen eine größere Rolle spielen können als die physikalische Umwelt.

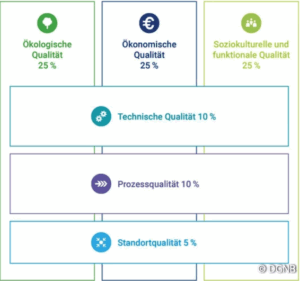

Das Letztere ist indes bis heute umstritten. Viele Menschen sind unfähig, zu begreifen, dass zwischenmenschliche Beziehungen offensichtlich wirksame Faktoren wie Licht in ihren Wirkungen übertreffen können. Den Streit will ich nicht kommentieren, da er seit fast einem Jahrhundert geführt wird. Ein Kommentar mehr wird vermutlich nicht viel ändern. Wichtiger sind die heute noch spürbaren Folgen für die Lichttechnik. Sie musste über die ganzen Jahrzehnte Wege finden, um ihre wichtigste Größe, die Beleuchtungsstärke, zu ihrer vermeintlichen Wertschätzung zu führen. Kann es sein, dass ein fundamentaler Effekt, die Stärke Beleuchtung der Sehaufgabe, keine Rolle bei der Arbeitsleistung spielt? Dass die erst im Jahr 2021 definierte Lichtqualität keinen Bezug zur Beleuchtungsstärke zeigt, hat immerhin der heutige Vorsitzende der LiTG in einer wissenschaftlichen Publikation bestätigt (Lichtqualität – Ein Prozess statt einer Kennzahl, download)

Naturgemäß kann es nicht sein, dass physikalische Bedingungen wie Licht bei der Arbeitsleistung keine Rolle spielen. Das Problem liegt nur im experimentellen Nachweis. Den Hawthorne Effekt kann man aber auch heute ganz leicht nachweisen. Wenn man in einem Betrieb die Arbeitsleistung bestimmter Menschen oder Gruppen feststellen will, z.B. durch die Menge und Qualität der erzeugten Produkte, werden viele unsichtbare Geister das Ansinnen versuchen zu vereiteln. Das müssen nicht einmal die beteiligten Arbeitnehmer sein. Auch deren Chefs, Betriebsleiter, Personalvertreter u.ä. haben was dagegen, dass die Arbeitsleistung durch Dritte erfasst wird. Wohlgemerkt, es sind nicht nur die Arbeiter, die verhindern wollen, dass man ihre Leistung misst, sondern potenziell alle Angehörigen eines Betriebs, das nicht autonom ist.

Unerwartete Folgen der Hawthorne-Studies für die Lichttechnik

Aufgrund des Fehlen eines methodischen Nachweises, dass eine gute Beleuchtung die Arbeitsleistung verbessert, hat sich in der Branche etwas eingebürgert, was ich „Legendenbildung und Märchenerzählung – Ungewöhnliche Aktivitäten für Ingenieure“ (hier) bezeichnet habe. Einige Beiträge in diesem Blog wie „Die längste Märchenstunde“ (hier) beziehen sich darauf. In Deutschland mischte einst sogar der Staat mit. Dieser wollte in den 1930ern die Leistung des deutschen Arbeiters mit besserem Licht steigern (hier). Zu diesem Behuf wurde der damalige Vorgänger der LiTG, Deutsche Lichttechnische Gesellschaft (DLTG), unter staatliche Kontrolle gestellt und eine Behörde mit dem Titel Schönheit der Arbeit gegründet. Nach dem Krieg wurde die LiTG zwar „befreit“, aber die staatlichen Eingriffe in die Beleuchtung endeten damit nicht. Die Berufsgenossenschaften betreiben bis heute eine, teils fragwürdige, Politik, meist auf der Basis der Vorgaben aus der Industrie, die eine sehr erfolgreiche Lobbyarbeit betreibt. Die Gewerbeaufsicht kann die Inbetriebnahme eines Gebäudes untersagen, wenn sie eine Abweichung der Beleuchtung von den Normen feststellt. So geschehen mit einem Gebäude mit 150,000 m2 Mietfläche in Frankfurt. Nicht etwa weil die Beleuchtung schlecht wäre. Sie war von einem renommierten Lichtdesigner für dieses Objekt als hochwertige Beleuchtung geschaffen worden.

Licht , das fensterlose Bauten ermöglichte

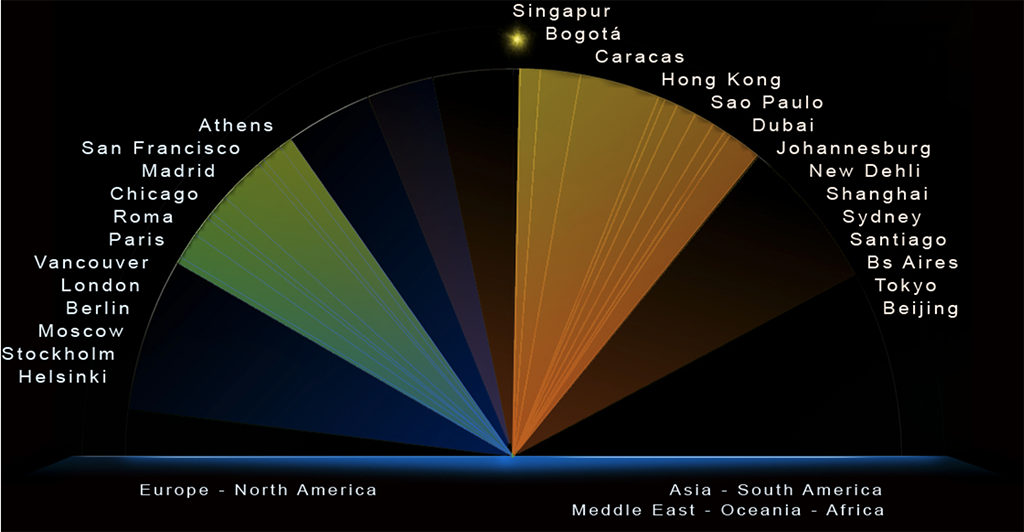

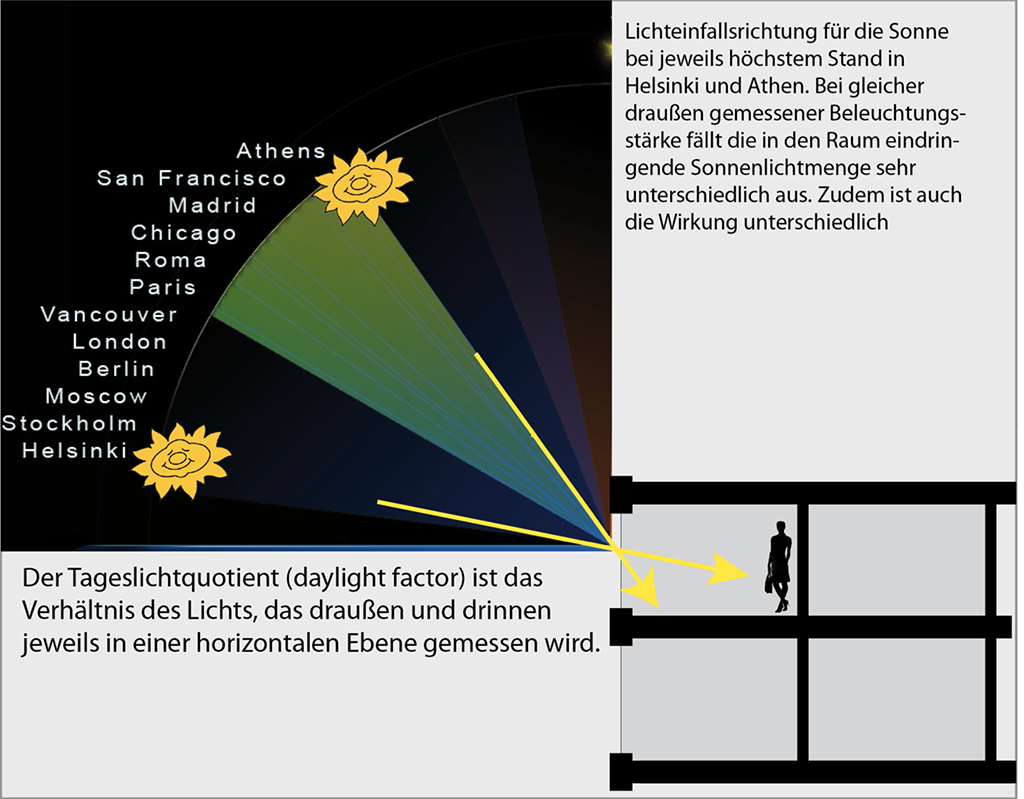

Während in Deutschland auch andere Kräfte wirksam waren, die die Architektur daran hinderten, dem von Luckiesh und Mitdenkern vorgezeichneten Weg folgend, weitgehend künstliche Arbeitsumgebungen wie auch Schulen zu schaffen, verlief die Geschichte in den USA anders. Dort war der Drang, sich mit Technik von der Natur unabhängig zu machen, viel erfolgreicher, weil man in den USA in großen Gebieten ohne Klimatisierung kaum arbeiten kann. Zudem würde ein starker Tageslichteinfluss mit einer Zufuhr von Wärme verbunden sein, die man wieder mühsam aus den Räumen entfernen muss. So war es etwa 1965 so weit, Wissenschaftler stellten in Frage, ob man Fenster überhaupt brauche. Dass man das Tageslicht hinsichtlich seiner gesundheitlichen Wirkungen nicht nur erfolgreich elektrisch nachbilden, sondern sogar stets übertreffen kann, wollte ja Luckiesh nachgewiesen haben.

Das Thema Bauen ohne Fenster wurde nicht etwa unverbindlich auf Tagungen u.ä. diskutiert. Es war das Thema eines großen Forschungsprojektes unter der Leitung eines Architekturprofessors. Das School Environments Research Project der Universität Michigan, Chicago, ermunterte den Professor für Architektur C. T. Larson dazu, den Einfluss fensterloser Klassenräume für Grundschüler zu untersuchen. Das Projekt von Larson war eine groß angelegte Studie, an der 30 Forscher teilnahmen, davon 24 Professoren für Architektur, Ingenieurwissenschaften, Medizin, Meteorologie, Kindermedizin, Umweltmedizin, Psychologie, Pädagogik, Lernpsychologie et. al. Zu den Beratern gehörten u.a. ein Anthropologe, ein Informationsspezialist und diverse Schuldirektoren. (C. Theodore Larson, The effect of windowless classrooms on elementary school children, University of Michigan, Ann Arbor: University of Michigan, Architectural Research Laboratory, 1965).

Am Ende erreichte die „Message“ die deutsche Arbeitsmedizin. Ein Sonderkongress mit dem Thema “Der fensterlose Arbeitsraum” führte zu dieser fatalen Schlussfolgerung: „Menschen in fensterlosen Fabrikationsräumen haben - sofern diese in arbeitshygienischer Sicht optimal gestaltet sind - keine gesundheitsschädigenden Einflüsse zu befürchten.“. Man stelle sich vor, ein Kongress von Medizinern bezeichnet das Licht der Sonne für nicht relevant für die Hygiene! Dabei war es einer ihrer großen vor rund 150 Jahren, der die hygienische Wirkung von Licht besonders hervorgehoben hatte. Im August 1890 hatte Robert Koch in seinem berühmten Vortrag „Ueber bakteriologische Forschung“ die Beziehung zwischen Hygiene und Licht thematisiert War der überhaupt Arbeitsmediziner? Eigentlich nicht, er war Mikrobiologe, Hygieniker und Forscher. Robert Koch begründete die moderne Bakteriologie und Mikrobiologie, indem er spezifische Krankheitserreger wie den der Tuberkulose identifizierte und mit seinen Postulaten die wissenschaftliche Basis für die Infektionsforschung und Hygiene schuf. 75 Jahre danach erzählen seine Nachfahren, die seine Lehre in der Arbeitswelt anwenden sollen, die Sonne für den Arbeitnehmer entbehrlich.

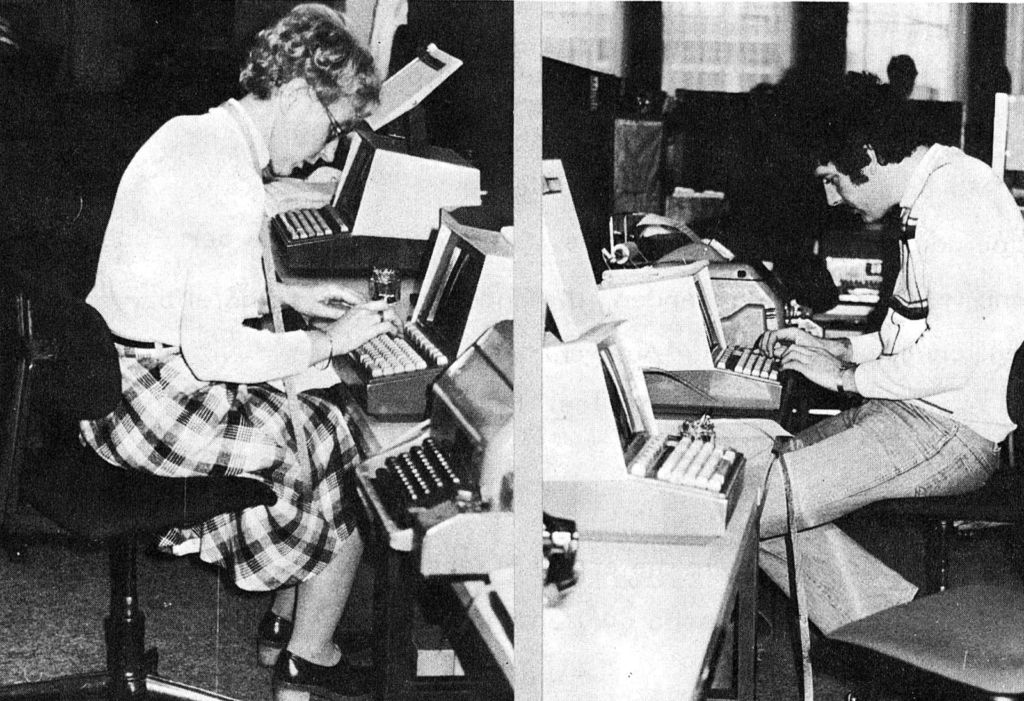

Das vorläufig letzte Ereignis in Deutschland war eine Sondertagung der LiTG in Karlsruhe in 1971 „Auge-Licht-Arbeit“. Dort ging der spätere Vorsitzende des Normenausschusses (künstliche) Beleuchtung, H.-J. Hentschel, sogar noch weiter: „Hohe Ansprüche an die Beleuchtung, wie sie in der künstlichen Beleuchtung gestellt werden, können nicht befriedigt werden.“ Da war Luckiesh gerade 4 Jahre tot.

Licht und Gesundheit, die zweite …

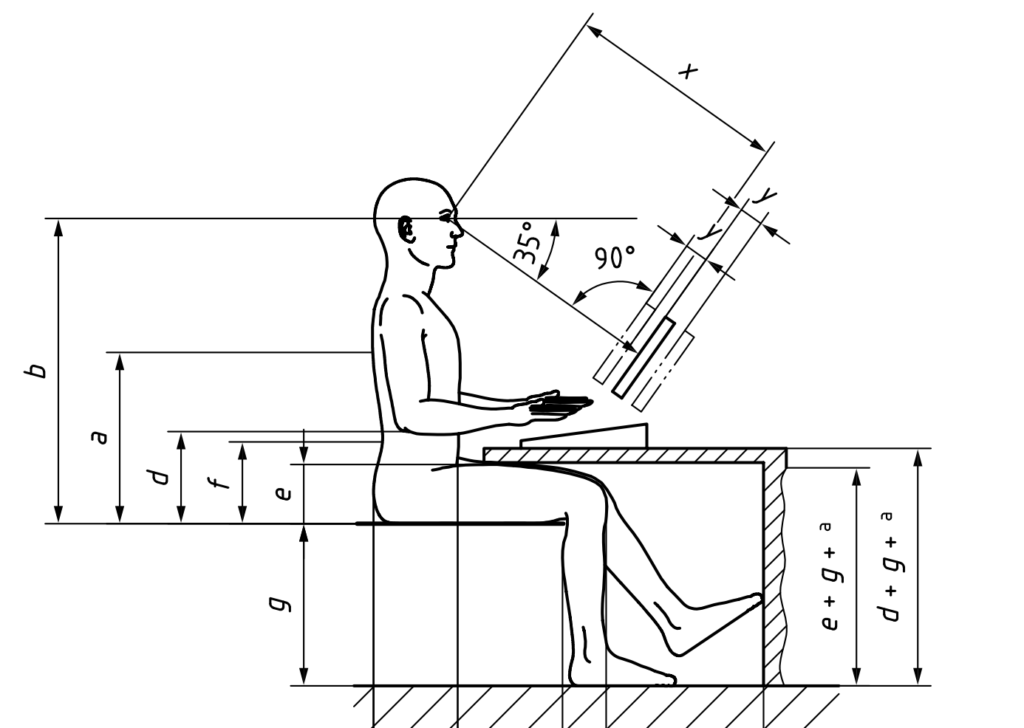

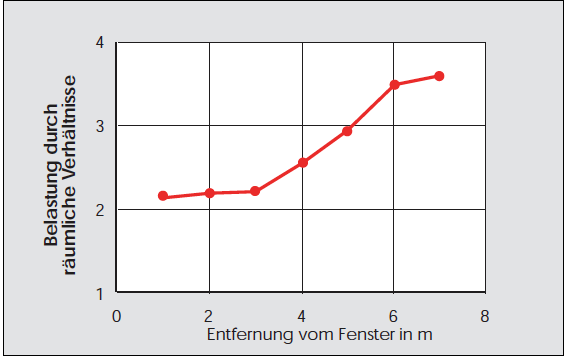

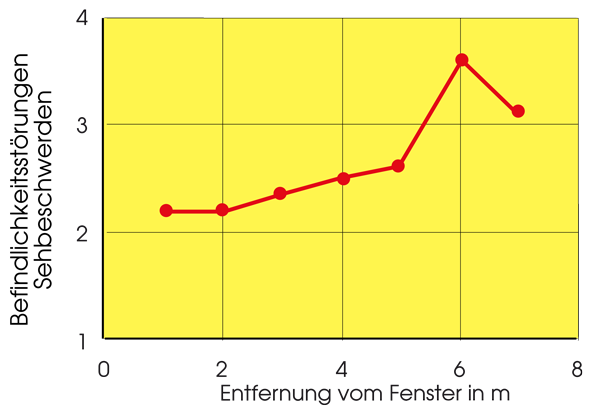

Der Kongress von 1971 war der Hintergrund der Studie „Licht und Gesundheit“, die 1990 die Bedeutung des Tageslichts in der Beleuchtung von Büros für die Gesundheit des Menschen nachwies. Beabsichtigt war das keineswegs, weil ich als Techniker keinen Unterschied zwischen einer elektrischen Beleuchtung einer Sehaufgabe und einer Tageslichtbeleuchtung derselben zu erkennen vermochte. Vermutlich gibt es auch keinen Unterschied, so man es schafft, alle physikalischen Bedingungen ähnlich zu gestalten. Dem stehen aber zwei Fakten entgegen: Man kann keine künstliche Beleuchtung schaffen, die alle relevanten physikalischen Eigenschaften einer Tageslichtbeleuchtung nachbildet. Viel wichtiger ist aber der zweite Unterschied: Die Beleuchtung der Sehaufgabe ist nicht die wichtigste Aufgabe der Beleuchtung einer Arbeitsstätte.

Um dieses zu verstehen, hätte ich keine großen Studien anstellen müssen, es hatte Prof. Bodmann im Jahre 1960 ermittelt, als ich noch ein kleiner Gymnasiast war. Er hatte ermittelt, dass eine Beleuchtung mit 50 lx für fast alle Büroaufgaben vollkommen ausreiche, dass der Mensch aber eine helle Umgebung brauche. Deswegen hat er über 400 lx empfohlen. (Bodmann, H.W.: Beleuchtungsniveaus und Sehtätigkeit, Int. Licht Rundschau, 1962, S. 4; Bodmann, H.W.: Kriterien für optimale Beleuchtungsniveaus, Lichttechnik, 15. Jahrg. Nr. 1/ 1963, S. 24-26). Somit waren optimale Beleuchtungsniveaus, zumindest für die Büroarbeit, nach der Raumhelligkeit zu bestimmen und nicht nach der Sehaufgabe.

Es gibt noch einen dritten Punkt, der wichtig ist: die Dynamik des natürlichen Lichts. Lange Zeit kam niemand auf die Idee, dass etwas wirklich Alltägliches, der ständige Wechsel des Tageslichts und, dazu überlagert, dessen wetterbedingten Änderungen eine entscheidende Rolle spielen würden. Zwar kannte man bereits im 18. Jahrhundert, Dunkelkammerexperiment mit der Mimose von Jean Jacques d’Ortous de Mairan, dass die Pflanze einen eigenen, inneren Taktgeber besitzen müsse. Auch Charles Darwin (1880) wusste von der Erblichkeit der biologischen Rhythmen. Aber erst 1959 prägte der deutsch-amerikanische Chronobiologe Franz Halberg den Begriff „circadian“. Er gilt als einer der Gründerväter der modernen Chronobiologie. In der Lichttechnik ist das „dynamische“, also veränderliche Licht, erst seit den 1990er Jahren ein Begriff. Philips war eines der ersten Unternehmen, das „Dynamic Lighting“ als feststehenden Marketing- und Fachbegriff für Bürolösungen einführte. Die hierzu führenden Arbeiten wurden in den 1980ern in Philipslabor durchgeführt.

Vermutlich der erste Autor, der sich gegen konstantes Licht stellte, war der Ophthalmologe Weston. Auf die Idee, dass das Wechselhafte des natürlichen Sonnenlichts ein Qualitätsmerkmal sein könnte, vielleicht sogar das entscheidende, war für viele Jahrzehnte weder Luckiesh noch irgend ein Ingenieur gekommen. Nur der Augenmediziner Weston hat in einem der wichtigsten Artikel der Lichttechnikgeschichte darauf hingewiesen: "Befürworter des in Mode gekommenen Helligkeits-Engineering haben empfohlen, dass ideale visuelle Bedingungen dann herrschen, wenn eine gleichförmige Helligkeit im Gesichtsfeld hergestellt wird. Es gibt nichts in der Physiologie, was diese Vorstellung unterstützt. (...) Es gibt eine inhärente Eigenschaft der modernen künstlichen Beleuchtung, die nicht anstrebenswert ist. Das ist ihre Konstanz – eine vielgelobte Eigenschaft, von der behauptet wird, sie begründe die Überlegenheit der künstlichen Beleuchtung gegenüber der wechselhaften natürlichen Beleuchtung. Jedoch, auch wenn Konstanthaltung von Bedingungen für einige kritische Sehaufgaben anstrebenswert ist, Konstanz ist eine nervtötende und abstumpfende Eigenschaft der künstlichen Beleuchtung." (Weston, 1954, Weston, H.C.: Visual Fatigue, Illuminating Engineering, Vol 49(2), S. 63-76).

Luckiesh` Konflikt mit der heutigen Lichttechnik

Luckiesh würde in einem entscheidenden Punkt mit der heutigen Lichttechnik in Konflikt stehen: Für ihn gehörte die UV-Strahlung zum Licht. Deswegen gehörte diese zur Beleuchtung der Innenräume. Luckiesh, vielmehr Pacini, hatte den damaligen Glauben an den heilenden Strahlen der Sonne entweder mitverursacht oder übernommen. Great God Tan, der Gott der gebräunten Haut, ist bis heute unvergessen. Millionen Menschen legen sich zum Bräunen in die Sonne und schlagen die Warnungen der Hautärzte in den Wind. Luckiesh Firma baute spezifische Lampen, die das Gefühl von einem sonnenbeschienenen Strand in die Wohnzimmer trugen. Leider bereits physikalisch unvollkommen. So eine Zimmerdecke gibt doch keinen guten Himmel ab. Dennoch bleibt der Verdienst, die Rolle des UV in den Vordergrund gespielt zu haben, auch wenn man heute in Innenräumen keine UV-Strahlung erzeugen möchte.

Luckiesh und die Vollspektrumlampe

Luckiesh' Lehre kann man bei den Gläubigen der Vollspektrumlampe wiederfinden. Der wichtigste Protagonist dieser Lampe wollte nicht nur ein sonnenlichtähnliches sichtbares Spektrum, sondern auch UV-A und etwas UV-B mit der von ihm erfundenen Lampe erzeugen. Ein gesundes Lichtspektrum muss laut Ott zwingend UV-A- und UV-B-Anteile enthalten, da diese über die Augen und die Haut das endokrine System (Drüsen und Hormone) stimulieren. Ott stand mit der gesamten Branche auf dem Kriegsfuß, weil die nach seinen Ansichten gebaute Lampe 60% mehr Strom für die gleiche Beleuchtungsstärke brauchte. Bei den Studien zu Licht und Gesundheit hat mein Institut die Beleuchtung mit Vollspektrumlampen nicht untersucht. Hierfür gab es zwei Gründe. Der praktische Grund war, dass es relative wenige Installationen gab. Um generalisierbare Wirkungen festzustellen, brauchte ich aber große Probandenzahlen. Die größeren Hindernisse lagen allerdings woanders: Wer Vollspektrumlampen installiert, glaubt an deren Wirkung. So kann es sein, dass eine festgestellte Wirkung ein Placebo-Effekt ist. Es kann auch sei, dass die Benutzer diese Lampen brauchen, warum auch immer.

Ich habe meine Interpretation der Literatur zu Vollspektrumlampen zwei Mal ausführlich dokumentiert. Das erste Mal in 2001 auf der Basis der Arbeit von Veitch, J. A.; McColl, S. L. „A Critical examination of perceptual and cognitive effects attributed to full-spectrum fluorescent lighting “ (download und mehr Artikel hier ), das zweite Mal in 2010, nachdem eine große Welle von Forschung zu Licht und Gesundheit von der Entdeckung eines neuen Empfängers im Auge ausgelöst hatte: Vollspektrumlicht – Eine kritische Würdigung der Literatur, download hier). Kurz danach in 2011 ist der Forschungsbericht „Stand von Wissenschaft und Technik bei neuen Beleuchtungstechnologien am Arbeitsplatz“ (Çakir G., Çakir A., Kramer H., Schierz C. & Wunsch A. (2011)) im Auftrag der BAuA entstanden, der alle Wirkungen von Licht auf den Menschen analysierte.

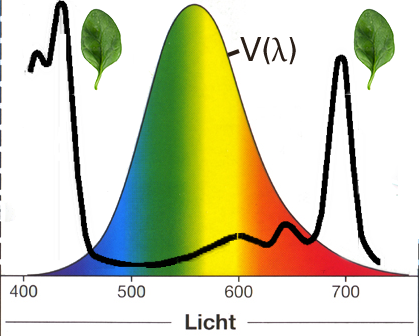

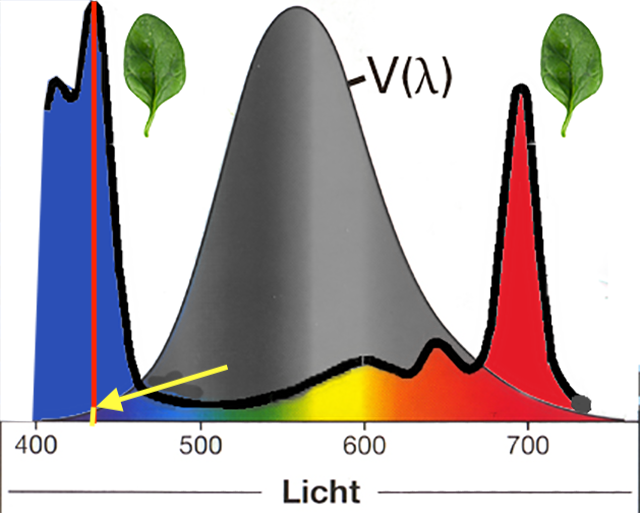

Vermutlich würden wissenschaftliche Experimente viele Wirkungen von Vollspektrumlicht bestätigen, also von Lampen, deren Spektrum den Vorstellungen von Luckiesh und Pacini entsprachen. Hingegen versuchte die Lichttechnik, z.B. die LiTG, nachzuweisen, dass das Spektrum keine Rolle spielte, sofern die Lichtfarbe stimmte: „Ein Zusammenhang biologischer Funktionen mit der spektralen Zusammensetzung des Lichtes ist aber bei gleicher Hellempfindung und Lichtfarbe nach heutigen Erkenntnissen nicht gegeben.” (in Stellungnahme zur Frage der Verträglichkeit des Leuchtstofflampenlichtes”, Technisch-wissenschaftlicher Ausschuss der LiTG, E. Hartmann und W. Müller-Limmroth, Juli, 1981). Wenn heute zu allen lichttechnischen Größen jeweils eine angegeben wird, die die physiologische Wirkungen beschreibt, also zur Beleuchtungsstärke E eine melanopische Emel, bzw. Ev. kann man ruhig von einem späten Triumpf von Luckiesh und Pacini sprechen.

Die Lampen, die einst die „heilenden Strahlen“ der Sonne in die Wohnungen tragen sollten, gibt es nicht mehr, auch die Nachfolger, die Höhensonne) ist aus den Wohnungen verschwunden. Aber man geht immer noch in Solarien, die die Namen der Antiken Heilstätten tragen auch wenn sich de Strahlenschutzexperten die Haare raufen. Gebräunte Haut ist gesund, ein Erbe der 1920er Jahre.

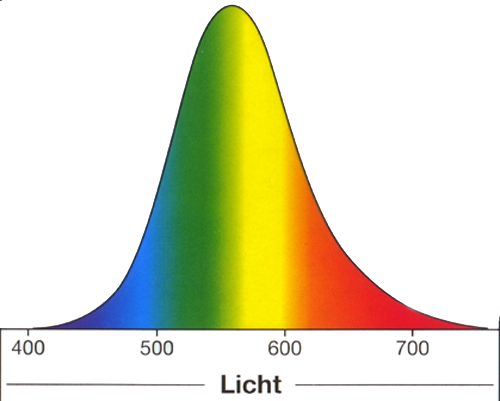

Wo wir noch liefern müssen - Farbwiedergabe

Ein wichtiges Ziel von Luckiesh bleibt auch im 21. Jahrhundert unerreicht, die natürliche Farbwiedergabe des Tageslichts. Luckiesh postulierte, der Mensch bräuchte diese als Lebensgrundlage. Die Sonne könne sie nur zeitweilig erzeugen, seine elektrische Sonne aber zuverlässig und immer wenn gewünscht. Beim Sehen sei es nicht nur wichtig, dass man Objekte sehe, man müsse auch Farben sehen, z.B. um beim Obstkauf die richtigen Früchte auszusuchen. Da sich das menschliche Sehen unter dem Licht der Sonne entwickelt habe, könne ein Mensch ohne Tageslicht Farben nicht korrekt unterscheiden. So leitete Luckiesh einen Bedarf für sein künstliches Tageslicht ab, für ihn Qualität und nicht mehr nur Quantität.

Ein Jahrhundert später sind wir von diesem Anspruch weiter entfernt als jemals zuvor. Der Grund ist nicht eine fehlende Erkenntnis über die Farbwiedergabe. Diese ist vorhanden. Genauso real existierend ist ein Erbstück, der Farbwiedergabeindex nach dem „Test-Farben-Verfahren“ von 1965. Der allgemeine Farbwiedergabeindex (CRI oder Ra) wurde erstmals im Jahr 1965 von der Internationalen Beleuchtungskommission (CIE) offiziell empfohlen und genormt. Die Methode wurde 1974 überarbeitet. Ob eine Verbesserung erzielt wurde, entzieht sich meiner Kenntnis. Aber ich habe noch im Ohr den Kommentar meines Doktorvaters dazu: „Ihr habt die Testfarben so lange hin und her geschoben, bis die Dreibandenlampe einen Index von 80 erreichen konnte.“ Nicht nur das. Zu den Merkwürdigkeiten des Farbwiedergabeindex gehört eine Skala, die krummer nicht hätte sein können. Der Index hört bei 100 auf, so dass selbst Fachleute irregeführt werden und denken, die Zahl sei Prozent. Nichts dergleichen ist wahr. Die Zahl 100 wird vergeben, wenn eine Lampe alle Farben richtig wiedergibt. Das sind aber nicht alle vorhandenen Farben, sondern acht Testfarben, sämtlich ungesättigte Pastelltöne. Warum gerade die? Siehe oben die Meinung meines Doktorvaters. Die Skala hat kein unteres Ende, weil eine Lampe das Erkennen von Farben auch verhunzen kann. Der Index kann also auch negativ werden.

Erst lustig wird es mit den Bezeichnungen der Skala des Farbwiedergabeindex. Diese geht so : 1A – 1B – 2A – 2B – 3 – 4. Diese krumme Bezeichnungsweise ist der Bemühung geschuldet, die sog. Dreibandenlampe nicht drittklassig erscheinen zu lassen. Die reichlich ungewöhnliche Skala wird in der Norm DIN EN 12464-1 noch etwa befremdlicher dargestellt, weil die Zahlen Schulnoten ähneln, aber keine sind. So bedeuten 3 und 4 „mangelhaft“, 2A und 2B „mittel“. 1A ist „ausgezeichnet“, bedeutet aber zwei sehr unterschiedliche Farbstufen (Ra = 100 und Ra ≥ 90).

Kurzum: Bei Luckiesh stand vor 100 Jahren fest, dass zum Sehen des Menschen eine natürliche Wiedergabe von Farben dazu gehört. Die Lichttechnik hat diese so definiert, dass eine nach ihren Maßstäben „exzellente“ Lampe nicht eine einzige gesättigte Farbe wiedergeben muss. Der arbeitende Mensch bekommt bestenfalls nur Ra = 80 zugebilligt, was das auch immer zu bedeuten hat.

Wenn das Erkennen von Farben für das menschliche Wohlbefinden bedeutsam ist, ist diese Festlegung sogar illegal. Festlegungen, die für Befinden und Gesundheit wichtig sind, darf nur der Staat treffen.

Luckiesh bleibendes Erbe

Luckieshs bleibendes Erbe ist die Erkenntnis, dass das Auge lediglich das Werkzeug ist, aber der ganze Mensch sieht. Er machte deutlich, dass eine gute Beleuchtung eine Investition in die menschliche Leistungsfähigkeit und das Wohlbefinden ist, nicht bloß eine Stromrechnung.

Luckiesh revolutionierte die Lichttechnik, indem er den Fokus von der rein physikalischen Messung (wie viel Licht ist im Raum?) auf die biologische und psychologische Wirkung (wie beeinflusst dieses Licht den Menschen?) verschob.

Er war ein Pionier des „Dual Purpose Lighting“: Beleuchtung sollte gleichzeitig die Sicht verbessern und die Gesundheit fördern (z. B. durch die Integration von UV-Anteilen zur Vitamin-D-Synthese).