Dieses Phantom war wohl zu Zeiten Goethes bekannt, von dem der Spruch überliefert ist: „Ich wüsste nicht, was sie besseres erfinden könnten, als wenn die Lichter ohne putzen brennten.“ Wer Licht machen wollte, musste sich schon immer um dessen Pflege bemühen. Unterschiedlich waren nur der Umfang und die Berechenbarkeit des Aufwands, den man treiben musste. (s. dazu Kapitel Epochen der Kunst der Lichtmacher)

Im Laufe der Jahrhunderte wurde der Pflegebedarf für Licht stetig geringer, was einen großen Teil des Fortschritts der Technologie ausmacht. So musste man bei der Kerze recht häufig nachsehen, ob sie noch brennt. Edisons erste Lampe brannte 40 Stunden lang ohne Aufsicht. Nur wenige Jahrzehnte danach musste die Industrie einen Glühlampenweltvertrag beschließen, um die Lebensdauer der Lampe auf 1000 h zu kürzen. Und heute redet man von 50.000 Stunden, die eine LED Licht spenden soll. Abgeschafft wurde die Pflege der Beleuchtung aber immer noch nicht. Sie wurde nur unendlich komplizierter. Seit langem hat sie einen Namen: Wartungsfaktor. Es fehlt nur an der Modernisierung des Inhaltes. Daher die Qualifizierung als Phantom.

Der Wartungsfaktor als technischer Begriff

Wie jedes Ingenieurprodukt ist auch die Technik der künstlichen Beleuchtung fest mit dem Prinzip von Inspektion und Wartung verbunden. Inspektion heißt, man prüft den bestimmungsgemäßen Zustand. Wartung bedeutet, dass man eine Technik ertüchtigt und wieder in den bestimmungsgemäßen Zustand bringt.

Der Begriff bestimmungsgemäßer Zustand ist juristisch relevant. Er bedeutet, dass sich ein technisches Produkt in dem Zustand befindet, den sein Hersteller für den üblichen Betrieb vorgesehen hat. Der bestimmungsgemäße Zustand (oft synonym zu „bestimmungsgemäßer Betrieb“ oder „bestimmungsgemäße Verwendung“ verwendet) beschreibt den Zustand einer technischen Anlage, Maschine oder eines Produkts, in dem es sicher, effizient und entsprechend seiner Auslegung und Dokumentation betrieben wird. Wenn beim Arbeitsstättenrecht von Beleuchtung die Rede ist, ist dieser Zustand gemeint.

Bei der Kerze hatten die Aufgabe, den bestimmungsgemäßen Zustand zu erreichen, die Lichtschneuzer übernommen, die spezialisierte Diener der Reichen waren. Opern und Theater beschäftigten Komödien-Lichtputzer für diese Aufgabe. Die Pflege in der Zeit, als man Licht durch Verbrennen erzeugte, galt nicht nur der Beleuchtung, denn die Stoffe, die bei der Verbrennung entstanden, so z.B. Ammoniak und Schwefel, zerstörten die Dekorationen, Gemälde und sonstige Ausstattungen. Das Licht war sogar Konkurrent des Menschen um den Sauerstoff. So hatten die Lichtschneuzer und -putzer eine Schutzaufgabe für alles.

Bei der Beleuchtung hingegen war die Sache nicht so klar. So ist mir kein Berufsstand bekannt, der den Betrieben das regelmäßige Fensterputzen erledigt, um die Fenster in den bestimmungsgemäßen Zustand zu versetzen. Das Problem muss uralt sein, denn der staatlich geförderte Film Licht des Amtes für schöne Arbeit von 1935 beginnt die gute Beleuchtung mit kollektivem Fensterputzen. Hingegen schrieb mir ein Architekturkritiker im März 2026 über ein viel gelobtes öffentliches Gebäude, er hätte unter schlechten Bedingungen gearbeitet, weil der Architekt vergessen hatte, dass die Fenster auch mal geputzt werden müssen. Eigentlich ein Verstoß gegen die Arbeitsstättenverordnung.

Bei der künstlichen Beleuchtung sollte so etwas nicht vorkommen können. Die lichttechnische Industrie hatte und hat – ganz uneigennützig – ein großes Interesse daran, dass installierte 100 lx immer 100 lx blieben. Wie man das auch anstellen mag. Die Definition eines Wartungsfaktors bildete den vorletzten Schritt dazu.

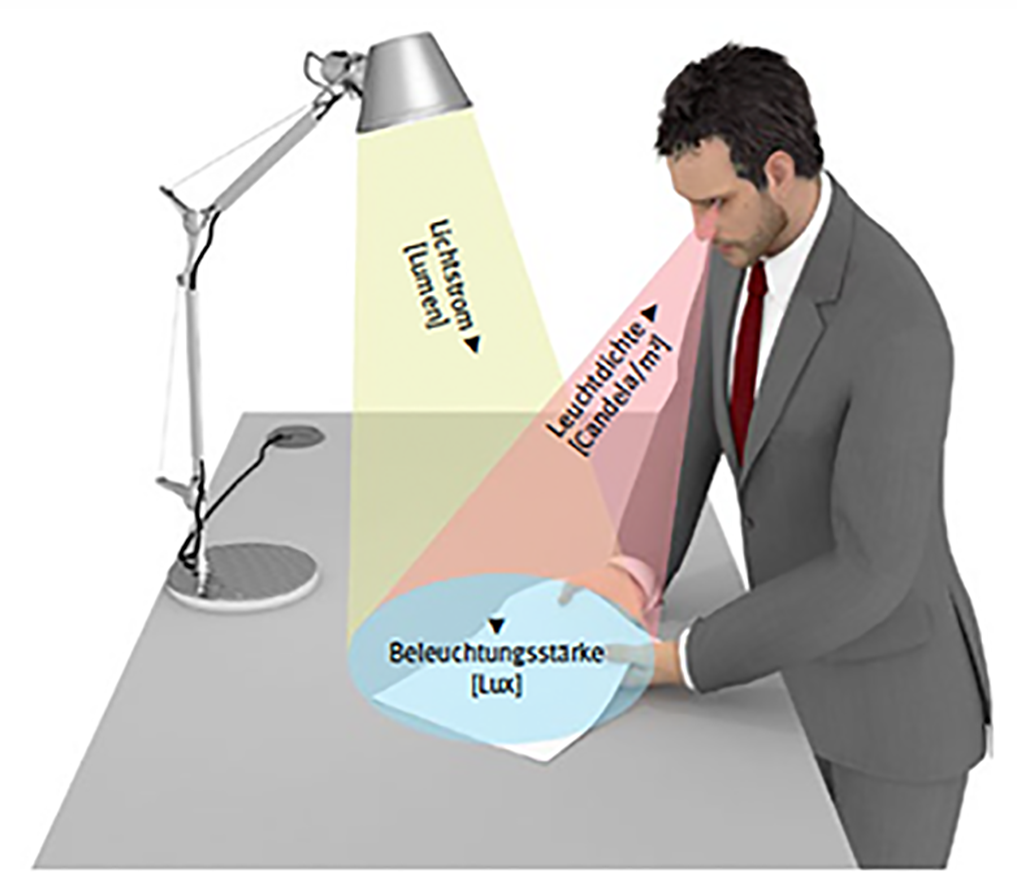

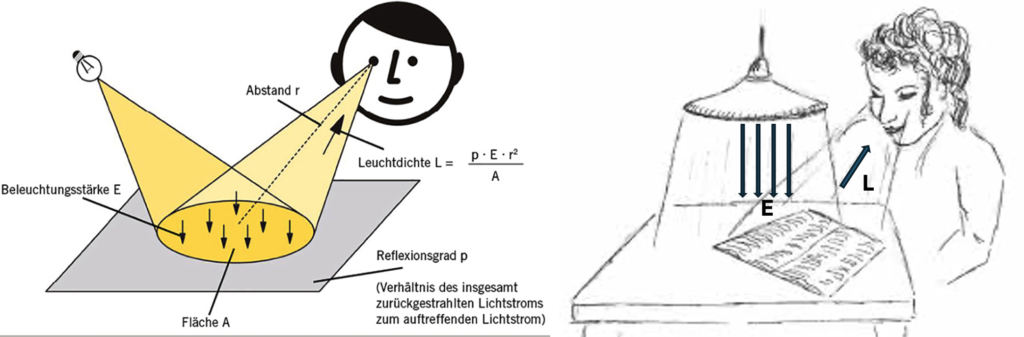

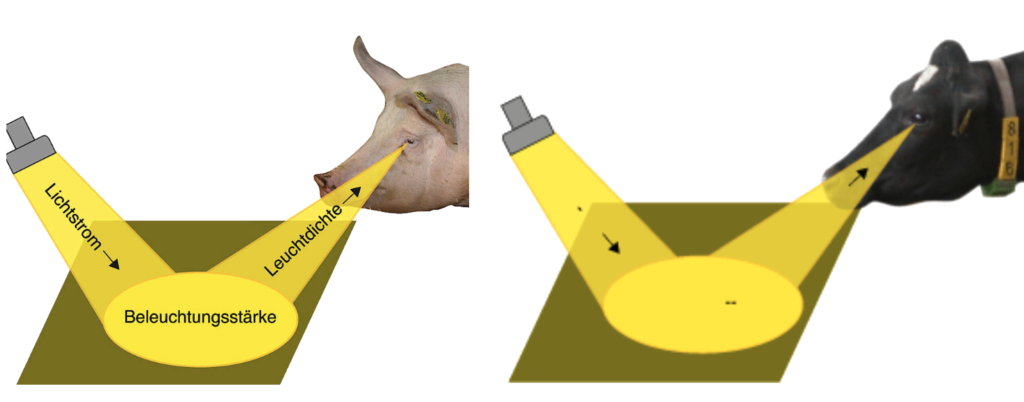

Der Wartungsfaktor (Maintenance Factor, MF) ist eine dimensionslose Kennzahl in der Lichtplanung. Er definiert das Verhältnis der Beleuchtungsstärke einer Anlage zu einem spezifischen Zeitpunkt (Wartungszeitpunkt) im Vergleich zu ihrem Neuzustand. Der Begriff wurde erst spät 1992 definiert, obwohl es immer bekannt war, dass eine Lichtplanung auf der Basis des Neuzustandes nie sinnvoll gewesen sein konnte. Der eigentliche Durchbruch für die heutige Definition kam im Jahr 1992. Die Internationale Beleuchtungskommission (CIE) veröffentlichte den technischen Bericht CIE 97 "Maintenance of indoor electric lighting systems".

Der Wartungsfaktor wird aus vier spezifischen Verlustfaktoren berechnet, die die Lampen, deren Lebensdauer, die Leuchten und die Verschmutzung der Raumwände betreffen.

WF = LLMF x LSF x LMF x RSMF

LLMF (Lampenlichtstrom-Wartungsfaktor): Berücksichtigt die Abnahme des Lichtstroms der Lichtquelle über die Betriebsdauer (Degradation)

LSF (Lampenlebensdauerfaktor): Berücksichtigt die statistische Ausfallwahrscheinlichkeit der Leuchtmittel bis zum Wartungszeitpunkt.

LMF (Leuchtenwartungsfaktor): Berücksichtigt die Verschmutzung der Leuchte in Abhängigkeit von ihrer Bauart und der Umgebungssauberkeit.

RSMF (Raumwartungsfaktor): Berücksichtigt die Abnahme der Reflexionsgrade von Wänden und Decken durch Verschmutzung.

Auch in dieser Formel kann man die Natur einer Vorgabe erkennen, die sicherstellen will, dass eine Beleuchtung immer dem gewünschten Zustand entspricht. Was der gewünschte Zustand für Arbeitsstätten ist, wurde seit 1913 in diversen Regelwerken (Normen, Gesetzen, Verordnungen etc.) festgelegt (s. Beitrag Beleuchtung von Arbeitsstätten muss i.S. des Arbeitsschutzes reguliert werden.). Festgelegt wurde fast immer die in einer horizontalen Messebene in Arbeitshöhe (einst 85 cm, später etwas tiefer) vorhandene Beleuchtungsstärke. Diese stellt den Vertragsgegenstand zwischen dem Auftraggeber und dem Lichtplaner dar.

Als der Begriff noch nicht existierte …

Schon in den Anfängen der elektrischen Beleuchtung war bewusst, dass Anlagen mit der Zeit dunkler werden, lange bevor die Lampen ausfallen. In den alten deutschen Normen (wie der DIN 5035) wurde jedoch meist nicht mit einem detaillierten "Wartungsfaktor" gerechnet, sondern mit einem pauschalen Planungswert (oft 1,25).

- Man schlug einfach 25 % auf die benötigte Beleuchtungsstärke auf, um Verluste auszugleichen.

- Das entsprach rechnerisch einem Wartungsfaktor von 0,8 (1 / 1,25 = 0,8).

Das war gemessen an der Genauigkeit, mit der ein Planer die angestrebte Beleuchtungsstärke erzielte, sogar zu genau. Damals ging das Gerücht herum, dass die Wettervorhersage im Monat April genauer war als die Lichtplanung bei der Bestimmung der Beleuchtungsstärke. Tatsächlich haben wir bei gerichtsfesten Messungen festgestellt, dass bei einer Vorgabe von 500 lx als Nennwert (= 625 lx Neuwert), Werte zwischen 300 lx und 2000 lx installiert wurden. In einem Fall, bei dem bei einer falschen Beleuchtungsstärke ein Gang vor Gericht drohte und deswegen eine präzise Vorgabe der späteren Messung bei der Auftragsvorgabe erfolgte, variierte in 38 Anlagen (= 38 Bürohäuser für jeweils etwa 300 Mitarbeitende) mit dem gleichen Leuchtentyp des gleichen Herstellers die Beleuchtungsstärke zwischen 350 lx und 900 lx.

Interessant ist, wogegen der Verlust berechnet wurde. Der Zustand, gegen den ein Verlust berechnet wurde, nannte sich die Nennbeleuchtungsstärke. Die Größe Nennbeleuchtungsstärke war „der zeitliche und örtliche Mittelwert“ der Beleuchtungsstärken. Was soll man sich darunter vorstellen? Einen örtlichen Mittelwert kann sich jeder halbwegs gebildete Laie verstehen: Man misst die Beleuchtungsstärke an verschiedenen Orten und berechnet davon den Mittelwert. Aber der zeitliche Mittelwert? Die Erklärung der Nennbeleuchtungsstärke, die das Maß für den Verlust darstellt, umfasste in DIN 5035:1990 ca. eine DIN-A4-Seite und war selbst für erfahrene Verwaltungsrichter eine Herausforderung bei entsprechenden Klagen. Denn kaum eine technische Größe wurde je krummer definiert:

„Die Nennbeleuchtungsstärke En ist für Arbeitsstätten in Innenräumen der Nennwert der mittleren Beleuchtungsstärke im Raum oder in der einer bestimmten Tätigkeit dienenden Raumzone, für den die Beleuchtungsanlage auszulegen ist.“ Soweit ist die Sache noch in Ordnung. Aber die Norm erklärt weiter: „Die Nennbeleuchtungsstärke En für Arbeitsstätten in Innenräumen bezieht sich:

- auf den mittleren Alterungszustand der Beleuchtungsanlage:

- auf den eingerichteten Innenraum die eingerichtete Raumzone;

- im allgemeinen auf die horizontale Arbeitsfläche in 0,85 m Höhe über dem Fußboden; bei anderer Lage der Arbeitsfläche bezieht sich die Nennbeleuchtungsstärke En auf diese Lage (z.B. Schaltschrankmontage, Zeichenbrett, Schreibtisch);

- bei Verkehrswegen in Innenräumen auf deren Mittellinie in max. 0,2 m Höhe über dem Fußboden.“ (fettkursiv schlecht oder gar nicht bestimmbare Faktoren)

Wie soll man verstehen, was es bedeutet, dass sich eine Planungsgröße, die man beim Bau einer Arbeitsstätte zugrunde legen muss, auf die Lage eines Schreibtisches bezieht? Woher weiß der Planer, wann der mittlere Alterungszustand einer Beleuchtungsanlage sein wird? Kann man bereits bei der Planung eine Größe berücksichtigen, die sich auf einen eingerichteten Raum bezieht, bevor dieser Raum überhaupt entstanden ist?

Nachdem die Nennbeleuchtungsstärke etwa 30 Jahre lang kaum jemandem ein Begriff geworden war, wurde sie zusammen mit der Normenreihe DIN 5035 abgeschafft. An ihre Stelle trat die Wartungsbeleuchtungsstärke bzw. der Wartungswert der Beleuchtungsstärke. Diesen Wert kann jeder jederzeit an jedem Arbeitsplatz messen. Wie hoch er sein soll, kann man in DIN EN 12464-1 ab Jahrgang 2001 lesen.

Durch diesen Vorgang bekam der Wartungsfaktor eine neue Bedeutung. Hat man einst einen pauschalen Zuschlag zur Nennbeleuchtungsstärke eingeplant (z.B. 1,25 für die meisten Fälle), kann man seit 2001 vereinbaren, wann eine Wartung erfolgen soll (z.B. nach 1 Jahr oder nach 3 Jahren), wonach sich der Wartungswert errechnet.

Rechtliche Lage

In Deutschland ist die Wartung von Beleuchtungsanlagen kein "nice-to-have", sondern durch Gesetze und Normen geregelt. Dabei wird grundsätzlich zwischen der Beleuchtung und der Sicherheitsbeleuchtung (Notbeleuchtung) unterschieden. Die primäre Rechtsgrundlage ist die Arbeitsstättenverordnung (ArbStättV) in Verbindung mit der ASR A3.4 ("Beleuchtung"). Der Arbeitgeber muss sicherstellen, dass die Beleuchtung jederzeit den Anforderungen der ASR A3.4 entspricht.

Zwar muss kein Betrieb diese ASR erfüllen. Das gilt aber nur, wenn er gleichwertige oder bessere Vorgaben hat. Hinsichtlich der Beleuchtung dürfte es jedem schwerfallen, eine gleichwertige Alternative zu den geforderten Eigenschaften zu realisieren. Die Instandhaltung wird in 9.2. Instandhaltung der ASR A3.4 geregelt. In diesem Paragraphen sind auch die Fenster nicht vergessen: “Um die Versorgung mit Tageslicht nicht zu beeinträchtigen, sind Fenster und Dachoberlichter regelmäßig zu reinigen. Anforderungen an den Arbeitsschutz bei der Reinigung von Fensterflächen siehe ASR A1.6 „Fenster, Oberlichter, lichtdurchlässige Wände“.

Die ASR fordert auch: “Es ist dafür zu sorgen, dass sichere Instandhaltung möglich ist, insbesondere ist für einen sicheren Zugang zu sorgen.”

Wenn sich jemand auf die Norm DIN EN 12464-1 beruft, muss dieser auch den Wartungsfaktor berücksichtigen. Die Aufgaben des Planers sind wie folgt beschrieben:

„Der Konstrukteur [der Lichtplaner, Anm. d.A.] muss:

— fm angeben [fm ist der Gesamtwartungsfaktor, oben WF genannt] und alle Annahmen auflisten, die bei der Ermittlung des Werts gemacht wurden,

— die für die Anwendungsumgebung geeignete Beleuchtungsanlage angeben und

— einen Wartungsplan vorbereiten, z. B. für die Häufigkeit des Ersetzens der Lichtquelle, für Reinigungsintervalle von Leuchte und Raum.

fm hat einen großen Einfluss auf die Energieeffizienz. Die bei der Ermittlung von fm gemachten Annahmen müssen sowohl realistisch erreichbar als auch auf eine Weise optimiert werden, die zu einem hohen Wert führt.“

Wo es arg kneift

Fehlendes Bewusstsein bei den Anwendern

Anwender zeigen im Allgemeinen wenig Neigung, Beleuchtung zu warten. Bei betrieblichen Studien habe ich die Frage, ob man einen Wartungsplan hätte, gestellt, um die nicht so ehrlichen Kandidaten herauszufischen. Denn man kann i.d.R. davon ausgehen, dass es den Betrieben nicht einmal bewusst ist, dass sie so etwas brauchen. Man weiß gleich, warum, wenn man sich die Beschreibung der Nennbeleuchtungsstärke anguckt.

Wenn man sich die möglichen praktischen Bedingungen näher ansah, konnte man auch verstehen, warum man an eine Wartung erst gar nicht dachte. Manche Leuchten brauchen zwei Elektriker, um die Lampen zu entfernen. Und die einst vorherrschenden Hochglanzspiegel durfte man nur mit Schutzhandschuhen anfassen. Auf den Tischen standen zuweilen hochauflösende Bildschirme mit einem Gewicht bis 20 kg oder Drucker bis 40 kg. All das wegräumen, um Leuchten zu putzen?

Ein Fachmann, der in den 1970er Jahren die Wartung von Beleuchtung als Dienstleistung anbieten wollte, verdiente keinen Cent damit. In mehreren Jahrzehnten der Betriebsberatung ist uns kein Wartungsplan über den Weg gelaufen.

Das liebe Geld

Da es den Anwendern an Bewusstsein für die Wartung der Beleuchtung fehlt, kann ein Planer einen hohen Wartungsfaktor zugrundelegen, z.B. 0,8, und dem Kunden gegenüber verschleiern, dass er einen festen Reinigungszyklus von einem Jahr voraussetzt. Es ist überhaupt fraglich, ob ein Betrieb weiß, dass eine Reinigung der Wände zu der Wartung der Beleuchtung gehört. Man deklariert eine Industriehalle oder ein Standardbüro einfach als „sehr saubere Umgebung“. Dann setzt man den Raumwartungsfaktor (RSMF) und Leuchtenwartungsfaktor (LMF) so hoch an, als würde dort täglich Staub gewischt. So springt der Wartungsfaktor von realistischen 0,67 auf 0,85. Dabei bedeutet ein WF von 0,67, dass man 50 % mehr installieren muss, während man bei 0,85 nur 17% mehr installiert. Man spart also 20% der Installation durch optimistische Annahmen, die nicht einmal zutreffen. Kein Kläger, kein Richter.

Verwirrende neue “Begriffe”

Obwohl es vielen Leuten vom Fach sehr schwergefallen war, sich von der Nennbeleuchtungsstärke auf die Wartungsbeleuchtungsstärke umzustellen, hat die Normung in der letzten Ausgabe der EN 12464-1 redlich Mühe gegeben, die Sache noch komplizierter zu machen. So wurden noch der “minimale Warnungswert der Beleuchtungsstärke” und der “höhere Wartungswert der Beleuchtungsstärke” vorgeschrieben. Zu denen kam noch eine Forderung nach dem Wartungswert der mittleren zylindrischen Beleuchtungsstärke, wobei man diese Größe nach einem Kontextmodifikator eine Stufe höher oder tiefer wählen kann.

Was dieser Kontextmodifikator sein soll, habe ich lange gesucht. In der Norm ist die Rede von „kontextabhängigen Modifikatoren“, womit gemeint ist, dass z.B. eine Aufgabe Fehlermöglichkeiten beinhaltet, deren Folgen schwerwiegend sein können. Dann soll die Beleuchtungsstärke eine Stufe höher gewählt werden. Warum man der folgenden Anforderung folgen soll, leuchtet mir immer noch nicht ein: „Der Wartungswert der Beleuchtungsstärke darf um mindestens eine Stufe in der Beleuchtungsstärke-Skala (siehe 4.3.2), angepasst werden wenn die Sehbedingungen von den üblichen Annahmen abweichen.“

Insgesamt waren in dem Entwurf dieser Norm so viele Sonderbarkeiten, dass die Übersetzung ins Deutsche zwei Jahre gedauert hat, obwohl die größte Gruppe unter den Autoren aus Deutschland kam.

Obsolete Grundlagen

Die Festlegung der Wartungsfaktoren in CIE 97 im Jahre 1992 erfolgte auf der Basis von Erfahrungen mit Leuchten, Lampen und Räumen aus den 1970er und 1980er Jahren. Zwei Jahrzehnte danach musste nachgebessert werden, weil sich die Lampen wie die Leuchten geändert hatten (CIE 97:2005). Man legte den Fokus auf den individuellen Wartungszyklus. Wie ich oben erklärt habe, fehlt den Auftraggebern die Motivation dazu, aus dieser Entwicklung einen Vorteil im Sinne der besseren Beleuchtung zu machen.

Die wichtigste Änderung betrifft aber die Lampentechnik. In ganz Europa wird nur noch LED-Beleuchtung installiert. Dabei hat sich eine Marketingszahl als Motivationskiller herausgeschält: die Zahl 50.000. Diese soll angeblich die Lebensdauer der LED kennzeichnen. Für Betriebe bedeutet sie eine ungeheure Zahl, durch die jegliche Fürsorge für die Beleuchtung entfällt. In welchem Büro mag wohl die künstliche Beleuchtung die 50.000 Betriebsstunden hinter sich bringen?

In der Lichtplanung und energetischen Bilanzierung (nach DIN V 18599) gibt es für ein Standardbüro in Deutschland klare Richtwerte für die jährliche Betriebsdauer. In fensternahen Bereichen brennt das Kunstlicht oft nur 50 % der Zeit (ca. 1.200 – 1.500 Stunden). Theoretisch nimmt die Norm bei Tagnutzung 2.250 Stunden an. So kann ein Optimist (1200 h Brenndauer jährlich) von 41,66 Jahren ausgehen, für den Pessimisten ergeben sich 22,22 Jahre.

In Deutschland werden gewerbliche Gebäude, die nach dem 31.3.1985 fertiggestellt wurden, linear mit 3 % pro Jahr abgeschrieben, was einer rechnerischen Lebens-Dauer von 33 Jahren entspricht. Die wirtschaftliche Lebensdauer beträgt ca. 30 – 50 Jahre. So kann man optimistischerweise damit rechnen, im Laufe der Lebensdauer eines Bürohauses mit einem Lampenwechsel davonzukommen. Vielleicht kann man den aufschieben?

Doch dem ist nicht so. Denn erstens gibt es elektrisch beleuchtete Sicherheitszeichen (z.B. Fluchtwegbeschilderung), die während der gesamten Betriebsstunden ständig leuchten müssen, häufig rund um die Uhr. Der Glaube an die 50.000 Stunden lässt sogar die wöchentlichen Inspektionen vergessen, die erforderlich sind. Zweitens ist die Lebensdauerbetrachtung einer LED wesentlich komplizierter (s. Kapitel Angaben für die Lebensdauer von Leuchtmitteln. Wie kompliziert es mit der LED ausschaut, erkennt man an der Formel L70B10C10F10. L70 bedeutet, dass die LED bei 70% des Anfangslichtstroms am Ende ist. B10 bedeutet, dass dabei höchstens 10% der Elemente diesen Wert unterschreiten dürfen. C10 bedeutet, die zu einem gegebenen Zeitpunkt zu erwartende Ausfallrate in Prozent. Ein Wert von C10 bedeutet, dass in einem Modul 10% aller Elemente total ausgefallen sind. F10 bedeutet, dass höchstens 10% der LED den L-Wert unterschreiten dürfen (inklusive Totalausfall).

Die Angaben für die Lebensdauer von LEDs gelten nur für optimale Temperaturbedingungen. Bereits kleine Abweichungen können zu drastischen Verlusten an Lebensdauer führen. Diese können durch ungeeignete Leuchten bedingt sein, aber auch durch zu hohe Temperaturen in Industriehallen. Für den letzten Fall müsste ein zusätzlicher Korrekturfaktor für die Temperatur berücksichtigt werden.

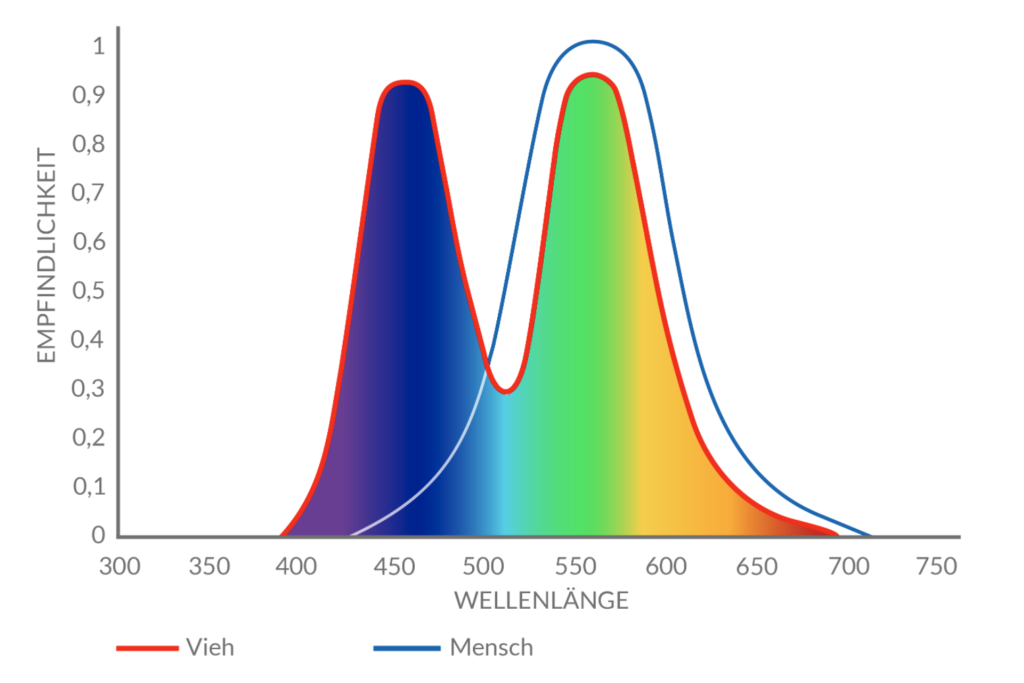

In der Realität ist der Vorgang der Degradation eines LED-Moduls noch schwieriger zu beschreiben, weil die Module nicht nur an Leuchtdichte verlieren, sondern auch in Farbe. Oder ein Element ist noch in Betrieb, flimmert aber nur noch.

Fazit

Der Wartungsfaktor ist ein Erbe alter Zeiten, das die Bezeichnung Phantom redlich verdient. Er hat noch lange nicht ausgedient, weil das Konzept Teil eines jeden Engineering-Konzepts ist. Der Wartungsfaktor beruht aber auf recht alten Daten und noch älteren Vorstellungen mit Lampen, die es nicht mehr gibt. Die modernen Lampen weisen andere Alterungserscheinungen auf. Dabei geht die Alterung der Lampe gleich zweimal in die Berechnung des Wartungsfaktors ein, als Lampenlichtstrom-Wartungsfaktor und als Lampenlebensdauerfaktor. Der letztere Faktor beruht zum einen auf einer drastisch höheren fiktiven Lebensdauer[1] gegenüber älteren Lampen (50.000 h gegenüber 1.000 h bei Allgebrauchsglühlampen und 10.000 h bei Leuchtstofflampen).

Anstatt die Leuchten von Anfang an mit 100 % Leistung zu betreiben (und damit am Anfang "zu viel" Licht zu haben), kann man heute technische Gegenmaßnahmen wie CLO-Treiber ( constant light output) nutzen. Die Elektronik gleicht den LLMF automatisch aus. Die Leuchte startet bei etwa 80 % Leistung und steigt über die Lebensjahre hinweg schrittweise auf 100 % Leistung. Beispiele für diese Funktionalität gibt es z.B. hier und da und dort. Ein CLO-Treiber spart über lange Jahre Strom und verlängert die Betriebsdauer einer LED.

Ob und wann man sich allgemein eine solche Technik aneignet, ist trotz der Vorteile leider nicht gesagt. Ein Grund könnte die höhere Investition zu Beginn sein. Man muss mehr in die Technik investieren, um später daraus Vorteile zu erzielen. In einem professionell genutzten Gebäude fallen die Investitionen beim Investor an, die Vorteile beim Mieter. Diese sind i.A. zwei unterschiedliche Firmen. Selbst wenn sie Töchter derselben Firma sind, erscheinen die Kosten und die Ersparungen in zwei getrennten Bilanzen auf. Dieser Umstand hat die Durchsetzung des elektronischen Vorschaltgerätes mehrere Jahre verzögert.

Im Privatbereich spielen solche Überlegungen kaum eine Rolle. Die Energieersparnis (durch das gedimmte Start-Niveau) ist bei einer einzelnen Lampe so gering, dass sich der Aufpreis für den teuren Treiber im privaten Umfeld oft erst nach Jahrzehnten rechnen würde. Zudem muss man daran denken, dass viele Privatleute gebrannte Kinder sind, was die Lebensdauer von Lampen angeht. Bereits bei der Glühlampe konnte man den Verdacht nicht loswerden, dass da etwas nicht stimmte. Bei der Leuchtstofflampe, die sich im Wohnbereich nie richtig durchsetzen konnte, war es umgekehrt. Fiel eine Glühlampe gefühlt zu früh aus, waren Leuchtstofflampen im Haushalt (z.B. bei Aquarien) noch bei der doppelten oder dreifachen Lebensdauer im Einsatz, auch wenn sie nur noch die Hälfte des Lichts abgaben, die sie am Anfang produziert hatten.

LEDs sind da ein Fall sondergleichen. Viele erleben, dass die angeblich ewig lebende Lampe nach wenigen Tagen den Geist aufgibt, wofür der Hersteller des Leuchtmittels häufig nichts kann. Das Problem liegt beim Kühler oder bei den sonstigen Faktoren für die Kühltechnik. Auch dieser Umstand ist privat schwer zu vermitteln, weil LEDs nachgesagt wird, dass sie sehr wenig Strom brauchen und noch weniger Wärmestrahlung in ihrem Licht haben. Beides stimmt sogar. Aber auch das vorzeitige Ableben vieler LEDs aus thermischen Gründen.

Es gibt also sowohl berechenbare als auch schwer verständliche Faktoren, die dem Phantom Wartungsfaktor zu einem langen Leben verhelfen werden.

[1] Hier spreche ich absichtlich von einer fiktiven Lebensdauer, weil die angegebenen Zahlen eher vom Marketing stammen als von der Realität. Auch wenn die Zahlenwerte Jahre bedeuten, kommen sie sehr unterschiedlich zustande. S. hierzu Angaben für die Lebensdauer von Leuchtmitteln

.