Genesis 2.0 - Schöpfung der elektrischen Sonne, kurzgefasst

Dieser Beitrag gibt eine Übersicht über alle Kapitel von Genesis 2.0 – Schöpfung der elektrischen Sonne in Form von Kurzfassungen der einzelnen Kapitel.

Im Anfang waren Götter und Titanen

Ausgehend von der Figur des Prometheus erzählt dieses Buch die Geschichte eines Menschheitstraums, der zum Epochenprojekt geworden ist: die Vertreibung der Nacht.

Was als mythischer Feuerraub beginnt, setzt sich in den technischen Verheißungen der Moderne fort – vom Schein der Flamme bis zum kalten Glanz elektrischer Dauerbeleuchtung. Licht erscheint dabei nicht nur als Triumph der Erkenntnis, sondern auch als Geste der Selbstermächtigung: Der Mensch löst sich aus kosmischen Ordnungen, überbietet alte Götterbilder und rückt der Sonne selbst auf den Leib.

Doch je heller die Welt wird, desto deutlicher treten die Verluste hervor. Mit der Finsternis verschwindet nicht bloß ein Naturzustand, sondern ein Erfahrungsraum, in dem Maß, Rhythmus, Verletzlichkeit und Staunen aufgehoben waren. So liest dieses Buch die Geschichte der künstlichen Helligkeit zugleich als Kulturgeschichte der Entzauberung – und als späte, überraschende Wiederentdeckung des Werts der Dunkelheit.

Epochen der Kunst der Lichtmacher

Das Kapitel beschreibt die Geschichte der künstlichen Beleuchtung als Entwicklung in vier Epochen.

Licht 1.0 beruht auf brennbaren Stoffen wie Kienspan, Fackel, Öllampe, Kerze und Gaslicht. Diese Lichtquellen waren mit vielen Nachteilen verbunden: kurze Brenndauer, ständige Überwachung, Wärme, Rauch, Ruß, Brandgefahr und geringe Effizienz. Trotzdem prägten sie über Jahrtausende das Leben der Menschen und ihre Kultur.

Mit Licht 2.0 begann die Epoche des elektrischen Lichts aus glühenden Materialien, vor allem der Glühlampe. Sie verringerte viele Probleme früherer Lichtquellen, etwa Rauch, Ruß und offene Flammen, und machte Beleuchtung bequemer, sicherer und massentauglich. Zugleich veränderte sie Wirtschaft, Städtebau, Arbeitswelt und Alltag grundlegend, weil sie Stromnetze, Industrialisierung und eine von Tageslicht unabhängige Gesellschaft förderte. Das Ende der Glühlampe kam nicht durch technische Überholung allein, sondern auch durch politische Verbote ineffizienter Leuchtmittel.

Licht 3.0 steht für Licht aus Plasma bzw. Gasentladung, insbesondere Leuchtstofflampen und andere Entladungslampen. Diese Technik ermöglichte eine effiziente Beleuchtung großer Flächen und förderte fensterlose Arbeitsräume sowie die 24/7-Gesellschaft. Gleichzeitig brachte sie neue Probleme mit sich, etwa fragwürdige Vorstellungen vom Ersatz des Tageslichts, gesundheitliche und architektonische Folgen sowie die Nutzung von Quecksilber.

Mit Licht 4.0 beginnt die Ära der Halbleiter, der LED. Sie ist sehr effizient, vielseitig steuerbar und eröffnet zahlreiche neue Anwendungen in Beleuchtung, Displays und Technik. Doch auch sie ist nicht frei von Nachteilen: Probleme wie Blauanteil im Spektrum, Flimmern, thermische Probleme und mögliche Auswirkungen auf Wahrnehmung, Gesundheit und Umwelt zeigen, dass jede neue Lichttechnik nicht nur Vorteile, sondern auch neue Herausforderungen mit sich bringt.

Insgesamt zeigt das Kapitel , dass die Geschichte des künstlichen Lichts nicht nur eine Abfolge technischer Verbesserungen beim Lichterzeugen ist. Jede Epoche verändert auch Kultur, Architektur, Arbeit, Gesellschaft und das Verhältnis des Menschen zu Licht und Dunkelheit. Alte Lichtformen verschwinden dabei nicht vollständig, sondern bestehen neben neuen Technologien weiter. Ihre Bedeutung insgesamt nimmt aber ab.

Der Stromkrieg – Kampf der Giganten, bevor sie welche wurden

Dieses Kapitel analysiert den historischen Stromkrieg zwischen Gleichstrom und Wechselstrom als zentrale technische, wirtschaftliche und gesellschaftliche Auseinandersetzung der frühen Elektrifizierung.

Im Mittelpunkt stehen die konkurrierenden Konzepte von Thomas Edison, der auf lokal begrenzte Gleichstromnetze setzte, und von George Westinghouse sowie Nikola Tesla, die den Wechselstrom wegen seiner einfachen Transformierbarkeit und seiner Eignung zur verlustärmeren Fernübertragung vorantrieben.

Dargestellt wird, dass sich der Wechselstrom nicht allein aus technischen Gründen durchsetzte, sondern auch im Kontext von Patentkonflikten, unternehmerischer Machtpolitik, öffentlicher Inszenierung und gezielter Propaganda. Zugleich zeigt der Text, wie eng die Entwicklung elektrischer Netze mit der Geschichte des künstlichen Lichts, der Industrialisierung und der modernen Infrastruktur verbunden ist.

Abschließend wird der Bogen ins 21. Jahrhundert geschlagen: Unter veränderten technischen Bedingungen gewinnt Gleichstrom erneut an Bedeutung, etwa in der Hochspannungs-Gleichstrom-Übertragung, bei LEDs, in der Solartechnik, bei Batteriespeichern und in digitaler Infrastruktur.

Der Stromkrieg erscheint damit nicht nur als abgeschlossenes Kapitel der Technikgeschichte, sondern auch als Ausgangspunkt gegenwärtiger Debatten über Effizienz, Dezentralisierung und Energieversorgung. Für längere Stromtrassen ist der Gleichstrom die bessere Lösung. Für daheim vielfach auch.

Geburtsjahre der elektrischen Sonne

Dieses Kapitel zeichnet die Geschichte des elektrischen Lichts nicht als isolierte Erfindung eines einzelnen Genies nach, sondern als Ergebnis eines langen, vielschichtigen historischen Prozesses im „Langen 19. Jahrhundert“.

Ausgangspunkt ist die Beobachtung, dass sich mit der Industrialisierung, der Urbanisierung und dem Wandel von der Agrar- zur Industriegesellschaft auch die Bedeutung des Lichts grundlegend veränderte. Während frühere Gesellschaften weitgehend vom natürlichen Sonnenlicht lebten, entstanden im 19. Jahrhundert neue Arbeits- und Lebensformen, die dieses Licht immer weniger verfügbar machten. Fabrikarbeit, lange Arbeitszeiten, dichte Bebauung, Rauch, Ruß und Luftverschmutzung verdunkelten die Städte und ließen künstliche Beleuchtung zu einer sozialen, wirtschaftlichen und gesundheitlichen Notwendigkeit werden.

Zugleich macht das Kapitel deutlich, dass die Geschichte des Lichts eng mit den politischen, wissenschaftlichen und gesellschaftlichen Umwälzungen des 19. Jahrhunderts verbunden ist. Er verweist auf die Folgen der Französischen Revolution, die Einführung des metrischen Systems, die napoleonische Neuordnung Europas, die industrielle Expansion in England, Westeuropa und den USA sowie die Entstehung moderner Wissenschaft und Technik.

In diesem Zusammenhang erscheint elektrisches Licht als Teil eines umfassenden Modernisierungsprozesses, der neue Formen des Messens, Produzierens, Bauens und Forschens hervorbrachte. Entwicklungen wie die Bogenlampe, frühe Glühversuche und schließlich die elektrische Glühlampe werden deshalb nicht nur als technische Stationen beschrieben, sondern als Produkte einer Epoche, in der Energie, Licht und Fortschritt immer stärker miteinander verschmolzen.

Ein zentrales Thema des Textes ist die „Verdunkelung“ der modernen Stadt. Die massenhafte Zuwanderung in Industriezentren, die engen Mietskasernen, die schlechte Belüftung und der Mangel an Tageslicht führten zu Wohn- und Arbeitsverhältnissen, die als gesundheitlich zerstörerisch wahrgenommen wurden. In dem Kapitel wird ausführlich geschildert, wie Menschen in Städten wie London, Berlin, New York oder Chicago in dunklen, feuchten und überfüllten Räumen lebten, in denen Licht und Luft fehlten. Diese Bedingungen wurden mit Krankheiten wie Tuberkulose und Rachitis verbunden. Licht wurde dadurch nicht mehr nur als Mittel zur Sichtbarkeit verstanden, sondern als Voraussetzung für Gesundheit, Leistungsfähigkeit und ein menschenwürdiges Leben. Die Reformen im Bereich Arbeitsschutz, Sozialgesetzgebung, Wohnungsbau und Stadtplanung erscheinen deshalb im Text auch als Reaktionen auf den Mangel an Licht und auf die gesundheitlichen Folgen der industrialisierten Umwelt.

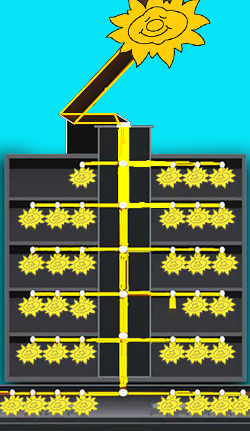

Besonders ausführlich zeigt dieses Kapitel, dass der Kampf gegen die Finsternis auf zwei Wegen geführt wurde. Der erste Weg bestand darin, die Sonne wieder in die Städte hineinzulassen. Sozialreformer, Ärzte, Hygieniker und Stadtplaner forderten größere Fenster, bessere Abstände zwischen Gebäuden, offene Schulformen, luftige Wohnungen und neue Regeln für die Stadtentwicklung. In den USA verband sich dies mit der Progressive Ära, in Europa mit Reformen des Wohnungsbaus, des Arbeitsschutzes und der öffentlichen Gesundheit. Tageslicht wurde als medizinisch, moralisch und sozial wertvolle Ressource behandelt. Die Regulierung von Mietskasernen, Bauordnungen, Zoning-Gesetze und Anforderungen an Belichtung und Belüftung waren daher nicht nur technische Vorschriften, sondern Ausdruck eines neuen Verständnisses von Gesundheit und urbanem Leben.

Der zweite Weg bestand darin, das fehlende Sonnenlicht technisch zu ersetzen. Hier setzt die Idee der „elektrischen Sonne“ ein, die im Text als entscheidender Schritt zur Moderne erscheint. Wenn echtes Sonnenlicht in den verdichteten Städten nicht mehr ausreichend verfügbar war, sollte künstliches Licht nicht nur Helligkeit schaffen, sondern auch die als heilsam verstandenen Wirkungen der Sonne nachahmen.

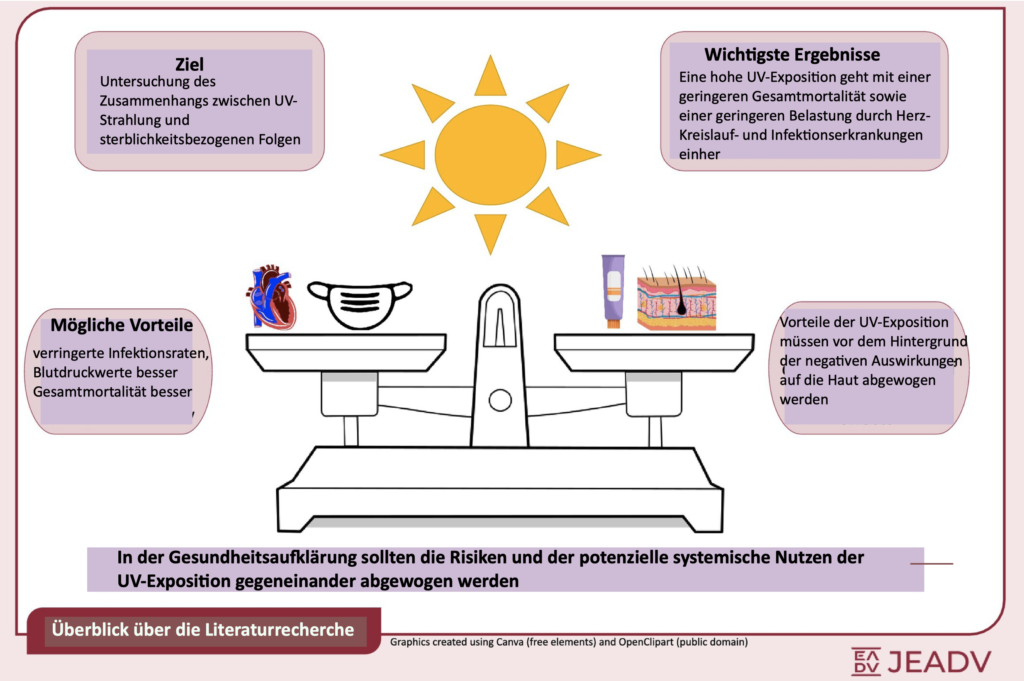

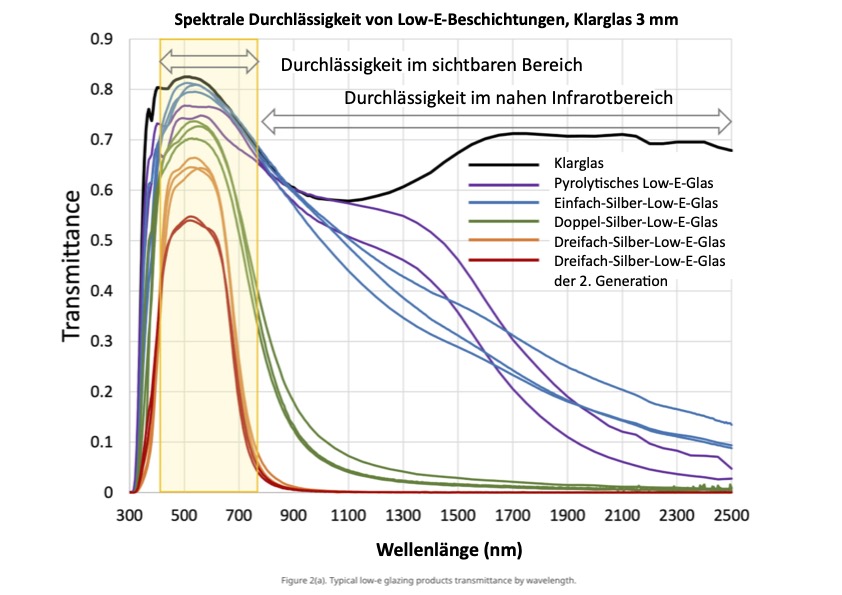

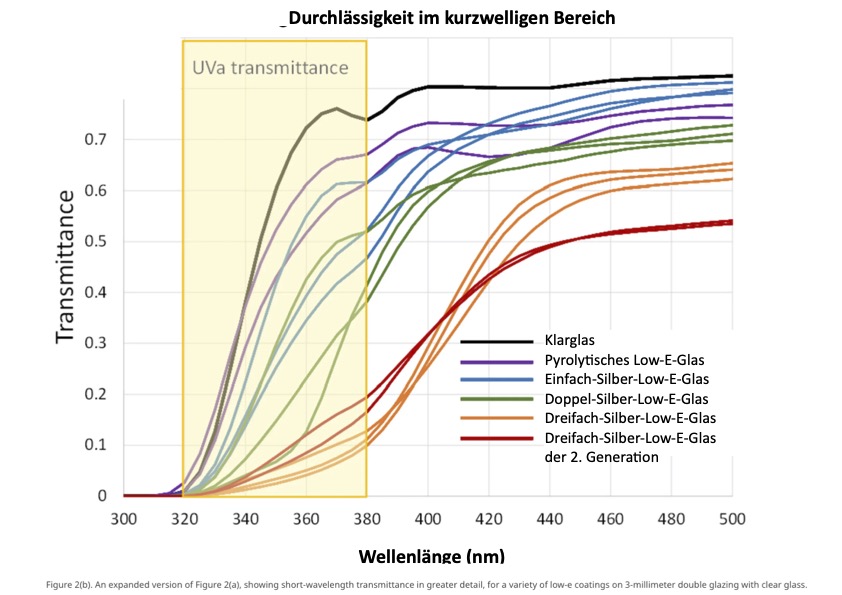

Deshalb behandelt dieses Kapitel ausführlich die Verbindung von Lichttechnik, Medizin und Industrie: von der Glühlampe Edisons über Lichttherapie, UV-Forschung und die Bekämpfung von Rachitis bis hin zu Produkten wie UV-durchlässigem Glas und späteren künstlichen Lichtquellen mit gesundheitlichem Anspruch. Insgesamt zeigt der Text, dass die Geschichte des elektrischen Lichts weit über Technikgeschichte hinausgeht. Sie ist eine Geschichte von Industrialisierung und Umweltveränderung, von sozialer Ungleichheit und Reformpolitik, von Medizin, Wissenschaft und wirtschaftlichen Interessen.

Elektrisches Licht erscheint damit als Antwort auf eine von Menschen selbst geschaffene Finsternis — und zugleich als Symbol für die Hoffnung, die Defizite der modernen Stadt mit technischen Mitteln zu überwinden.

Meanwhile in Old Germany …

Dieses Kapitel arbeitet heraus, dass die Entwicklung von Licht, Stadtplanung und Wohnkultur in Deutschland nicht einfach als Nachwirkung amerikanischer Entwicklungen verstanden werden kann, sondern einen eigenen historischen Verlauf nahm. Deutschland war im langen 19. Jahrhundert zwar kein Vorreiter der Industrialisierung wie England oder später die USA, nahm jedoch eine herausragende Stellung in jenen wissenschaftlichen und technischen Bereichen ein, die mit Licht, Optik und Physik verbunden waren. Namen wie Fraunhofer, Abbe, Schott und Einstein stehen dabei für eine Tradition, in der Forschung, Technik und gesellschaftliche Wirkung eng miteinander verknüpft waren.

Gleichzeitig zeigt der Text, dass die Industrialisierung und das schnelle Wachstum der Städte auch in Deutschland gravierende Probleme hervorriefen: verdichtete Wohnverhältnisse, schlechte Belüftung, mangelnden Lichteinfall, hygienische Missstände und eine starke Belastung durch Rauch, Ruß und Smog.

Am Beispiel Berlins und des Hobrecht-Plans wird deutlich, wie stark diese Entwicklung das Stadtbild und die Lebensrealität der Menschen prägte. Zwar sollte der Plan Ordnung in das rasch wachsende Berlin bringen, doch führten knappe Vorschriften und wirtschaftlicher Druck zu einer dichten Bebauung mit Vorderhäusern, Seitenflügeln und Hinterhäusern, die besonders für Arbeiterfamilien zu engen und gesundheitlich problematischen Wohnsituationen führte. Erscheinungen wie Mietskasernen, überfüllte Höfe und das Schlafgängerwesen verdeutlichen, wie sehr Licht, Luft und Raum zu sozialen Fragen wurden.

Aus diesen Belastungen entstanden zugleich Gegenbewegungen: Naturheilkundliche Ideen, städtebauliche Reformen und neue Gesundheitsvorstellungen rückten Sonne, frische Luft und Bewegung als Voraussetzungen eines besseren Lebens in den Mittelpunkt. Dazu gehörten etwa die Schrebergärten, die aus sozialer Fürsorge und Gesundheitsvorsorge entstanden, ebenso wie moderne Wohnsiedlungen der Berliner Moderne und die Siemensstadt, die bewusst ohne enge Hinterhöfe geplant wurden und stattdessen Licht, Luft, Sonne und wohnungsnahe Arbeitsorte ermöglichen sollten.

Ein weiterer zentraler Gedanke des Kapitels ist, dass solche Entwicklungen nicht allein durch technische Innovationen oder gute Absichten gesteuert werden konnten, sondern wesentlich von rechtlichen Vorgaben abhingen. Bauordnungen, Wohnungsgesetze und arbeitsrechtliche Vorschriften sollten verhindern, dass Menschen in zu dunklen, schlecht belüfteten oder fensterlosen Räumen leben und arbeiten müssen.

Besonders deutlich wird dies an den Anforderungen an Fenstergrößen, Belichtung und Sichtverbindung nach außen. Das Kapitel macht damit zugleich auf ein grundlegendes Paradox der Moderne aufmerksam: Obwohl künstliche Beleuchtung immer leistungsfähiger wurde, kann sie das natürliche Tageslicht in seiner gesundheitlichen und sozialen Bedeutung nicht ersetzen. Insgesamt zeigt die Darstellung, dass der Zugang zu Licht nicht nur eine technische oder ästhetische Frage ist, sondern ein zentrales Thema von Stadtentwicklung, sozialer Gerechtigkeit, Gesundheit und menschenwürdigen Lebensverhältnissen bis in die Gegenwart hinein bleibt.

Die Dämmerung - Als die Lichter glänzen lernten

Dieses Kapitel zeichnet die historische Entwicklung des elektrischen Lichts von der Glühlampe bis zur modernen Lichttechnik nach und zeigt, dass es dabei nie nur um Beleuchtung ging. Zwar wird Thomas Edison oft als Erfinder der Glühlampe angesehen, entscheidend war aber vor allem der Aufbau eines stabilen Systems zur Stromerzeugung und -verteilung. Elektrisches Licht trat damit nicht einfach an die Stelle des Gaslichts, sondern entwickelte sich schrittweise zu einer Technik mit weitreichendem gesellschaftlichem Anspruch.

Im Zentrum steht die These, dass Lichttechnik im Laufe des 20. Jahrhunderts den Anspruch erhob, die Sonne nicht nur zu ersetzen, sondern zu übertreffen. Licht wurde messbar gemacht, normiert und technisch definiert, wobei menschliche Wahrnehmung, biologische Wirkungen und kulturelle Bedeutungen oft in den Hintergrund traten. Besonders kritisch betrachtet das Kapitel, dass der Begriff „Licht“ in der Lichttechnik auf den Teil der Strahlung verengt wurde, der dem menschlichen Sehen dient, obwohl Licht für Pflanzen, Tiere und Menschen weit mehr bedeutet. Zudem “sehen” Tiere und Pflanzen Licht fast völlig anders als der Mensch.

Ein wesentlicher Schwerpunkt liegt auf Matthew Luckiesh und der Idee des „künstlichen Tageslichts“. In den 1920er Jahren verband er Beleuchtung mit Gesundheit, Leistungsfähigkeit und Fortschritt. Daraus entstand die Vorstellung einer „elektrischen Sonne“, die natürliche Rhythmen überflüssig machen und jederzeit optimale Bedingungen schaffen könne. Diese Vision beeinflusste Beleuchtungsplanung, Arbeitswelt, Medizin und Architektur tiefgreifend.

Das Kapitel zeigt aber auch die problematischen Folgen dieses Denkens: künstliches Licht wurde zunehmend als Mittel zur Steuerung von Gesundheit, Verhalten und Produktivität verstanden, ohne dass die biologischen und zeitlichen Bedingungen des natürlichen Lichts ausreichend berücksichtigt wurden. Daraus ergaben sich Fehlentwicklungen in Normung, Lichtplanung und Bauweise – bis hin zu fensterlosen Gebäuden und gesundheitlich problematischen Innenräumen.

Insgesamt ist dieses Kapitel eine kritische Kultur- und Technikgeschichte des künstlichen Lichts. Es argumentiert, dass die moderne Lichttechnik mit ihrem Streben nach Messbarkeit, Kontrolle und Ersatz der Natur den Begriff Licht verengt und dabei gesundheitliche, ökologische und menschliche Zusammenhänge zu wenig beachtet hat.

Der Aufstieg - Idealisten danken ab – Bürokraten übernehmen

Dieses Kapitel analysiert den Aufstieg der künstlichen Beleuchtung im Spannungsfeld von Industrialisierung, Scientific Management und arbeitswissenschaftlicher Rationalisierung. Im Zentrum steht die Rekonstruktion der Hawthorne-Experimente, die ursprünglich den Zusammenhang zwischen Beleuchtung und Arbeitsleistung empirisch belegen sollten, jedoch in methodischer, wissenschaftshistorischer und disziplinärer Hinsicht zu Befunden führten, die weit über die Lichttechnik hinauswirkten.

Gezeigt wird, dass die Experimente nicht nur an der Komplexität sozialer und organisatorischer Einflussfaktoren scheiterten, sondern zugleich die Grenzen eines reduktionistischen, auf Quantifizierung und Wirtschaftlichkeit fixierten Forschungsverständnisses offenlegten. Das Kapitel verortet die Hawthorne-Studien im ideengeschichtlichen Kontext des Taylorismus, diskutiert ihre methodischen Voraussetzungen und beschreibt ihre Umdeutung innerhalb des Human-Relations-Ansatzes, in dem physikalische Umweltfaktoren gegenüber sozialen Beziehungen und Führungsstilen in den Hintergrund traten.

Darauf aufbauend wird untersucht, wie die Lichttechnik gleichwohl an produktivitäts- und gesundheitsbezogenen Wirkungsbehauptungen festhielt und wie sich diese in Normen, Planungsprinzipien und institutionellen Strukturen insbesondere in Deutschland verfestigten.

Besondere Aufmerksamkeit gilt dabei der historischen Verknüpfung von Beleuchtung, Arbeitsschutz, Büroorganisation und politischer Instrumentalisierung in den 1930er Jahren sowie dem langfristigen Fortwirken standardisierter Konzepte wie der Allgemeinbeleuchtung. Insgesamt zeigt das Kapitel, dass der „Aufstieg“ der elektrischen Sonne nicht als lineare Erfolgsgeschichte verstanden werden kann, sondern als konfliktreiche Entwicklung, in der wissenschaftliche Unsicherheiten, ökonomische Interessen, normative Setzungen und kulturell-politische Deutungen eng miteinander verflochten sind.

Insgesamt plädiert das Kapitel für ein erweitertes Verständnis von Blendung, das nicht nur das Vermeiden negativer Effekte, sondern die tatsächliche Qualität des Sehens, die Arbeitssituation und die Wahrnehmung des Menschen in realen Umgebungen in den Mittelpunkt stellt.

Im Zenit und weiter

Dieses Kapitel beschreibt den allmählichen Bedeutungsverlust der künstlichen Beleuchtung als einstiges Fortschrittssymbol trotz einer hohen technischen Qualität, die erreicht worden ist. Seit den 1980er Jahren ist deutlich geworden, dass Menschen Tageslicht fast immer bevorzugen und künstliches Licht am Arbeitsplatz oft als störend, belastend oder sogar gesundheitlich problematisch empfinden. Gleichzeitig verlagerte sich das Interesse der Forschung stärker auf Energieeffizienz statt auf Lichtqualität.

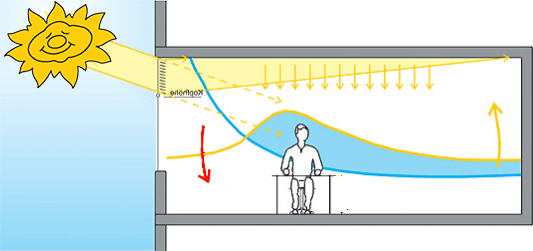

Ein zentraler Kritikpunkt ist, dass sich die Lichttechnik an falschen Vorbildern orientiert hat – vor allem an der Sonne und an hohen Beleuchtungsstärken in der Natur. Diese Maßstäbe sind für Innenräume ungeeignet, weil Menschen auch in der Natur nicht dauerhaft unter maximaler Helligkeit leben, sondern Schatten, Wechsel und Anpassungsmöglichkeiten brauchen. Technische Versuche, natürliche Lichtverhältnisse künstlich nachzuahmen, gelten deshalb weitgehend gescheitert.

Besonders scharf kritisiert wird der Umgang mit der Leuchtdichte, also jener Größe, die für Helligkeitsempfinden und Blendung entscheidend ist. Statt sich daran zu orientieren, hat die Lichttechnik lange mit ungeeigneten Mess- und Bewertungsverfahren gearbeitet. Dadurch sind scheinbar blendfreie Beleuchtungssysteme entwickelt und normiert worden, die in der Praxis oft stärker blenden und schlechter akzeptiert werden als behauptet.

Ein weiterer Schwerpunkt ist die Kritik an Normen und Planungsvorgaben. Diese haben Nutzer und Planer entmündigt, indem sie einheitliche Allgemeinbeleuchtung und starre Regeln durchsetzten, ohne individuelle Unterschiede, Sehbedürfnisse oder persönliche Kontrolle ausreichend zu berücksichtigen. Das hat zu unflexiblen, unbehaglichen und oft ineffizienten Arbeitsumgebungen geführt.

Abschließend wird künstliches Licht auch im größeren gesellschaftlichen Zusammenhang betrachtet: Lichtverschmutzung, Energieverschwendung und negative Auswirkungen auf Mensch, Tier und Umwelt haben das Image der „elektrischen Sonne“ zusätzlich beschädigt. Insgesamt lautet die These des Buches, dass der Abstieg der künstlichen Beleuchtung nicht bloß äußeren Umständen geschuldet ist, sondern vor allem grundlegenden Denkfehlern, falschen Normen und einer technikzentrierten Lichtphilosophie.

Legendenbildung und Märchenerzählung – Ungewöhnliche Aktivitäten für Ingenieure

Dieser Teil des Buches behandelt in sechs Kapiteln, dass viel von dem lichttechnischen Wissen keinen belastbaren Hintergrund hat.

Kapitel 1 erklärt, dass die Beleuchtungsstärke als physikalische Messgröße im Labor zwar klar bestimmbar ist, ihre praktische Bedeutung für reale Arbeitsplätze jedoch stark begrenzt bleibt. Der Text zeigt, dass Richtung, Verteilung und Reflexion des Lichts für das tatsächliche Sehen entscheidend sind, in Normen und Messverfahren aber oft unzureichend berücksichtigt werden. Dadurch entsteht eine scheinbar exakte, in Wirklichkeit aber nur eingeschränkt aussagekräftige Grundlage für Beleuchtungsanforderungen.

Kapitel 2 greift Boyces märchenhafte Erzählform auf, um zu verdeutlichen, dass Lichttechnik seit langem nach einer objektiven Formel sucht, mit der sich optimale Beleuchtung wissenschaftlich begründen ließe. Die zentrale Aussage ist jedoch, dass eine solche Formel nicht existiert und Empfehlungen deshalb immer auf Aushandlung, Erfahrung und Konsens beruhen. Zugleich wird gezeigt, dass Beleuchtung nur ein Faktor unter vielen in der Arbeitsumgebung ist und nie isoliert über den Erfolg einer Planung entscheiden kann.

Kapitel 3 begründet, warum es keine einfache und allgemeingültige Beziehung zwischen Beleuchtung und Arbeitsleistung geben kann. Besonders kritisch hinterfragt der Text den unscharfen Begriff der Sehleistung, der in Normen zwar zentral verwendet, aber nicht präzise definiert wird. Daraus folgt, dass Beleuchtungsnormen Ziele benennen, ohne klar zu erklären, wie diese praktisch und verlässlich erreicht werden sollen.

Kapitel 4 untersucht, wie in der Lichttechnik durch scheinbar wissenschaftliche Darstellungen Legenden entstehen. Anhand von Diagrammen, Akteuren und institutionellen Rollen wird gezeigt, dass visuelle Aufbereitungen leicht Überzeugungskraft entfalten, auch wenn ihre Aussagekraft fragwürdig ist. So entsteht eine wissenschaftlich wirkende Erzählung, die sich über Fachliteratur, Institutionen und Ausbildung weiterverbreitet.

Kapitel 5 analysiert ein häufig zitiertes Diagramm, das belegen soll, dass mehr Licht die Arbeitsleistung steigert und Ermüdung senkt. Der Text zeigt jedoch, dass die Darstellung methodische und grafische Schwächen hat, etwa durch verzerrende Achsen und unklare Bezugsgrößen. Damit wird deutlich, dass der behauptete experimentelle Nachweis bei genauer Betrachtung nicht belastbar ist.

Kapitel 6 zeigt, wie sich die Legende von der leistungssteigernden Wirkung höheren Lichts über Jahrzehnte in Broschüren, Schulungsunterlagen und Beratungsunterlagen fortgesetzt hat. Dabei wurden fragwürdige Darstellungen immer wieder übernommen, grafisch modernisiert und als scheinbar gesicherte Erkenntnisse weitergegeben, und das sogar von staatlichen Stellen. Zugleich weist das Kapitel darauf hin, dass Licht durchaus weitreichende Wirkungen auf den Menschen haben kann, diese aber komplexer sind als die einfache Behauptung „mehr Licht = mehr Leistung“.

Die Methode Wissenschaft, mit der man Wissenschaft verhindert

Dieses Kapitel kritisiert nicht Wissenschaft an sich, sondern bestimmte Vorgehensweisen, mit denen wissenschaftliches Arbeiten in sein Gegenteil verkehrt werden kann. Die zentrale These lautet, dass Methoden, die eigentlich der Erkenntnisgewinnung dienen sollen, in der Praxis häufig dazu benutzt werden, gewünschte Ergebnisse zu erzeugen, unpassende Befunde zu verschleiern oder unbequeme Erkenntnisse zu ignorieren. Am Beispiel der Lichttechnik zeigt der Autor, wie aus einzelnen wahren oder plausiblen Aussagen weitreichende Behauptungen konstruiert werden, die wissenschaftlich klingen, aber oft weder sauber begründet noch für den jeweiligen Anwendungsbereich hinreichend belegt sind.

Zu Beginn wird erläutert, dass sogenannte „science faction“ besonders problematisch ist: Dabei werden unstrittige Fakten mit Vermutungen, Plausibilitäten und Deutungen vermischt, bis am Ende der Eindruck eines wissenschaftlichen Nachweises entsteht. Aus einfachen, nachvollziehbaren Beobachtungen wird schrittweise eine große Behauptung abgeleitet, etwa dass mehr Beleuchtungsstärke automatisch gesünder, leistungsfördernder oder weniger ermüdend sei. Der Einwand des Autors lautet, dass Plausibilität noch kein Beweis ist und dass solche Argumentationsketten häufig gerade deshalb überzeugen, weil ihre einzelnen Bestandteile nicht völlig falsch wirken.

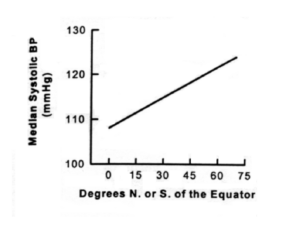

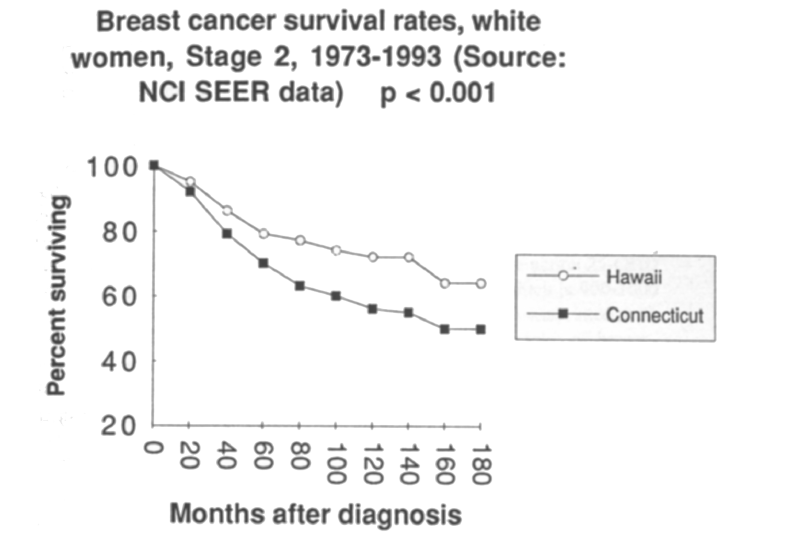

Ein zentrales Angriffsziel ist das sogenannte P-Hacking. Der Autor beschreibt damit die Praxis, aus Daten so lange passende Ausschnitte, Vergleiche oder Versuchsanordnungen herauszusuchen, bis ein statistisch signifikantes Ergebnis erscheint. Kritisiert wird vor allem, dass statistische Signifikanz häufig fälschlich als inhaltliche Bedeutung verstanden wird. Ein Ergebnis kann rechnerisch signifikant sein und trotzdem wenig über die eigentliche Praxis aussagen. Darüber hinaus zeigt der Text, dass mit genügend großer Fallzahl auch sehr kleine Unterschiede signifikant werden können. Dadurch entsteht die Gefahr, dass gewünschte Aussagen als wissenschaftliche Erkenntnisse verkauft werden, obwohl ihre Relevanz unklar bleibt.

An mehreren Beispielen aus der Licht- und Arbeitsmedizin wird verdeutlicht, wie problematisch dieser Umgang mit Signifikanz sein kann. So verweist der Autor auf Studien und Leitlinien, in denen statistisch starke Effekte behauptet werden, ohne dass die zugrunde liegenden Ursachen ausreichend erklärt werden. Besonders scharf kritisiert er Versuche, aus Untersuchungen in speziellen Umgebungen, etwa psychiatrischen Einrichtungen oder medizinischen Sondersituationen, allgemeine Aussagen über die gesundheitliche Wirkung von Beleuchtung im Alltag oder am Arbeitsplatz abzuleiten. Der Vorwurf lautet, dass hier häufig von Spezialfällen auf völlig andere Kontexte geschlossen wird, ohne die Übertragbarkeit der Ergebnisse ernsthaft zu prüfen.

Ein weiteres Muster sieht der Autor im HARKing, also im nachträglichen Formulieren einer Hypothese, nachdem die Ergebnisse bereits bekannt sind. Wer so vorgeht, erweckt den Eindruck, eine Untersuchung habe von Anfang an eine klare theoretische Grundlage gehabt, obwohl die Deutung erst im Nachhinein passend gemacht wurde. Ergänzt wird dies durch das sogenannte SHARKing, bei dem missliebige Hypothesen oder ganze Projekte stillschweigend verschwinden, wenn sich die erhofften Resultate nicht einstellen. Beide Praktiken verfälschen nach Ansicht des Autors den wissenschaftlichen Prozess, weil sie Misserfolge und Unsicherheiten unsichtbar machen, obwohl gerade diese für echten Erkenntnisfortschritt wichtig wären.

Besonders wirksam erscheint dem Autor jedoch nicht die Manipulation von Daten, sondern das Ignorieren von Wissen. Er argumentiert, dass in der Lichttechnik viele ältere, gut begründete Erkenntnisse nicht deshalb verdrängt wurden, weil sie widerlegt worden wären, sondern weil sie nicht in aktuelle technische, wirtschaftliche oder gestalterische Interessen passten. An Beispielen aus Architektur, Normung und Blendungsforschung zeigt er, dass bekannte Probleme über Jahrzehnte nicht konsequent aufgegriffen wurden. Dasselbe gelte für das Thema Flimmern: Beschwerden von Betroffenen seien lange abgewiesen worden, obwohl sich später zeigte, dass die Störung real ist und gesundheitliche Folgen haben kann. Für den Autor ist dies ein Beleg dafür, dass wissenschaftliche oder technische Gemeinschaften unbequeme Tatsachen oft nicht aktiv widerlegen, sondern schlicht an ihnen vorbeiarbeiten.

Als besonders tief liegendes Problem beschreibt der Text die mangelnde Validierung. Gemeint ist die Frage, ob eine gemessene Größe, ein Versuch oder ein Modell tatsächlich das erfasst, was inhaltlich behauptet wird. Der Autor macht deutlich, dass dies keine rein theoretische Frage ist, sondern praktische Folgen hat: Wenn ein Messwert nicht valide ist, kann ein ganzes System auf falschen Annahmen beruhen. An Beispielen aus der Kerntechnik, der Beleuchtung, der Blendungsbewertung und der Leistungsforschung zeigt er, dass zwischen physikalischer Messgröße und menschlicher Wahrnehmung oder praktischer Wirkung oft keine einfache, direkte Beziehung besteht. Gerade in der Lichttechnik wird aber häufig so getan, als ließen sich komplexe Wirkungen mit wenigen linearen Größen eindeutig erfassen.

Daran schließt die Kritik an dem unscharfen Begriff der Lichtqualität an. Der Autor bemängelt, dass die Lichttechnik zwar ständig von Qualität, Wohlbefinden, Sehkomfort, Sicherheit und Wirtschaftlichkeit spreche, aber keine klaren und überprüfbaren Kriterien formuliere, nach denen sich die Qualität einer Beleuchtung tatsächlich bestimmen ließe. Solange der Zweck einer Beleuchtung nicht präzise festgelegt sei, bleibe auch unklar, woran ihre Güte gemessen werden soll. Dadurch wird es möglich, sehr verschiedene und teils widersprüchliche Anforderungen miteinander zu vermischen und dennoch den Eindruck einer objektiven Bewertung zu erzeugen.

Am Ende unterscheidet der Autor grundsätzlich zwischen Wissenschaft und Technik. Wissenschaft ziele darauf ab, Wissen dauerhaft zu gewinnen, Irrtümer offen zu legen und Erkenntnisse nachvollziehbar einzuordnen. Technik hingegen arbeitet oft unter Innovations-, Markt- und Verbesserungsdruck; dort genügt es häufig, dass etwas besser funktioniert als zuvor, auch wenn es noch unvollkommen ist. Diese Logik erklärt für den Autor manche Fehlentwicklungen, entschuldigt sie aber nicht.

Die Gesamtbotschaft des Kapitels ist, dass gerade in einem anwendungsnahen Feld wie der Lichttechnik wissenschaftliche Begriffe, statistische Methoden und normative Aussagen mit besonderer Sorgfalt behandelt werden müssten. Andernfalls entsteht eine Scheinwissenschaft, die mit dem Anschein von Exaktheit arbeitet, ohne die Voraussetzungen echter wissenschaftlicher Erkenntnis einzulösen.

Erbschaft der 1920er Jahre – Wo Sie heutiges Wissen bestimmt

Das Kapitel untersucht, wie stark Vorstellungen aus den 1920er Jahren das heutige Denken über Licht, Beleuchtung und gute Sehbedingungen noch immer prägen.

Im Mittelpunkt steht die Kritik, dass viele Grundannahmen der Lichttechnik zwar den Anschein von Genauigkeit und Wissenschaftlichkeit haben, aber bis heute nur unzureichend erklären, was Menschen tatsächlich für gutes Sehen, angenehmes Arbeiten und räumliches Wohlbefinden benötigen.

Es wird gezeigt, dass zentrale Begriffe und Messgrößen – etwa zur Definition von Licht, zur Beleuchtungsstärke oder zur Wirkung von Blendung – historisch gewachsen sind und oft weiterverwendet werden, obwohl ihre Aussagekraft begrenzt oder ihre Grundlagen umstritten sind.

Ausführlich wird beschrieben, dass Normen und technische Standards häufig auf vereinfachten Modellen beruhen, die sich gut messen und vereinheitlichen lassen, aber den menschlichen Wahrnehmungsbedingungen nicht immer gerecht werden. An Beispielen wie Ermüdung, der Frage nach der „richtigen“ Lichtmenge, direkter und indirekter Beleuchtung, Tischleuchten sowie der Forderung nach gleichmäßiger Helligkeit macht der Text deutlich, dass viele heute selbstverständliche Regeln nicht das Ergebnis gesicherten Wissens sind, sondern oft auf tradierten Annahmen, industriellen Interessen oder normativen Festlegungen beruhen.

Besonders kritisch betrachtet der Beitrag den Widerspruch zwischen technischer Messbarkeit und tatsächlicher Erfahrung: Was in Richtlinien als objektiv und sinnvoll erscheint, kann aus Sicht der Nutzerinnen und Nutzer unpraktisch, unangenehm oder sogar widersprüchlich sein.

Insgesamt versteht sich der Beitrag als grundsätzliche Kritik an einer Beleuchtungskultur, die über Jahrzehnte hinweg ihre eigenen Maßstäbe verfestigt hat, ohne sie ausreichend an menschlichen Bedürfnissen, architektonischer Qualität und neuen wissenschaftlichen Erkenntnissen zu überprüfen. Der Beitrag plädiert deshalb dafür, Licht nicht nur als eine technisch-physikalische Größe, sondern stärker als menschlich, biologisch und räumlich wirksames Phänomen zu begreifen.

Geheimnisse in Blau

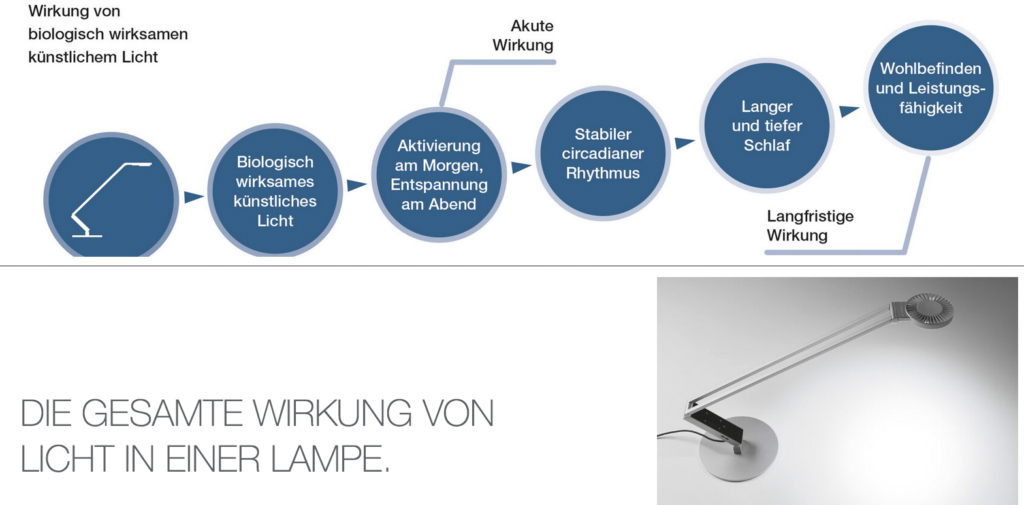

Dieses Kapitel analysiert kritisch die verbreitete Annahme, blau angereichertes künstliches Licht wirke grundsätzlich gesundheitsförderlich und könne circadiane Prozesse in verlässlicher Weise optimieren.

Ausgangspunkt ist die Beobachtung, dass dem Blauanteil des Lichts sowohl historisch als auch in aktuellen Debatten eine besondere biologische Wirksamkeit zugeschrieben wird. Vor diesem Hintergrund rekonstruiert der Text ältere Deutungen von Blaulicht als heilsamer oder leistungssteigernder Größe und zeigt, dass gegenwärtige Konzepte wie melanopische Bewertung, mel-EDI und Human-Centric Lighting zwar an wissenschaftliche Befunde anknüpfen, in ihrer praktischen Anwendung jedoch häufig auf vereinfachenden Prämissen beruhen.

Im Zentrum der Argumentation steht die Kritik, dass die Reduktion gesundheitlicher Lichtwirkungen auf einzelne spektrale Anteile dem komplexen Zusammenspiel von visuellen und nicht-visuellen Effekten, Tages- und Jahresrhythmen, Arbeitsplatzbedingungen, Tageslichtverfügbarkeit sowie technischer Beleuchtungsplanung nicht gerecht wird. Weder das Licht des Tages noch das Blau des Himmels und der Meere sind weltweit gleich.

Besondere Aufmerksamkeit gilt dabei der unzureichenden Berücksichtigung von Bildschirmarbeit, der spektralen Zusammensetzung künstlicher Lichtquellen, potenziellen Blaulichtschäden sowie der Frage, inwiefern rot- und infrarothaltige Anteile des natürlichen Lichts kompensatorische Funktionen besitzen könnten. Gerade diese werden in der jüngsten Literatur thematisiert, weil dem LED-Licht fast immer die Anteile im Infrarot fehlen.

Darüber hinaus zeigt das Kapitel, dass normative Empfehlungen zur lichtbiologischen Optimierung häufig mit realen sozialen, geografischen und beruflichen Lebensbedingungen kollidieren. Insgesamt plädiert der Text deshalb für eine integrative Perspektive auf Licht, die biologische, visuelle, technische, arbeitswissenschaftliche und alltagspraktische Dimensionen zusammenführt und gesundheitliche Bewertungen nicht auf eindimensionale Messgrößen oder schematische Steuerungsmodelle verkürzt.

Die Legende vom gesunden Licht reloaded

Das Kapitel rekonstruiert die Entwicklung des Diskurses über „Licht und Gesundheit“ von frühen programmatischen Erwartungen im 20. Jahrhundert bis hin zu gegenwärtigen Konzepten der Lichtplanung und unterzieht Positionen aus Forschung, Industrie und Normung einer umfassenden kritischen Analyse.

Ausgangspunkt ist die Beobachtung, dass die Hoffnung, gesundheitliche Wirkungen des Lichts technisch gezielt nutzbar zu machen, in wiederkehrenden Wellen auftritt, ohne dass frühere Fehlschläge oder methodische Probleme hinreichend aufgearbeitet worden wären. Im Zentrum der Argumentation steht die These, dass Tageslicht hinsichtlich seiner gesundheitlichen Relevanz, seiner physiologischen Wirksamkeit und seiner subjektiven Qualität eine grundlegend andere Bedeutung besitzt als künstliche Beleuchtung und dass diese Differenz in der lichttechnischen Debatte wiederholt durch technikzentrierte und marktorientierte Deutungen relativiert worden ist.

Die seit den frühen 2000er Jahren intensivierte Erforschung nicht-visueller beziehungsweise melanopischer Lichtwirkungen führte zwar zu einer erheblichen Ausweitung wissenschaftlicher Aktivitäten sowie zur Entwicklung normativer und anwendungsbezogener Konzepte wie Human Centric Lighting und Integrative Lighting; das Kapitel gelangt jedoch zu dem Befund, dass daraus bislang weder hinreichend belastbare wissenschaftliche Grundlagen noch praktisch überzeugende Lösungen hervorgegangen sind.

Kritisch hervorgehoben werden insbesondere die Reduktion komplexer Lichtwirkungen auf eng gefasste physiologische Parameter, die Ausblendung psychologischer, sozialer und raumphysikalischer Bedingungen sowie die Tendenz, aus partiellen Befunden weitreichende gesundheitsbezogene Versprechen abzuleiten.

Darüber hinaus problematisiert das Kapitel die normativen und begrifflichen Verengungen, mit denen die Vielfalt optischer, biologischer und subjektiver Wirkungen des Lichts auf einen kleinen Ausschnitt melanopischer beziehungsweise circadianer Effekte reduziert wird.

Ein weiterer Schwerpunkt liegt auf der Frage der praktischen Umsetzbarkeit: Anhand von Anforderungen an vertikale oder zylindrische Beleuchtungsstärken sowie an zeitlich gesteuerte Lichtregime zeigt der Artikel, dass viele der vorgeschlagenen Modelle mit den physikalischen Gegebenheiten realer Arbeitsräume, mit typischen Nutzungsweisen und mit elementaren Seh- und Komfortanforderungen nur begrenzt vereinbar sind.

Insgesamt diagnostiziert das Kapitel einen Vertrauensverlust in die künstliche Beleuchtung, der nicht primär auf mangelnde technologische Leistungsfähigkeit, sondern auf Blendung, Flimmern, problematische Standardisierungen, fehlende Nutzerorientierung und vereinfachende Vermarktungsstrategien zurückzuführen ist.

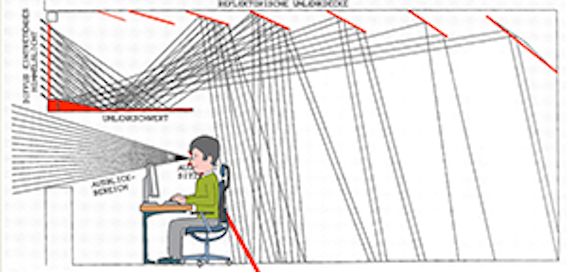

Blendung – Was ich schon immer wusste und nie nachfragen wollte

Dieses Kapitel untersucht den Begriff der Blendung in seinen unterschiedlichen Bedeutungen und konzentriert sich dabei auf jene Erscheinungsformen, die das Sehen durch Licht beeinträchtigen.

Es zeigt, dass Blendung nicht nur als klar messbare physiologische Minderung der Sehleistung verstanden werden kann, sondern auch als psychologisch wahrgenommene Störung, deren Bewertung in Forschung und Normung vielfach auf unsicheren oder veralteten Grundlagen beruht.

Der Text kritisiert insbesondere etablierte Verfahren wie UGR und verwandte Blendungsmodelle, da sie komplexe reale Sehbedingungen, moderne Lichtquellen, Arbeitsaufgaben, Farbwirkungen und dynamische Wahrnehmungsprozesse nur unzureichend erfassen. Darüber hinaus wird argumentiert, dass zahlreiche belastende Lichteffekte – etwa Reflexionen auf Bildschirmen, Kontrastverluste auf Sehobjekten, Umfeldblendung oder sogenannter Lichtdruck – fachlich zwar bekannt, aber normativ kaum angemessen berücksichtigt sind.

Trotz intensiver Forschung sind die Blendungsbewertungsverfahren nie validiert worden. Zwar wird zu einer Leuchte ein UGR-Wert dreistellig angegeben. Mit irgendeiner bestimmten Wirkung hat die Zahl aber nichts gemein.

Insgesamt plädiert das Kapitel für ein erweitertes Verständnis von Blendung, das nicht nur das Vermeiden negativer Effekte, sondern die tatsächliche Qualität des Sehens, die Arbeitssituation und die Wahrnehmung des Menschen in realen Umgebungen in den Mittelpunkt stellt.

Das Phoebus-Kartell – Gerücht - Legende – Realität

Dieses Kapitel untersucht das Phoebus-Kartell als eines der ersten globalen Kartelle der Wirtschaftsgeschichte und ordnet dessen Bedeutung zwischen technischer Standardisierung, Marktregulierung und geplanter Obsoleszenz ein. Im Zentrum steht die Frage, ob die Festlegung einer Lebensdauer von 1.000 Stunden für Glühlampen als verbraucherorientierte Normung oder als wettbewerbsbeschränkende Absprache zu bewerten ist.

Dazu werden zunächst die Begriffe Kartell, Standardisierung und Normung historisch und begrifflich voneinander abgegrenzt. Anschließend zeigt der Beitrag, dass die Bewertung des Phoebus-Kartells nur vor dem Hintergrund der technischen, wirtschaftlichen und messtechnischen Besonderheiten von Leuchtmitteln möglich ist, da die Bestimmung ihrer Lebensdauer und Lichtqualität komplex und historisch stark von industriepolitischen Entscheidungen geprägt war.

Anhand von Archivquellen, zeitgenössischen Berichten und späteren Deutungen wird deutlich, dass Phoebus nicht nur Marktgebiete aufteilte, sondern auch Qualitäts- und Lebensdauervorgaben verankerte. Das Kapitel arbeitet zugleich heraus, dass bereits internationale Normungsinstitutionen im Bereich des Lichts existierten, wodurch die behauptete Notwendigkeit eines solchen Zusammenschlusses kritisch hinterfragt wird.

Abschließend wird das Ende des Kartells sowie der tiefgreifende Wandel der Lichtindustrie skizziert. Insgesamt versteht sich der Beitrag als kritische Einordnung eines industriehistorischen Falls, der bis heute exemplarisch für die Spannungen zwischen Innovation, Standardisierung, Marktbeherrschung und Verbraucherschutz steht.

PLACAR – Die letzte Plasmalampe

Das Kapitel zeichnet die Geschichte des PLACAR-Projekts nach, eines vom Bundesministerium für Bildung und Forschung geförderten Verbundvorhabens zur Entwicklung von Plasmalampen für circadiane Rhythmen.

Ausgangspunkt war die wachsende Einsicht, dass künstliches Licht nicht nur der visuellen Beleuchtung dient, sondern auch biologische Prozesse beeinflusst. Vor allem die Unterdrückung der Melatoninausschüttung durch nächtliches Licht wurde als gesundheitlich problematisch angesehen. Daraus entstand die Idee, künstliche Beleuchtung zeitlich und spektral an den natürlichen Tagesrhythmus des Menschen anzupassen. Gesucht wurde deshalb nach zwei unterschiedlichen Lampentypen: einer „Morgenlampe“ mit höherem Blauanteil zur Förderung von Wachheit und Aktivierung sowie einer „Abendlampe“ mit möglichst geringem Blauanteil, um den abendlichen Anstieg des Melatonins nicht zu stören.

Es zeigte sich jedoch bald, dass die ehrgeizigen Erwartungen des Projekts in der praktischen Umsetzung kaum erfüllt wurden. Zwar sollten die neuen Lampen nicht nur biologisch wirksam, sondern zugleich für Arbeits- und Innenräume geeignet, energieeffizient, farbtreu und langlebig sein; genau an diesen Anforderungen scheiterten die Entwicklungen jedoch weitgehend.

Die als Abendlampen vorgesehenen Natriumdampfhochdrucklampen wiesen sehr hohe Leistungen, eine schlechte oder nur mit erheblichen Kompromissen verbesserbare Farbwiedergabe sowie lange Anlaufzeiten auf und erschienen daher für Wohn- oder Büroräume untauglich. Auch die Morgenlampe bereitete erhebliche Schwierigkeiten: Lichtstromabnahme, Farbdrift und mangelnde Langzeitstabilität machten sie für einen realen Einsatz unattraktiv.

Insgesamt kommt das Kapitel zu einem deutlich kritischen Urteil: Das Projekt wurde trotz anfänglicher Versprechen ohne praktische Folgen beendet, weil die entwickelten Plasmalampen technisch zu unflexibel, zu leistungsstark und letztlich nicht marktfähig waren. Als eigentlich zukunftsfähige Lösung erwies sich stattdessen die LED-Technik, die sich wesentlich besser steuern lässt und die Plasmalampenentwicklung rasch überholte. PLACAR verschwand fast spurlos.

Angaben für die Lebensdauer von Leuchtmitteln

Das Kapitel setzt sich mit der Lebensdauer von Leuchtmitteln auseinander, aus der die Hersteller ein großes Geheimnis machen.

Die Lebensdauer von Leuchtmitteln ist keine eindeutig feststehende Größe, sondern hängt von technischen Kriterien, Betriebsbedingungen und statistischen Verfahren ab. Diese Verfahren unterscheiden sich erheblich voneinander.

In der Darstellung eines bekannten Herstellers liest sich das Ganze folgendermaßen: „Für LED-Leuchten ist keine einheitlich gebräuchliche Definition der Lebensdauer - sei es eine „Nennlebensdauer” oder eine „wirtschaftliche Lebensdauer” - etabliert. Stattdessen ist es üblich, die „mittlere Bemessungslebensdauer” auszuweisen, die sich auf einen spezifizierten Grad der Lichtstromdegradation bezieht.“

Das Kapitel zeigt, dass sich der Begriff je nach Leuchtmittel stark unterscheidet: Bei Glühlampen wurde Lebensdauer meist über die Ausfallrate bestimmt, bei Entladungslampen über den wirtschaftlich sinnvollen Betrieb und den Rückgang des Lichtstroms, etwa als L70 oder L80.

Bei LEDs ist die Bewertung noch komplexer, weil neben dem Lichtstromverlust auch Unterschiede zwischen einzelnen LED-Elementen sowie Totalausfälle berücksichtigt werden müssen, etwa durch Angaben wie L70B10C10F10.

Insgesamt verdeutlicht der Beitrag, dass Herstellerangaben zur Lebensdauer nur im Zusammenhang mit den zugrunde liegenden Definitionen und Einsatzbedingungen sinnvoll verstanden werden können.