Wer das Licht der Wahrheit sehen will,

muss erst durch den Tunnel

der Ungewissheit kriechen.

Anonymus

Wenn Licht krank macht: Zur langen Suche nach Ursache und Wirkung, kurzgefasst

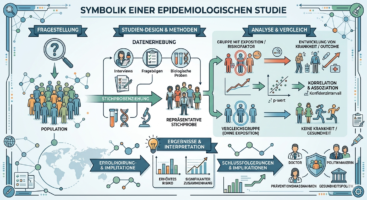

Der Beitrag analysiert die komplexen und bislang nur unvollständig geklärten Zusammenhänge zwischen Lichtexposition und menschlicher Gesundheit mit besonderem Fokus auf potenzielle Beziehungen zur Krebsentstehung. Ausgehend von der Feststellung, dass bereits grundlegende Lichtwirkungen – wie die Sehleistung – wissenschaftlich schwer eindeutig zu fassen sind, wird gezeigt, dass sich diese Schwierigkeit bei der Untersuchung langfristiger gesundheitlicher Effekte erheblich verstärkt. Auf Basis arbeitswissenschaftlicher, photobiologischer und medizinischer Ansätze wird ein Wirkmodell vorgestellt, das primäre (direkte), sekundäre (mittelbar vermittelte) und tertiäre (langfristige) Lichtwirkungen unterscheidet. Historische und experimentelle Befunde zur kanzerogenen Wirkung ultravioletter Strahlung werden ebenso diskutiert wie neuere Erkenntnisse zu hormonellen Veränderungen, circadianen Störungen und Licht in der Nacht. Diese indirekten Wirkpfade, etwa über Melatonin und Cortisolregulation, werden als zentral für das Verständnis möglicher Zusammenhänge zwischen Licht und bestimmten Krebserkrankungen herausgearbeitet. Der Beitrag verdeutlicht, dass Licht nur selten als unmittelbarer Krankheitsauslöser wirkt, sondern überwiegend Bestandteil komplexer biologischer Wirkungsketten ist. Abschließend wird betont, dass die Erforschung von Lichtwirkungen auf die Gesundheit zwingend interdisziplinäre Ansätze erfordert und einfache Ursache Wirkungs Modelle der Problematik nicht gerecht werden.

Wenn Licht krank macht: Zur langen Suche nach Ursache und Wirkung

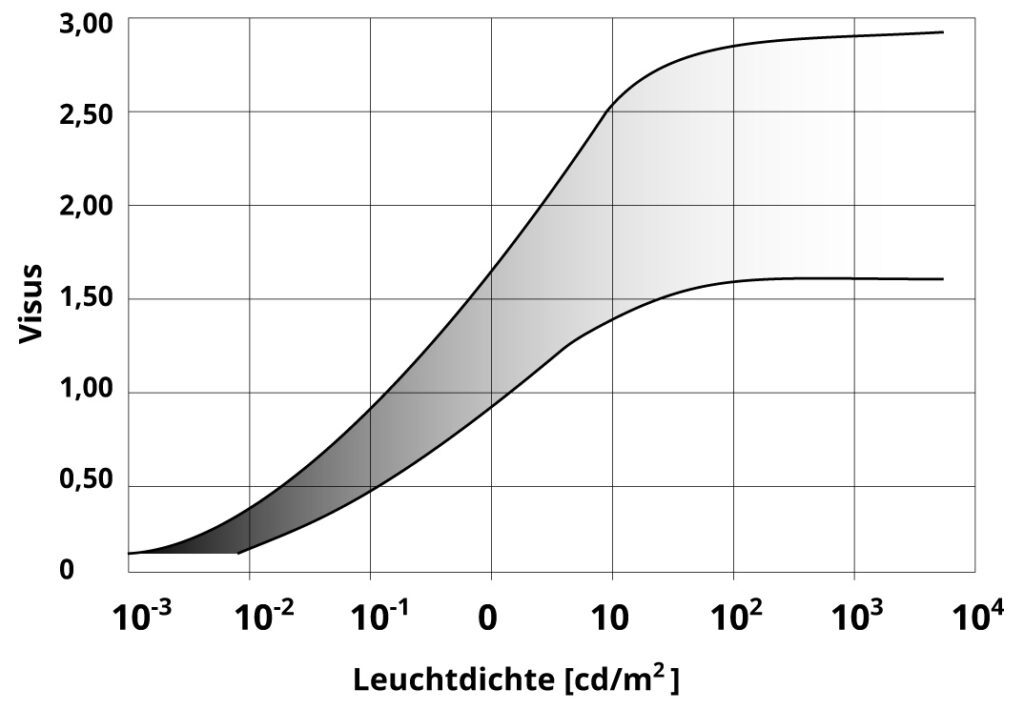

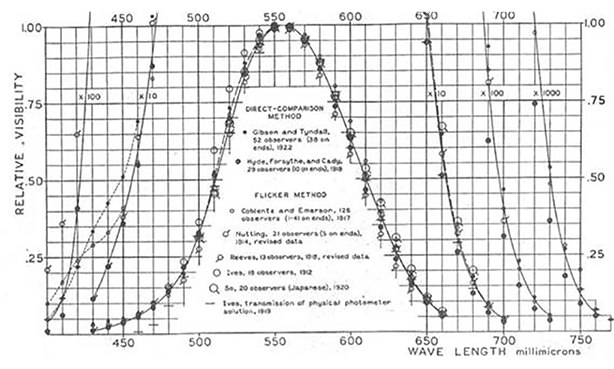

Viele Menschen können nicht glauben, dass es so schwer ist, eine bestimmte Wirkung von Licht zu ermitteln. Dabei fängt die Schwierigkeit bereits bei dem üblichen Zweck an, den man mit einer Lichtanwendung gemeinhin verfolgt, Sehen. Vermutlich haben Menschen künstliches Licht – hier gemeint die Öllampe – erfunden, um Sehleistung zu erzeugen. Das war vor mehr als 17.000 Jahren. Das Feuer war schon länger bekannt. Daher können die Menschen, die die Öllampe geformt haben, damit nur bezweckt haben, das Feuer dorthin zu tragen, wo man etwas sehen wollte. Wie erklärt man dann, dass die Sehleistung heute so unbrauchbar definiert ist, dass man mit der Definition kaum etwas anfangen kann? (s. Es war einmal … - Drei Ingenieure und das Märchen von der Sehleistung).

Wenn diese scheinbar so triviale Aufgabe schwer fällt, wie mühsam muss es erst werden, wenn man nach Wirkungen aus ist, an die man zuletzt an Licht denkt, so z.B. eine Beziehung zwischen Licht und Darmkrebs? Tatsächlich hatten die Menschen selbst bei Rachitis Probleme damit gehabt, zu glauben, dass das Licht auf der Haut etwas damit zu tun haben könnte, dass den Menschen die Knochen erweichen, die das Licht kaum erreichen kann.

Als die Tagungsreihe „Licht und Gesundheit“ im Jahr 1997 an der TU Berlin konzipiert wurde, sollte ich einen Vortrag zu meinen Arbeiten halten. Stattdessen lieferte ich einen Beitrag mit dem Titel „Licht als Stressor oder Stimulans - Psychophysiologische Wirkungen der Beleuchtung auf den arbeitenden Menschen“ (Download hier). Ich hatte mittlerweile ein Vierteljahrhundert über die Wirkungen des Lichts auf den Menschen geforscht, etwa 1.000 Menschen in Fußballstadien befragt, 4.500 Arbeitsplätze studiert. Aber ich konnte mich immer noch nicht entscheiden, ob Licht „gut“ ist (Stimulans) oder eher „schlecht“ (Stressor).

Was mir insbesondere fehlte, war ein Modell für “Licht und Gesundheit”. Eine Beschreibung der Auswirkungen von Licht auf die Gesundheit des arbeitenden Menschen setzt voraus, dass man eine modellhafte Vorstellung von den Wirkungsmechanismen entwickelt. Diese nennt sich im Arbeitsschutz Einwirkungsdefinition. Bevor man einen Umweltfaktor, der als „unangenehm“ erlebt wird, auch als einen Faktor der Beeinträchtigung der Gesundheit bezeichnen kann, ist die Festlegung der Einwirkungsdefinition erforderlich. Der betrachtete Faktor muss eine nachvollziehbare Einwirkung auf den Organismus ausüben, damit sich dieser überhaupt verändert. Aber nicht jede feststellbare Veränderung eines Organismus wird gleichsam als eine Beeinträchtigung der Gesundheit bezeichnet, da jede Information aus der Umwelt eine Veränderung hervorruft. So verändert z.B. ein Warnsignal die Hirnströme, ohne dass man dies als Beeinträchtigung der Gesundheit ansieht.

Richtig schwierig wird die Sache, wenn man nicht nach einer „Beeinträchtigung“ der Gesundheit sucht, sondern nach einer manifesten Erkrankung, als deren Verursacher man Licht nachweisen will. Die größte Schwierigkeit dürfte dabei sein, dass nur Mediziner relevante gesundheitliche Daten erheben dürfen. Sie sind auch die Einzigen, die Diagnosen stellen können und dürfen. Beiden Problemen kann man begegnen, indem ein Mediziner die Projektleitung übernimmt oder wenigstens sich maßgeblich beteiligt. Dann bleibt aber immer noch das Problem, dass Licht in der Medizin etwas anderes ist als in der Lichttechnik. Viele Heilmethoden in der Medizin nutzen Wirkungen von Strahlungen, die für die Lichttechnik kein Licht sind. Für den Lichttechniker gehört das alles zu „Photobiologie“.

Die Geschichte der Photobiologie reicht hinter unsere Zeitrechnung zurück. Schon in der Antike beobachteten Menschen den Einfluss des Lichts auf das Leben. Der Begriff "Photobiologie" existierte zwar noch nicht, aber die Konzepte waren da: Die Nutzung von Sonnenlicht zu Heilzwecken (Heliotherapie) war bei den Griechen und Römern bekannt. Die "moderne" Photobiologie ist etwa 120 bis 150 Jahre alt. In dieser Zeit wurden die Mechanismen dahinter entschlüsselt, z.B.: Downes und Blunt bewiesen 1877, dass ultraviolettes (UV) Licht Bakterien abtöten kann. Niels Finsen erhielt 1903 den Nobelpreis für die Behandlung von Hautkrankheiten mit konzentrierter Lichtstrahlung (Lichttherapie). Die Photobiologie ist als eigenständige, organisierte Fachdisziplin etwa 70 bis 80 Jahre alt. 1954 wurde das Comité International de Photobiologie (heute die International Union of Photobiology) gegründet.

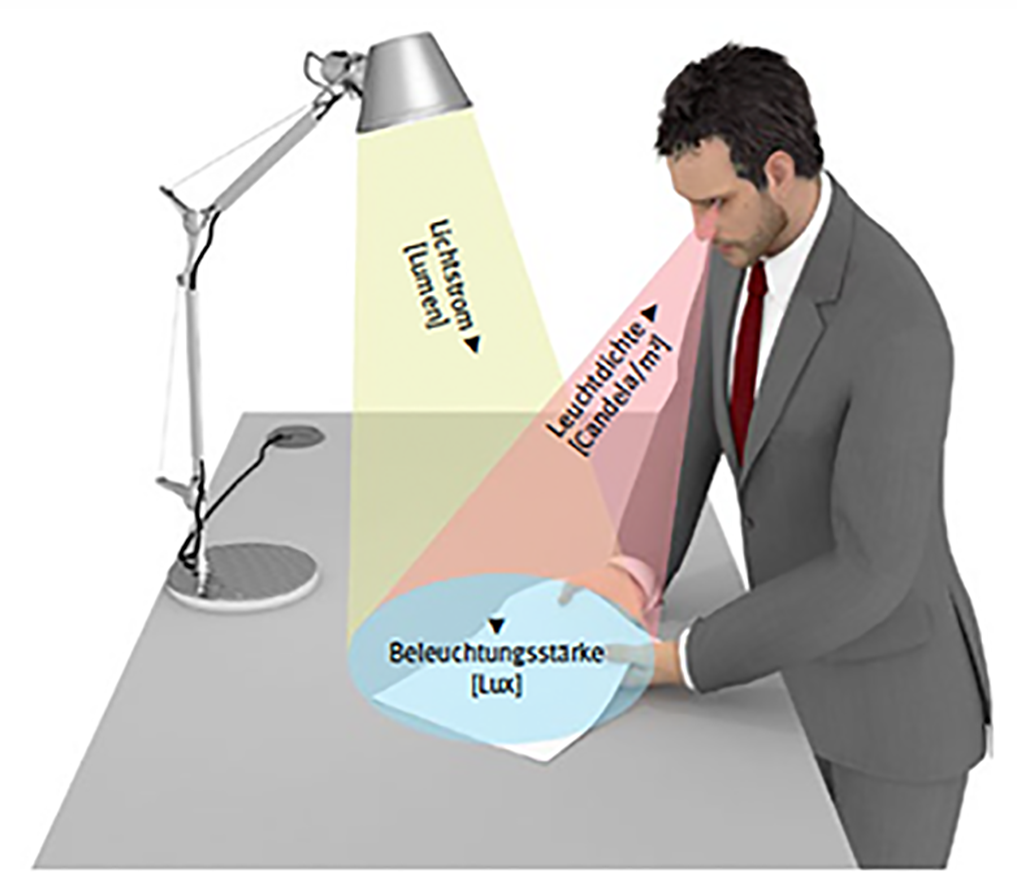

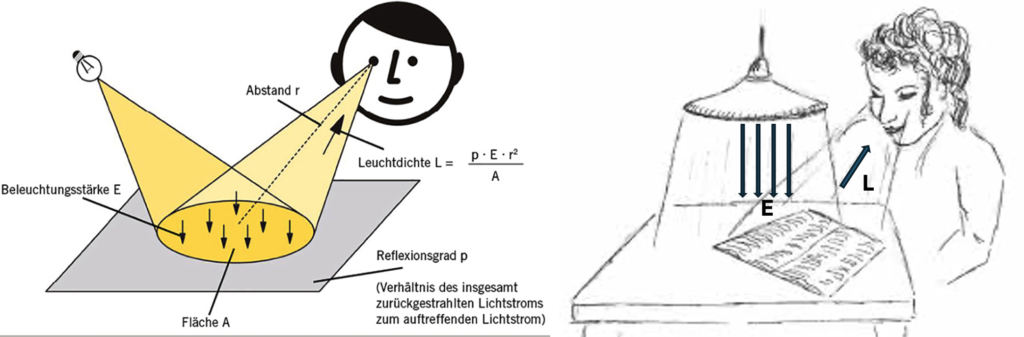

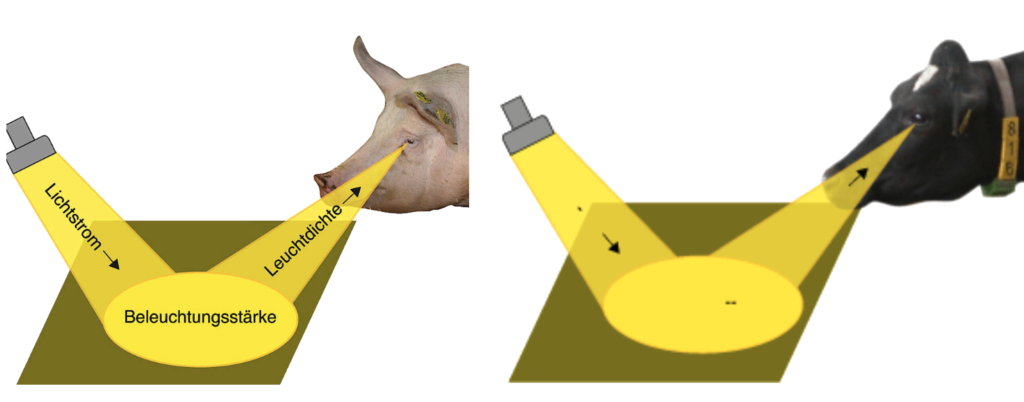

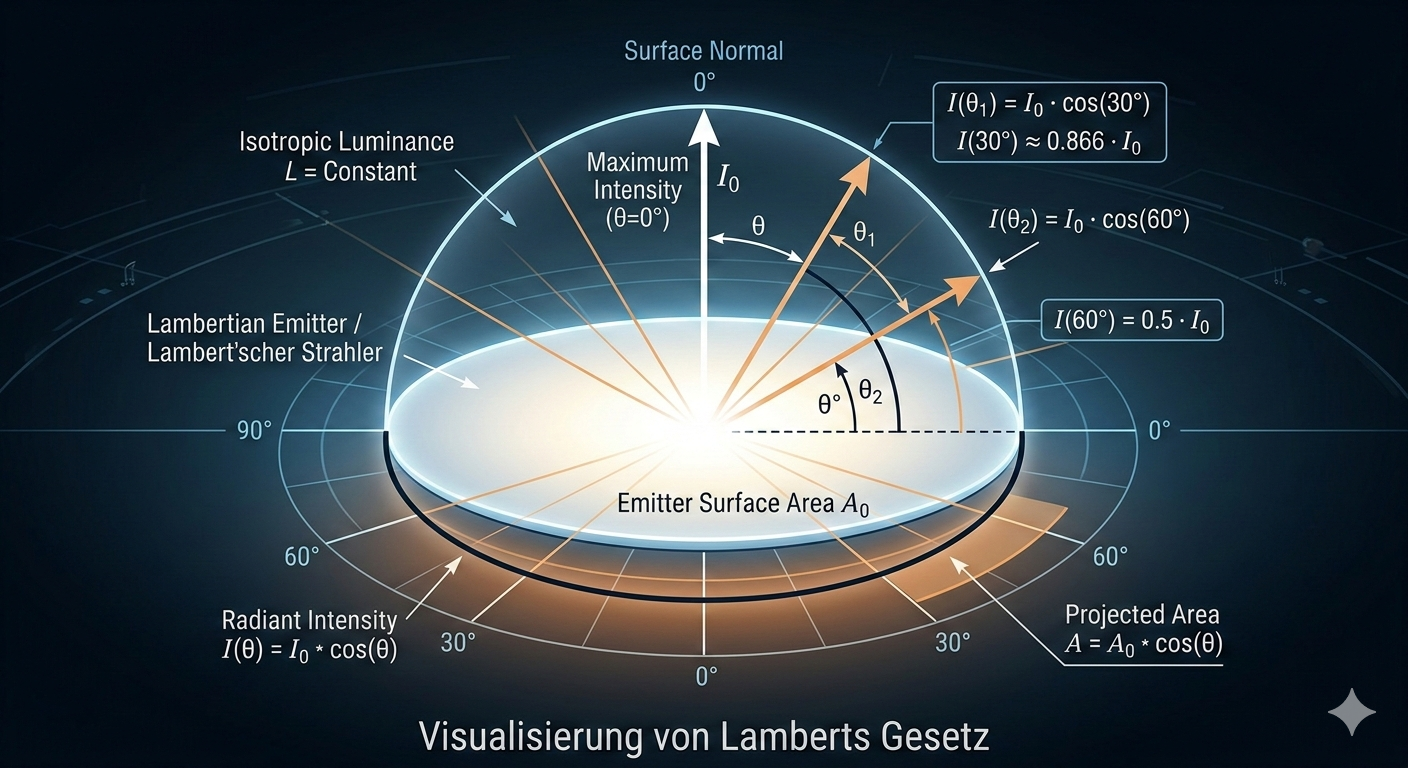

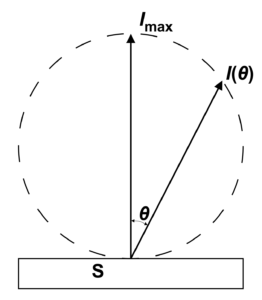

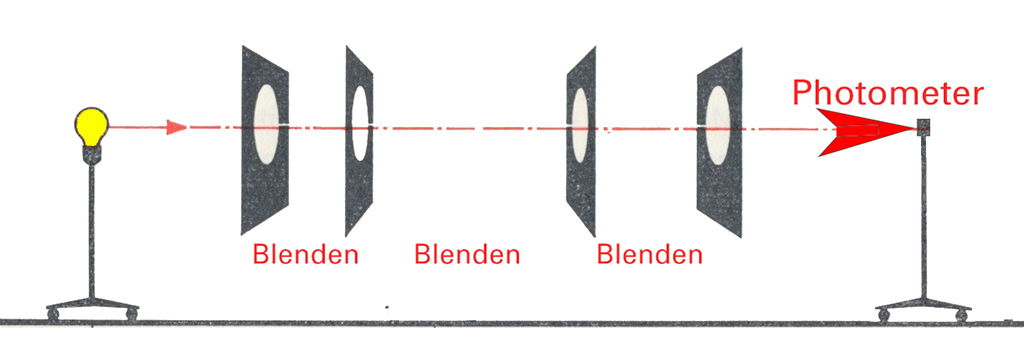

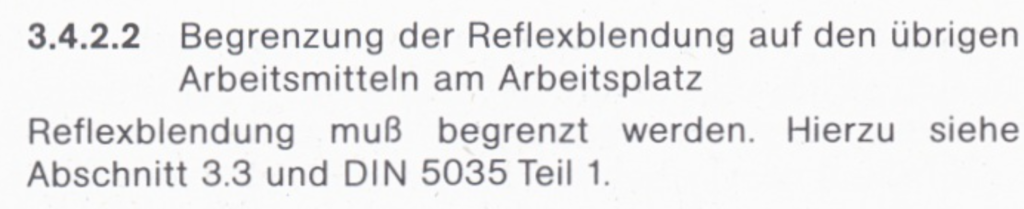

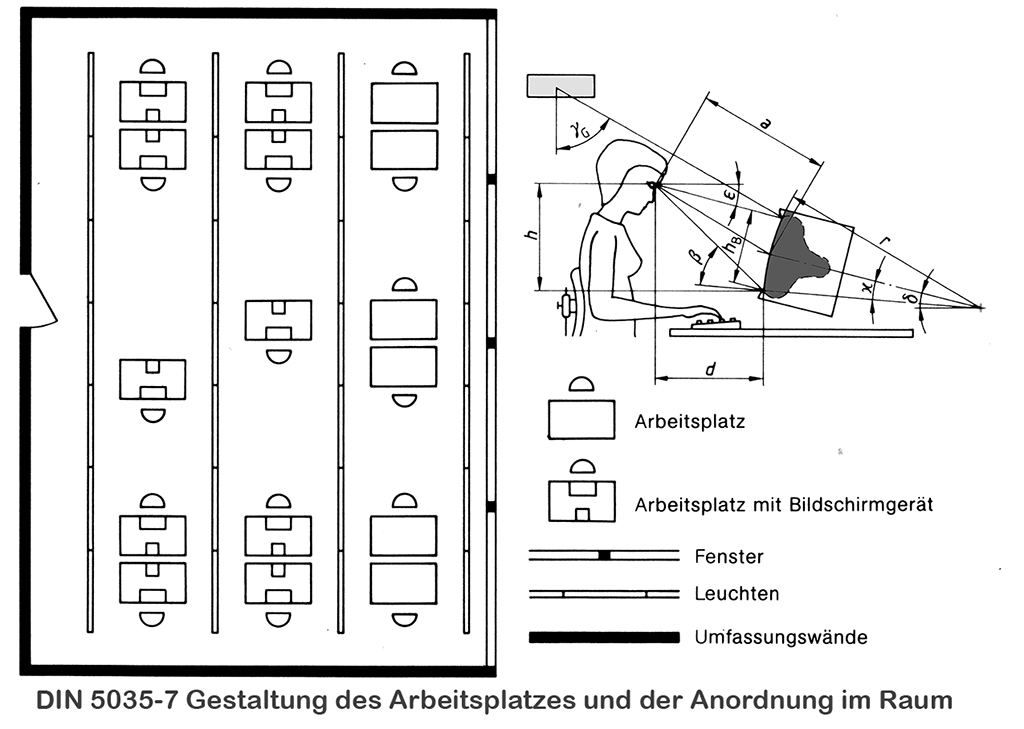

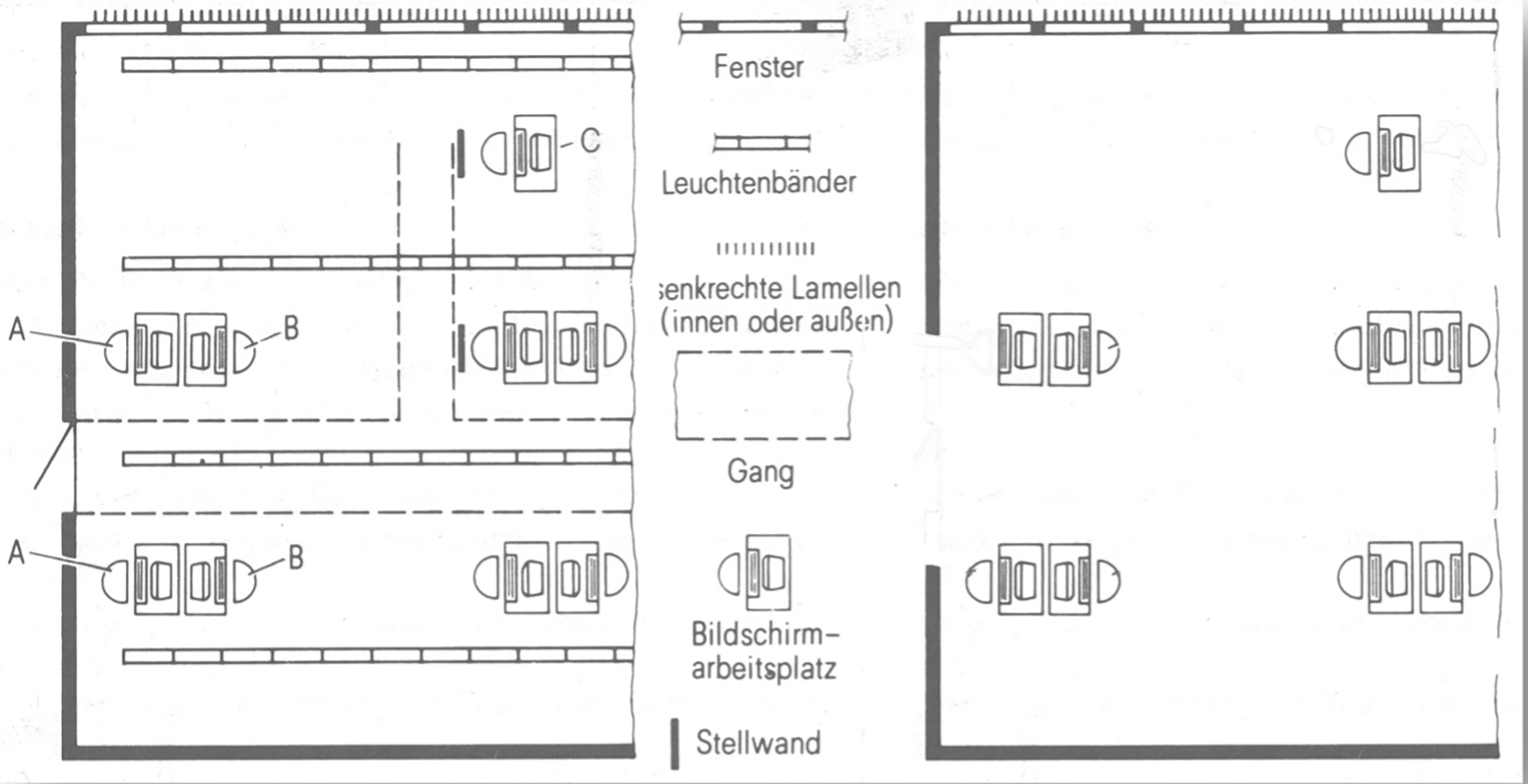

Will man mit einer Studie ursächliche Beziehungen zwischen Licht und ihren Wirkungen aufdecken, muss man neben direkten Wirkungen wie Blendung („primäre“ Wirkung“) auch „sekundäre“ Wirkungen wie die Ausschüttung von Hormonen wie Cortisol erfassen. Ist das Licht vermutlich erst über den Umweg von hormonellen Veränderungen (z.B. Beeinflussung der Arbeitsleistung infolge circadianer Rhythmusstörungen) beteiligt, spricht man von „tertiären“ Wirkungen.

Zusammenfassung der Wirkungen

Primäre Wirkungen (momentan eintretende Wirkungen)

Das sind durch Strahlungseinfluss unmittelbar entstehende Wirkungen, wozu insbesondere die Sehvorgänge zählen. Die darüber hinausgehenden primären Wirkungen (z.B. Hautpigmentierung) beschreibt die Photobiologie. Bei den primären Wirkungen kann man eindeutige Ursache-Wirkungs-Beziehungen finden und diese mit geeigneten technischen Einrichtungen messbar machen. Aus diesem Grunde lassen sich Techniken und Maßnahmen entwickeln, die primäre Wirkungen gezielt erzeugen, beispielsweise Ausleuchtung von Arbeitsobjekten zum besseren Erkennen oder Bestrahlung von Haut, um eine Bräunung zu erreichen.

Sekundäre Wirkungen (nach längerer Dauer eintretende Wirkungen)

Diese Wirkungen werden mittelbar verursacht, so z.B. die Aktivierung des Körpers infolge einer hellen Umgebung oder die Steigerung der Leistungsfähigkeit durch eine als angenehm empfundene Beleuchtung. Bei diesen Wirkungen lassen sich Ursache-Wirkungs-Beziehungen nicht einfach herstellen bzw. messen. Man weiß beispielsweise, dass eine Beleuchtung mit geringer Blendwirkung nicht nur durch ihre primäre Wirkung (bessere Sehleistung) die Belastung des Menschen mindert, sondern auch durch Minderung der subjektiven Ermüdung. Die letztere Wirkung entzieht sich aber in der Regel einer genauen Ermittlung. Zu den wichtigsten sekundären Wirkungen können Einflüsse auf die Hormonausschüttung gezählt werden, die vom Licht erzeugt werden.

Tertiäre Wirkungen (langfristig eintretende Wirkungen)

Diese Wirkungen werden durch Vorgänge beeinflusst bzw. ausgelöst, die mit den primären und sekundären Wirkungen der Strahlung zusammenhängen. Zu solchen Wirkungen gehören Einflüsse auf das Immunsystem oder Beeinflussung bestimmter Krebserkrankungen, deren Entstehung und Verlauf in einer noch nicht bekannten Weise mit Licht zusammenhängen. Eine Ermittlung von Ursache-Wirkungs-Beziehungen ist bei diesen Einflüssen naturgemäß noch schwieriger als bei den primären und sekundären Wirkungen.

Eines der langlebigsten Probleme der Lichtforschung besteht in dem Bemühen, eine Beziehung zwischen Lichtexpositionen und Krebsentstehung zu finden.

Licht als Stimulans oder Stressor – und was das mit Krebs zu tun hat

Die Untersuchung eines möglichen Zusammenhangs zwischen der „Beleuchtung“ und der Gefahr einer Krebsentstehung blickt auf eine lange Geschichte zurück. Eigentlich war der zuerst vermutete Verursacher gar keine Beleuchtung, sondern die Sonne selbst. Der deutsche Hautarzt Paul Gerson Unna untersuchte Seeleute in Hamburg und stellte fest, dass diejenigen, die jahrelang der Witterung und der Sonne ausgesetzt waren, eine spezifische Form der Hautalterung und schließlich bösartige Veränderungen entwickelten (1894). Unna eröffnete 1884 eine private Hautklinik in Hamburg-Eimsbüttel, die er Dermatologicum nannte und in der er sich ganz auf sein Spezialgebiet konzentrieren konnte. Sein in diesem Jahr veröffentlichtes Buch Histopathologie der Hautkrankheiten fasste das gesamte damalige Wissen zu Hautkrankheiten zusammen und machte ihn zu einem der führenden Dermatologen seiner Zeit.

Unna arbeitete eng mit dem Apotheker Paul Beiersdorf und seinem Nachfolger zusammen. Aus dieser Zusammenarbeit ist später Nivea entstanden, die erste Hautcreme der Welt. Deren Rezeptur ist bis heute nahezu unverändert geblieben.

Unna prägte den Begriff "Seemannshaut" (Cutis nautica). Er vermutete bereits damals, dass das Sonnenlicht nicht nur die Haut altern lässt, sondern direkt für die Tumorentstehung verantwortlich ist. Obwohl Unna die klinische Beobachtung machte, fehlte der experimentelle Beweis. Diesen lieferte der Brite George Milner Findlay. Findlay setzte Mäuse künstlicher UV-Strahlung aus und konnte so zum ersten Mal in einer kontrollierten Umgebung Hautkrebs induzieren. Damit war bewiesen, dass es kein Zufall war, sondern dass die physikalische Strahlung des Lichts biologische Schäden verursacht, die zu Krebs führen.

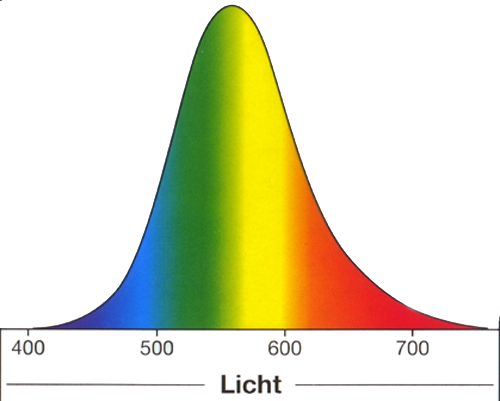

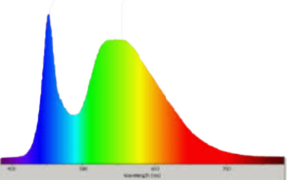

Noch war es nicht genau bekannt, was von der Strahlung der Verursacher war. Im Prinzip kann jede Energiezufuhr Zellen schädigen und Mutationen verursachen, darunter auch solche, die man Tumor nennt. Der argentinische Forschende Angel Roffo untersuchte in den 1930ern die Wirkung verschiedener Lichtspektren. Er konnte zeigen, dass nicht das sichtbare Licht, sondern der ultraviolette Bereich (UV) die krebserzeugende Wirkung hat. Er bewies zudem, dass Glas (das UV-B filtert) vor dieser Wirkung schützt, was die Gefahr weiter auf die unsichtbaren UV-Strahlen eingrenzte.

Wie im Kapitel Licht und Gesundheit – Untrennbar aber diskutierbar … beschrieben, war ein großer Teil der Menschheit auf dem anderen Trip. Man sah in UV die heilenden Strahlen der Sonne, die himmlische Medizin. Die einen versuchten, mit speziellen Gläsern (z.B. Vita-Glass) die UV-Strahlen in die Räume zu holen. Selbst Züge und Reisebusse sollten “UV-durchlässig” und damit gesund werden. General Electric hat gar Lampen entwickelt, die die Beleuchtung in den Räumen “gesund” machen sollten, indem sie UV erzeugen. Sie wurden in Räumen installiert, die man in dunklen Stadtvierteln bewohnte. Schulen und Kitas wurden für "gesundes" Licht, sprich viel UV, umgestaltet.

Im Grunde genommen waren die Zielkonflikte, die ich in den Beiträgen Wirkung von UV auf Mortalität und Zu Tode geschützt? Warum UV-Exposition neu bewertet werden muss behandele, programmiert. Dass sie bis heute in einer Form weiterbestehen, ist kein Wunder. Denn Schaden oder Nutzen ist im Allgemeinen eine Sache der Dosis, man kann mit Giften heilen und mit Heilmitteln vergiften. Wie die Dosis bei UV zusammenkommt, ist nicht einmal allen Dermatologen bekannt. Sie argumentieren mit der Gefahr des Hautkrebses. Die gefährlichere Form davon, der schwarze Hautkrebs, wird hauptsächlich durch erlittene Sonnenbrände in der Kindheit verursacht. Mir ist nicht gelungen, eine statistische Unterscheidung zwischen dieser Ursache und den restlichen Ursachen dieser Krebsart aufzufinden. Es besteht eine seltene Einigkeit in dieser Frage, man redet von 5 Sonnenbränden oder einem Sonnenbrand und gibt die Erhöhung der Wahrscheinlichkeit einer Erkrankung an (1 schwerer Sonnenbrand (Kindheit) ca. 2-faches Risiko, 5+ Sonnenbrände (Kindheit/Jugend) ca. 3,5 bis 5-faches Risiko). Sonnenbrände werden primär von der UV-B-Strahlung ausgelöst.

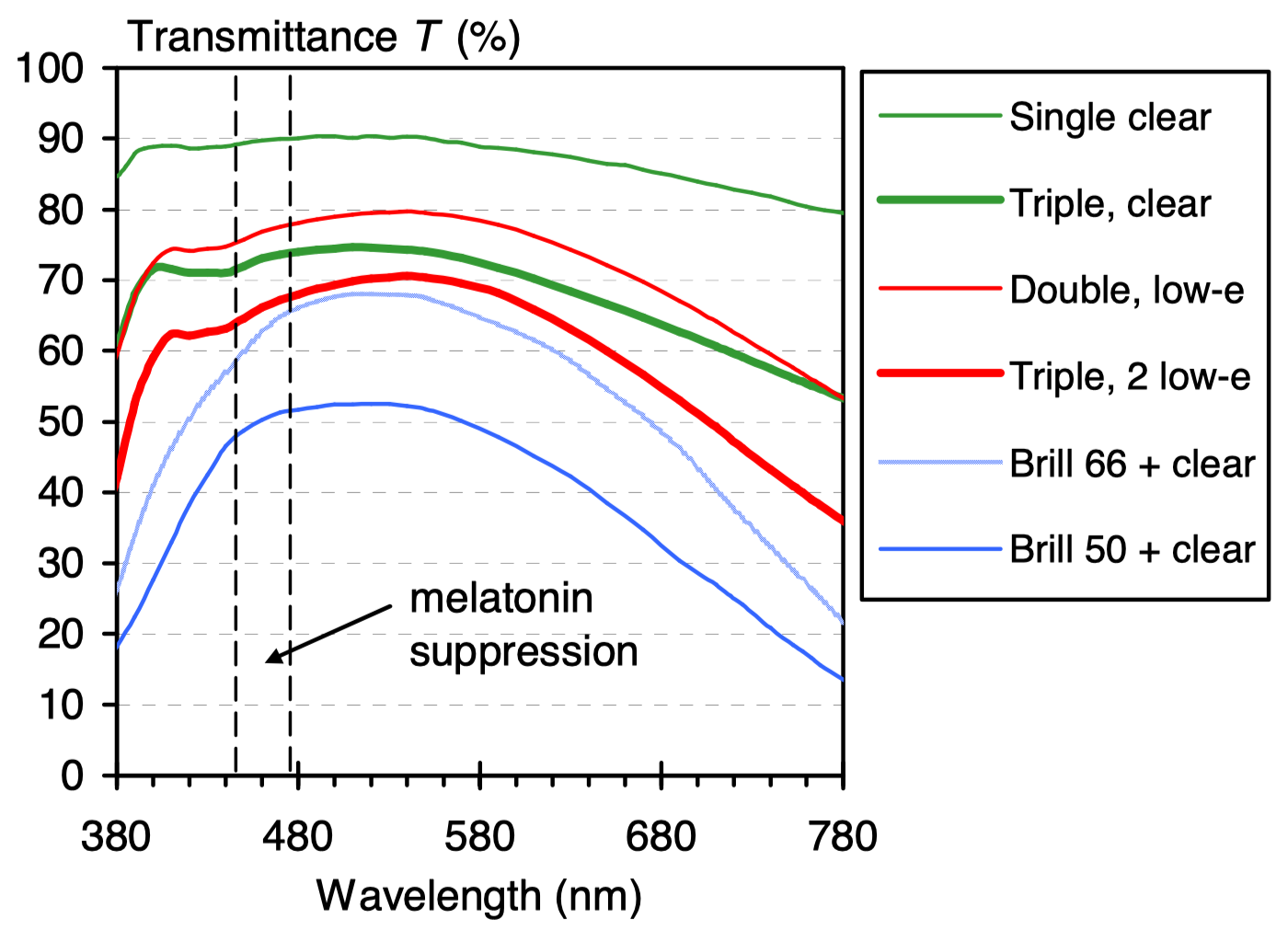

Die weniger gefährliche Art, der weiße Hautkrebs, scheint hingegen durch eine lebenslange Kumulation von UV-A-Strahlungsexpositionen verursacht zu werden. Eine entsprechende Dosis kann man an ganz unverdächtiger Stelle bekommen, so z.B. durch Autofahren. Klimatisierte und gut gegen Lärm abgedichtete Autos geben einem das Gefühl, gegen alles Mögliche geschützt zu sein. Gegen UV-A schützt kein Glas und keine Klimaanlage.

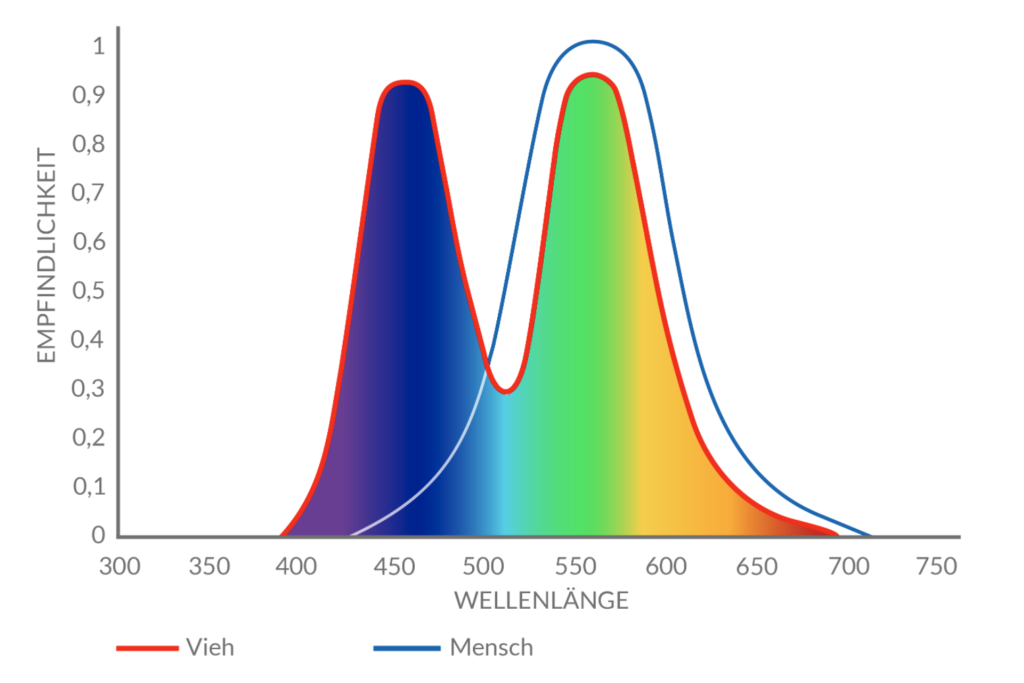

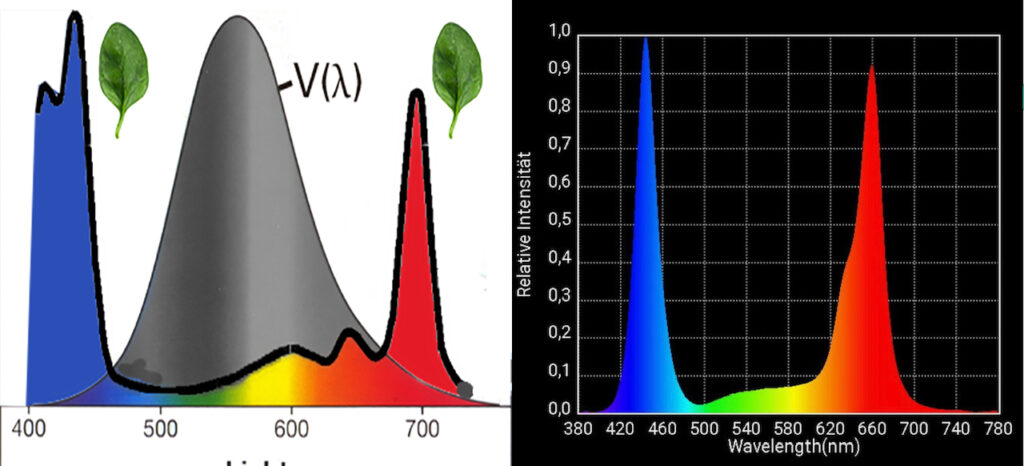

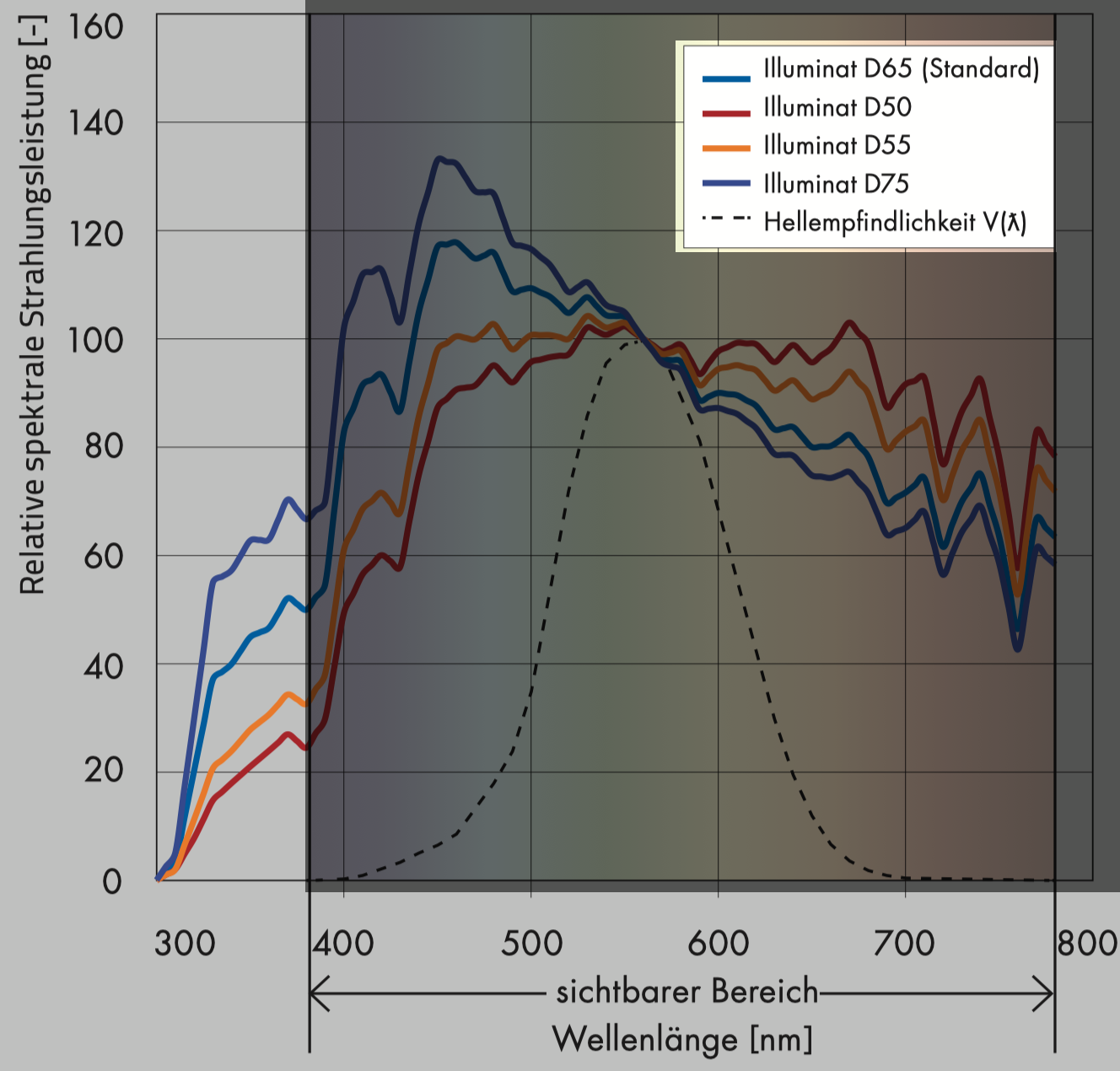

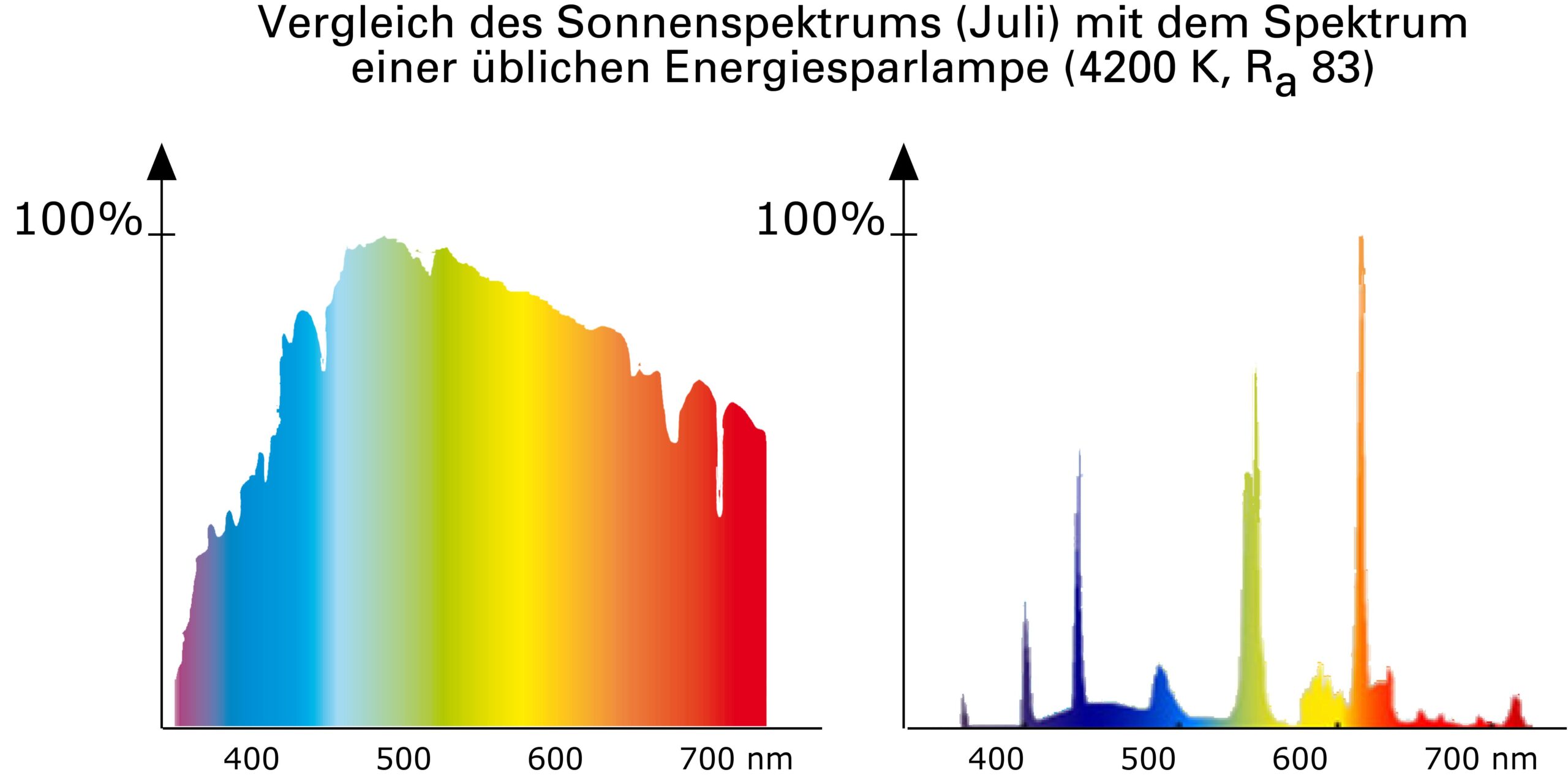

Es waren also zwei recht unterschiedliche Einwirkungsmechanismen für die Krebsentstehung durch Licht im Gespräch: kumulative Wirkung von Einzelereignissen (Sonnenbrände, UV-B) und kumulative Wirkung einer Strahlexposition über lange Zeiten (Haut vergisst nicht!, UV-A). Mit Fritz Hollwich, einem renommierten deutschen Professor für Augenheilkunde, kam ein anderer Wirkungsmechanismus ins Gespräch. Hollwich argumentierte nicht, dass Leuchtstofflampen direkt wie UV-Strahlung Mutationen in der Haut auslösen. Seine Theorie war komplexer und basierte auf der Endokrinologie (Hormonlehre): Er behauptete, dass das Spektrum von herkömmlichen Leuchtstofflampen, das oft starke Peaks in bestimmten Farben hat und andere Wellenlängen ausspart, den menschlichen Hormonhaushalt massiv störe. Er zeigte auf, dass die Bestrahlung mit künstlichem Licht zu einem unnatürlichen Anstieg von Stresshormonen wie Cortisol und ACTH führe.

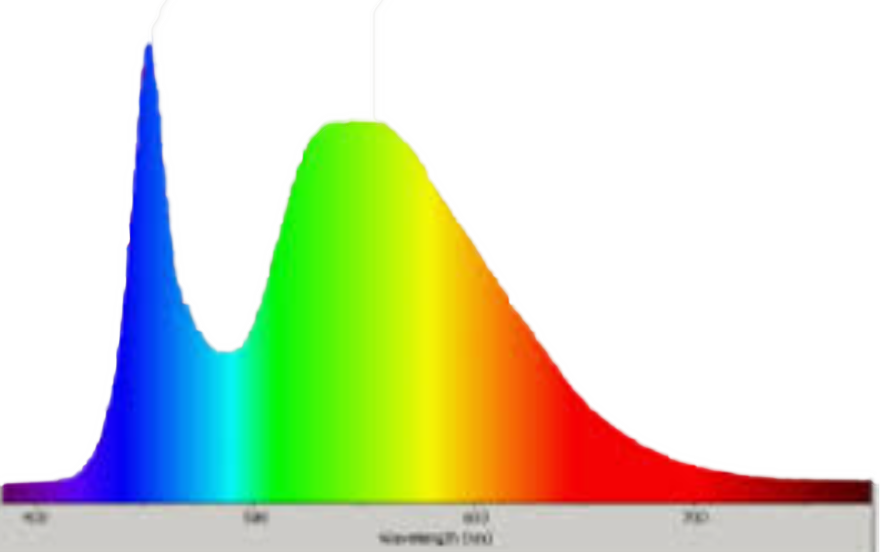

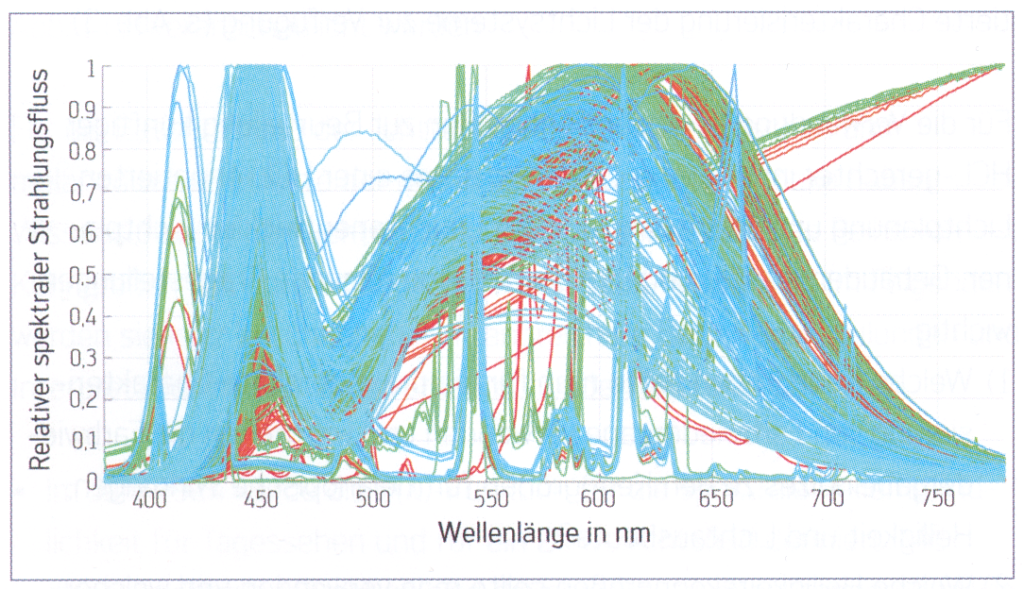

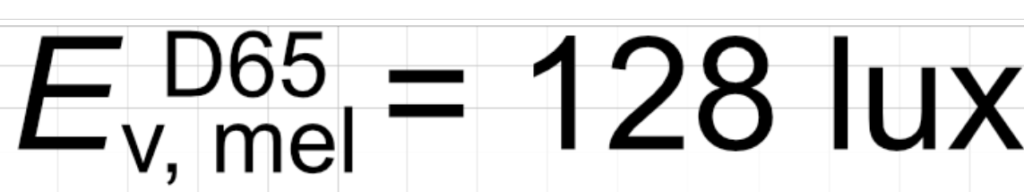

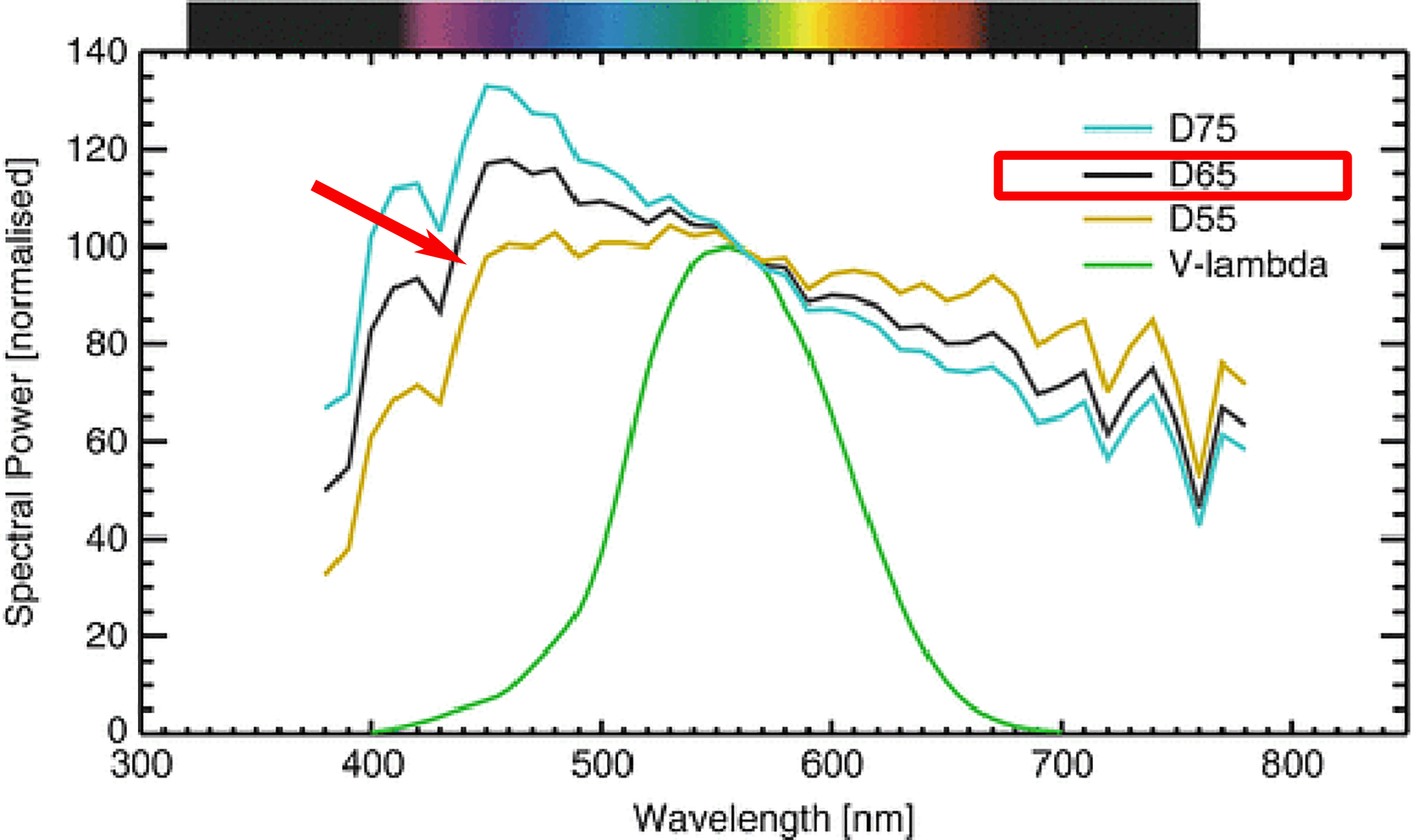

Hollwichs Studien wurden von der Lichttechnik heftig zurückgewiesen. So hat die Erwiderung seiner Thesen durch Münchner Professoren eine gewisse Tradition (Schober, H., 1950, Schober, H. 1954, Schober, H. 1971, Hartmann, E.; Müller-Limmroth, W. 1981)[1]. Insbesondere fehlte eine glaubhafte Einwirkungsdefinition. Allerdings lag Hollwich mit der Endokrinologie nicht weit von der wahren Wirkungsweise entfernt. Die moderne Forschung (seit den 2000ern) konzentriert sich eher auf den Zeitpunkt der Lichtexposition (Störung des Biorhythmus/Melatonin durch Licht in der Nacht), was tatsächlich als „wahrscheinlich krebserregend“ (Gruppe 2A der IARC) eingestuft wird – allerdings geht es hier um Schichtarbeit, nicht um das Spektrum der Lampe an sich. Aber auch die Wirksamkeit des Spektrums wurde nicht zuletzt durch den Standard der CIE S 026:2018 “CIE System for Metrology of Optical Radiation for ipRGC-Influenced Responses to Light” anerkannt: Die Berechnung der melanopischen Wirksamkeit des Lichts hängt eindeutig vom Spektrum ab. Vielmehr beruht sie auf dem Spektrum.

Die in dem letzten Teil behandelte Wirkungsweise weicht von der üblichen Vorstellung über die Einwirkung physikalischer Faktoren erheblich ab. Licht ist nicht primär verantwortlich für die fragliche Wirkung, sondern nur über seinen Einfluss auf Körperhormone. Man könnte sie sekundär oder tertiär nennen. Oder der Wirkungspfad sitzt noch tiefer, weil an dem Vorgang Melatonin beteiligt ist, dessen Alter in der gleichen Größenordnung liegt wie das Alter der Erde.(s. Beitrag Portrait: Melatonin – Archaisch und lebenswichtig)

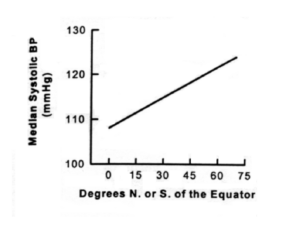

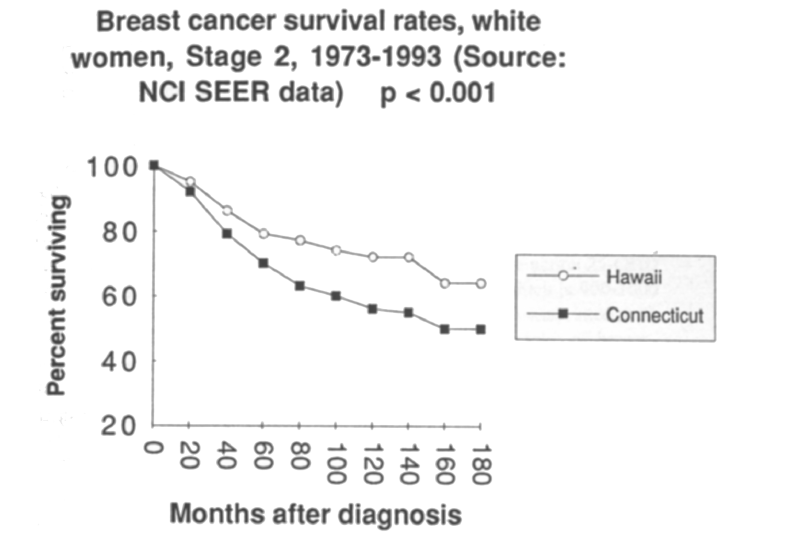

Einen weitaus umfangreicheren Ansatz verfolgen US-amerikanische Epidemiologen bei der Erforschung der möglichen Ursachen von Brustkrebs. Sie haben festgestellt, dass bestimmte biologische Funktionen in Abhängigkeit von der Entfernung des Aufenthaltsortes vom Äquator anders verlaufen. So z.B. der Blutdruck.

Diese Feststellung widerspricht der allgemeinen Vorstellung, dass die Lebensbedingungen am Äquator am problematischsten sind und in den gemäßigten Breiten geünder sind. Auch die Kurve der Überlebenschancen von Frauen nach einer Brustoperation verläuft ähnlich.

Michael Holick, von dem diese Bilder stammen, führt die Wirkung auf Lichteinflüsse zurück. Allerdings fehlt auch hier eine Einwirkungsdefinition außer einer Erklärung mit den Vitamin-D-Werten (s. Beitrag Wirkung von UV auf Mortalität) Damit wäre der Wirkungspfad noch verschlungener als der über die Beeinflussung der Hormone: Menschen bleiben länger als früher in Innenräumen ➪ Es fehlt an UV-Strahlung ➪ Mangel an UV-Strahlung verursacht diverse Wirkungen ➪ Künstliches Licht erhöht Brustkrebsrisiko.

Fazit

Lichtwirkungen auf den Menschen zu untersuchen, scheint auf den ersten Blick nicht allzu kompliziert zu sein. In Wirklichkeit sind mehrere Disziplinen wie Medizin. Chronobiologie, Photobiologie et al. sind seit Jahrzehnten oder noch länger damit befasst, solche Wirkungen überhaupt zu verstehen. Fiat lux – Es werde Licht oder Lux vita est - Licht ist Leben, sind uralte Sprüche, deren tieferer Sinn ist, dass das Leben so tief mit dem Licht verwoben ist, dass jede Erforschung eine Herausforderung bedeutet.

[1] Schober, H.: Die angeblichen Sehstörungen bei Beleuchtung durch Entladungslampen, Lichttechnik 2, 1950, S. 103; Schober, H.: Die angeblichen Sehstörungen bei Beleuchtung durch Entladungslampen, Lichttechnik 6, 1954, Schober, H.: Gutachtliche Denkschrift zur Verträglichkeit des Leuchtstofflampenlichts, LiTG Karlsruhe, 2. Auflage, 1971 S. 215-218; Hartmann, E.; Müller-Limmroth, W.: Stellungnahme zur Frage der Verträglichkeit des Leuchtstofflampenlichtes, LiTG, Karlsruhe, 1981