Dieses Phantom kennen nur Fachleute unter seinem Namen, den dessen Erfinder ihm gegeben hat, Johann Heinrich Lambert, seines Zeichens schweizerisch-elsässischer Mathematiker, Logiker, Physiker, Astronom und Philosoph der Aufklärung, der u. a. die Irrationalität der Zahl Pi bewies. Die Folgen des großzügigen Umgangs mit dem Phantom kann man in allen Lebenslagen erfahren.

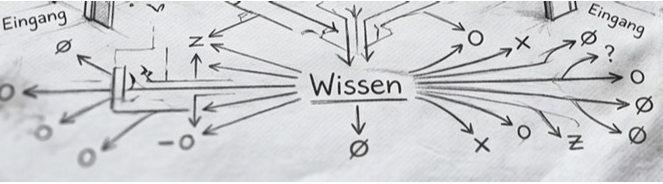

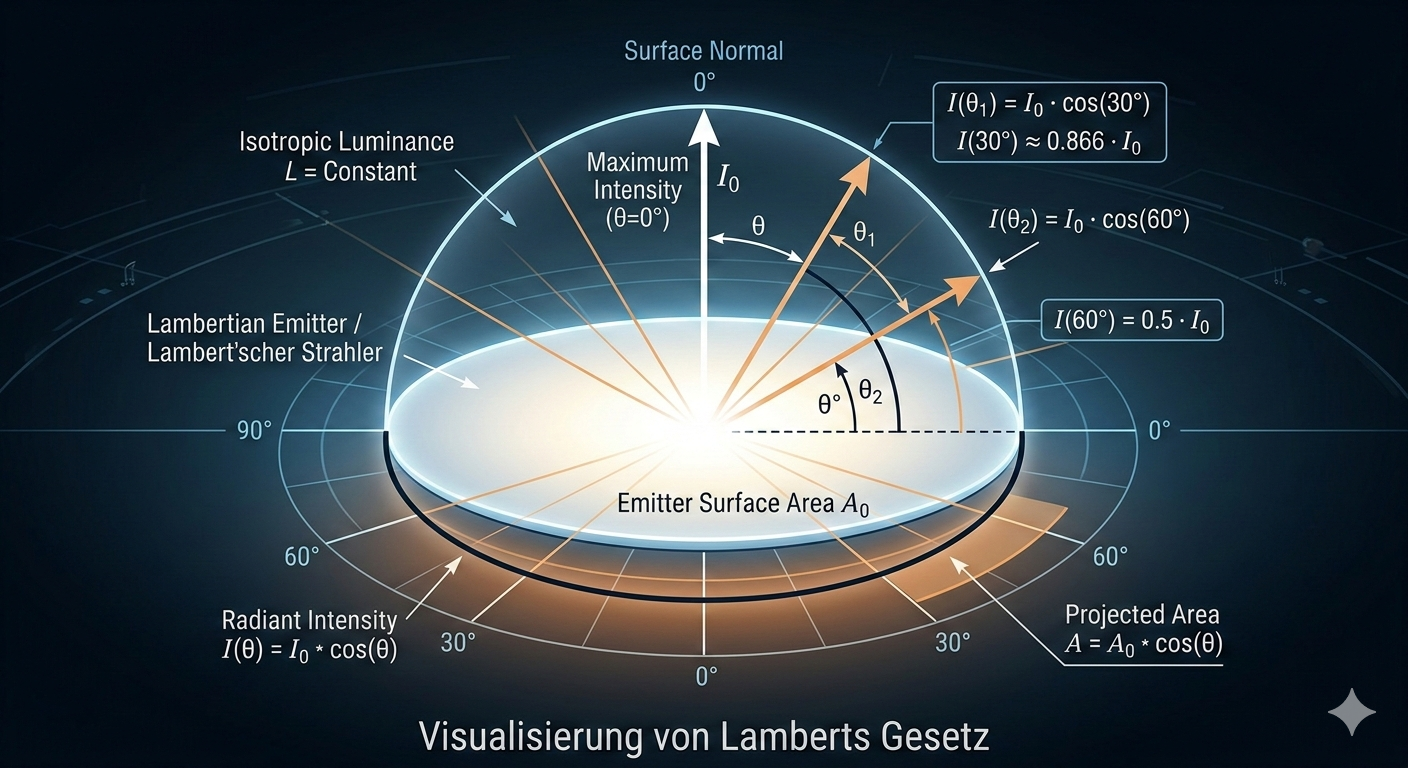

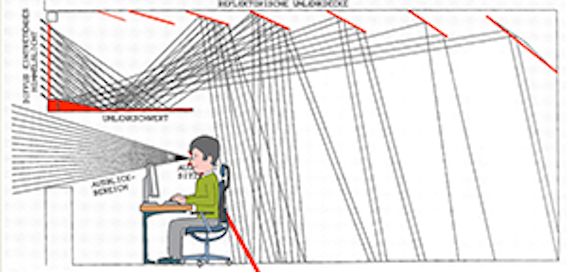

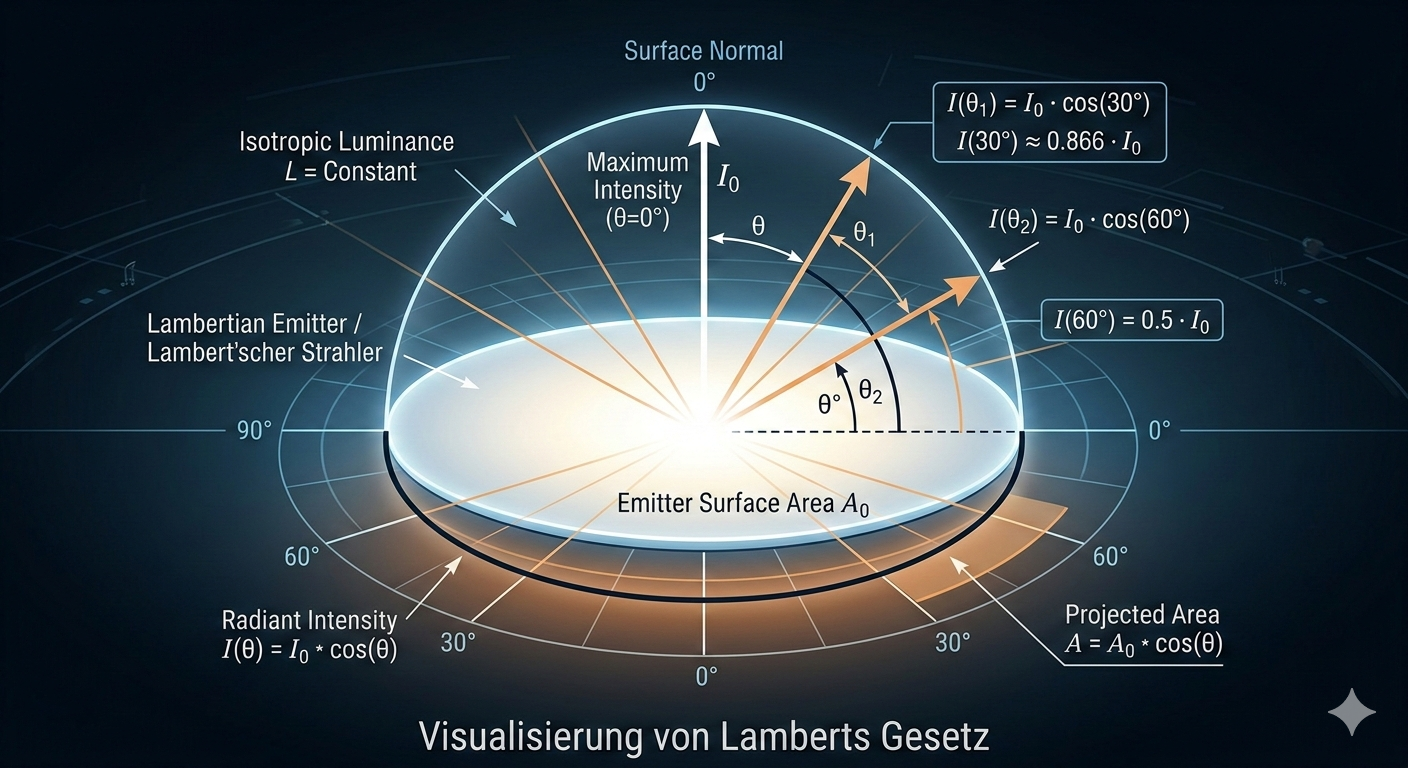

Wenn man eine genaue Erklärung für Lamberts Kosinus-Gesetz aus dem 18. Jahrhundert braucht, kommt meistens etwas zusammen, dass auch manche Fachleute rätseln müssen, was das denn sein soll. Hier ist ein gutes Beispiel für (k)eine gute Visualisierung:

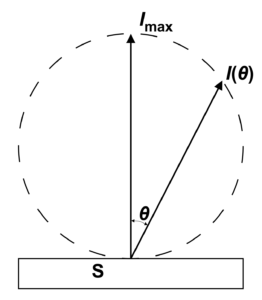

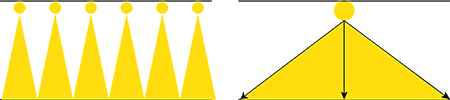

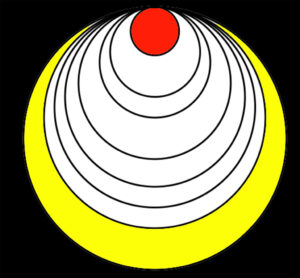

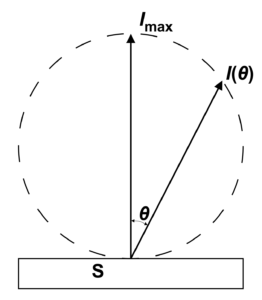

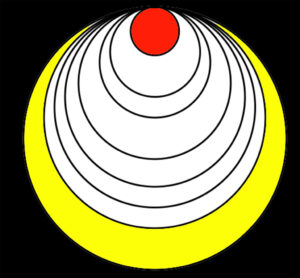

Anschaulicher stellt das Lambertsche Gesetz Wikipedia dar du sagt dazu: „…Wenn eine Fläche dem Lambertschen Gesetz folgt und die Strahldichte der Fläche konstant ist, so ergibt sich eine kreisförmige Verteilung der Strahlstärke.“

Legende: Winkelabhängigkeit der Strahlstärke bei einem Lambert-Strahler.

I: Strahlstärke; S: Quelle oder Reflexionsfläche

Allerdings kann auch diese Abbildung nicht allzu viel helfen, das Thema zu verstehen, weil sie zwar simpel ausschaut, aber trotzdem sehr technisch ist. Für den in diesem Beitrag verfolgten Zweck ist eine verbale Beschreibung viel erhellender: Ein Objekt, das dem Lambertschen Gesetz genügt, sieht aus allen Richtungen gesehen gleich hell aus, egal ob es selbst strahlt oder fremdes Licht reflektiert. Bei der Reflexion ist es vollkommen gleichgültig, ob das Licht aus einem einzigen Punkt kommt (z.B. von der Sonne, von einer Lampe) oder aus einer gleichmäßig leuchtenden Halbkugel um das Objekt herum. Dieses Verhalten zeigt das Bild unten. Das aus einer einzigen Richtung einfallende Licht wird so gestreut, dass man aus jeder Richtung die gleiche Helligkeit sieht.

Es geht genau um die mit den kleinen blauen Pfeilen angedeutete Verteilung des reflektierten Lichts. Es gibt nämlich überhaupt kein Material, dessen Oberfläche so reflektieren kann. Das Problem entsteht dadurch, dass man in der Beleuchtungstechnik so tut, als ob dies (fast) immer gelten würde. Das macht ein perfektes mathematisches Modell zum Phantom. Viele Irrungen und Wirrungen in der Beleuchtungstechnik lassen sich auf Missverständnisse zurückführen.

Wo es überall kneift und schwitzt

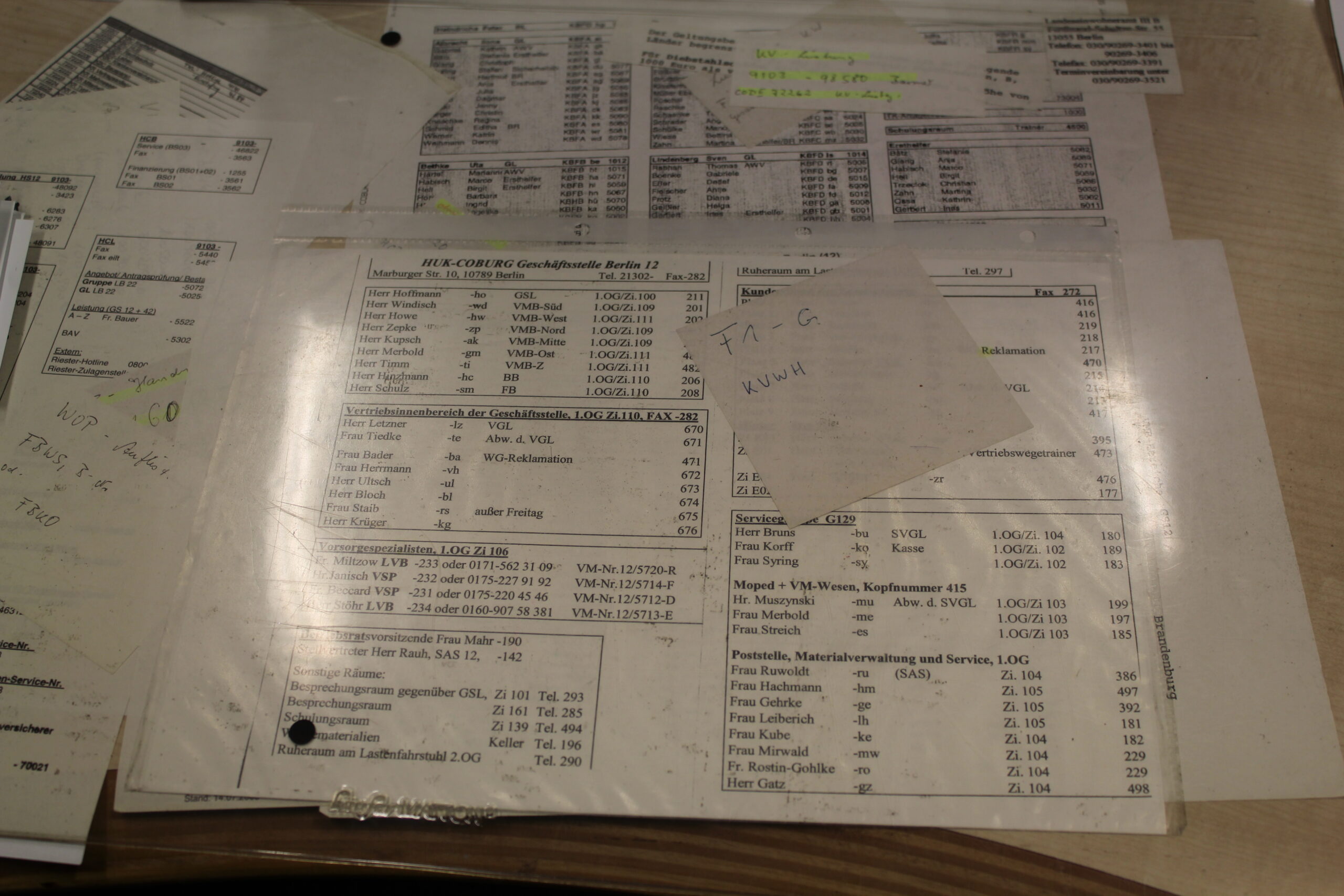

Was es in etwa bedeutet, kann man an diesem Bild erkennen, das einen Tisch zeigt, dessen Oberfläche nicht ganz dem Gesetz entspricht, was man an den Schatten erkennen kann. Auf dem Bild sind mehrere Objekte abgebildet, deren Reflexionsvermögen sehr unterschiedlich ist.

Auf dem Tisch befindet sich ein Computer, dessen Bildschirm stark von dem Lambertschen Gesetz abweicht. Davor sieht man ein bedrucktes Blatt Büropapier, das dem Lambertschen Ideal recht nahekommt. Während der Monitor neben der beabsichtigten Information alles Mögliche noch zeigt, z.B. den Kopf des Benutzers und die Nachbargebäude, scheint das Papier frei von Reflexionen aller Art.

Das Bild, vollkommen unbearbeitet, zeigt trotzdem nicht die „Wahrheit“, also ein physikalische Gegebenheit. Der abgebildete Monitor ist für dessen Benutzer hervorragend entspiegelt, sieht aber wie ein perfekter Spiegel aus. Der Benutzer sieht aber nichts von allem, was das die Monitoroberfläche gespiegelt abbildet. Das matte Papier ist matt nur für weitgehend gestreutes Licht. Die darauf gedruckte Schrift glänzt noch etwas, je nachdem, wie der Drucker sie fixiert hat.

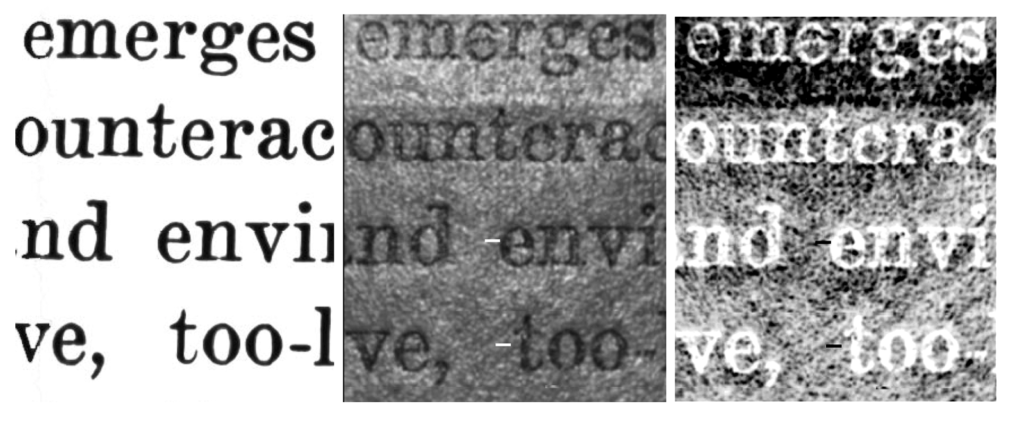

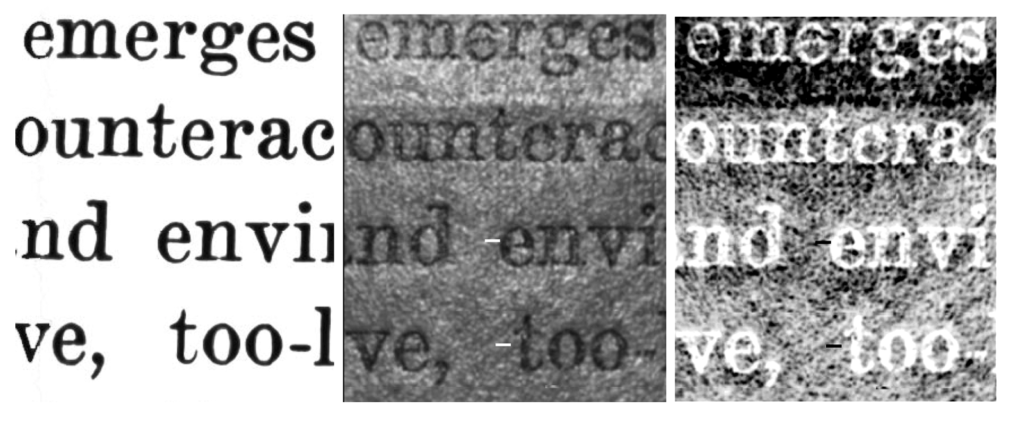

Im übelsten Fall, streifendes Licht, kann ein passables Bild (s. unten, links) zu einem katastrophalen werden (unten, Mitte). Der Kontrast kann sich sogar umkehren (unten, rechts)

Mit einfachen Worten, die Abweichung der realen Reflexionsbedingungen kann bis zu einer fast vollständigen Verfälschung eines gegebenen Bildes führen. Daher macht es Sinn, anzusehen, wo überall in unserer Denke und Praxis das Phantom zuschlägt.

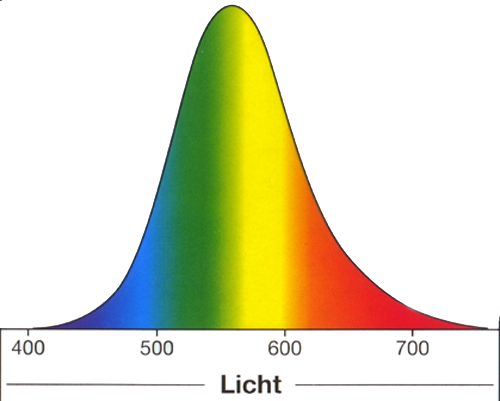

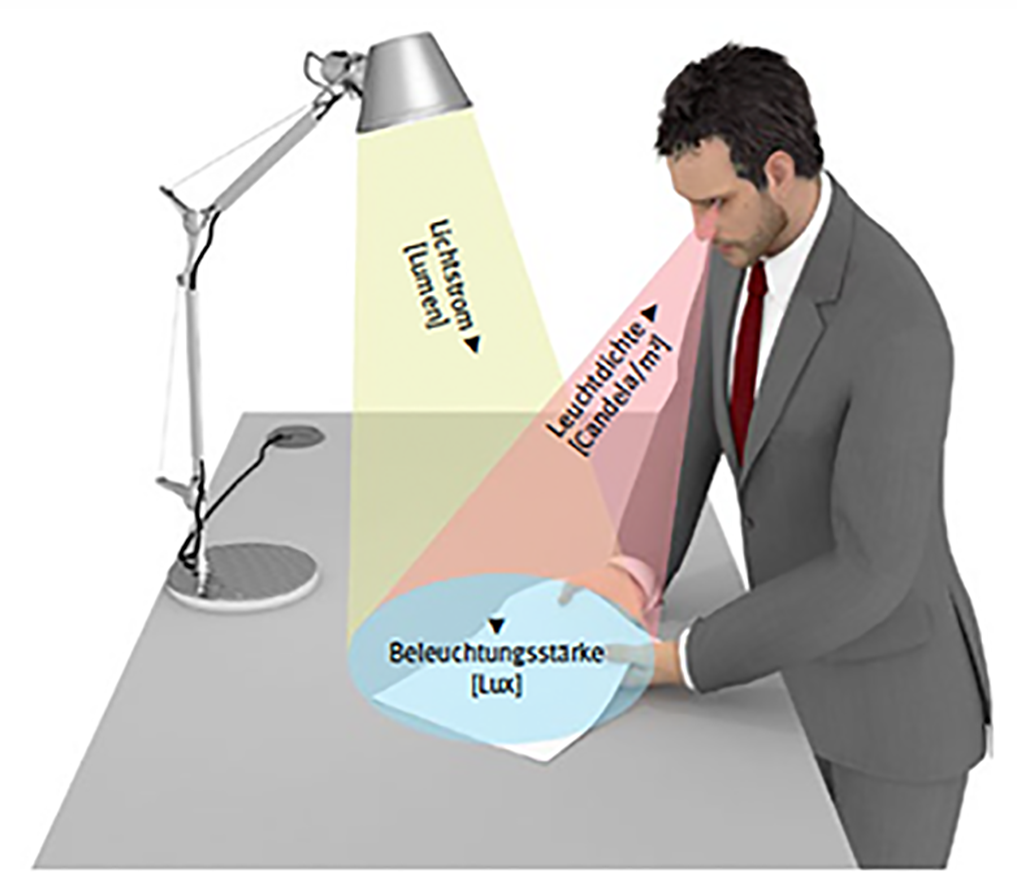

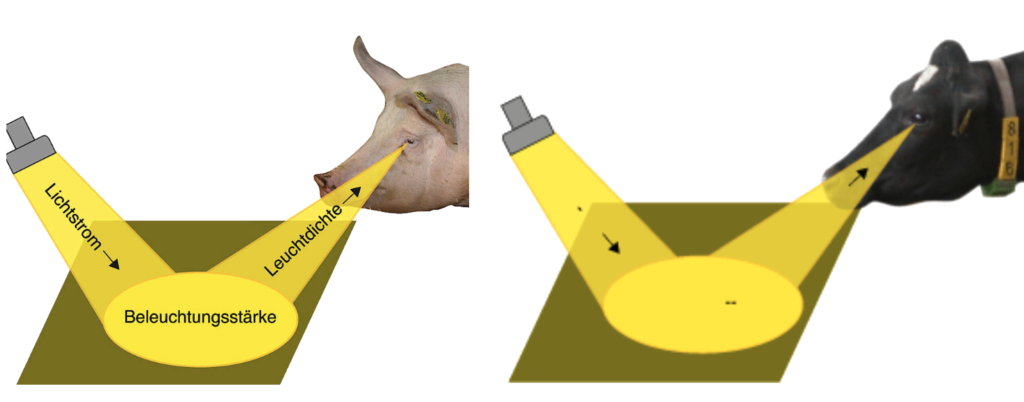

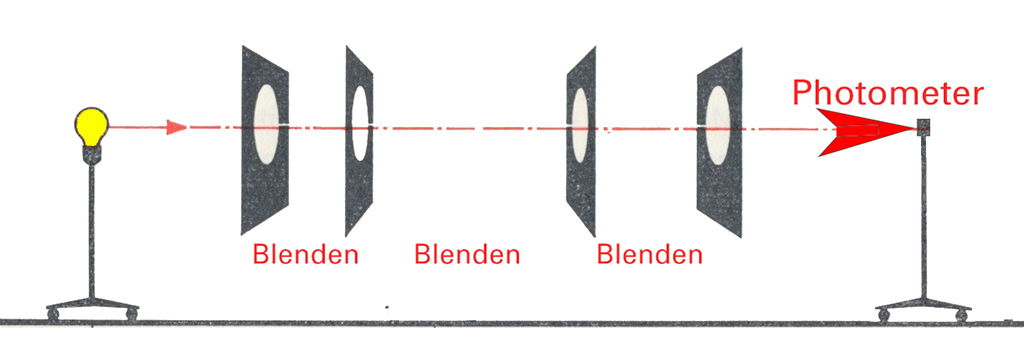

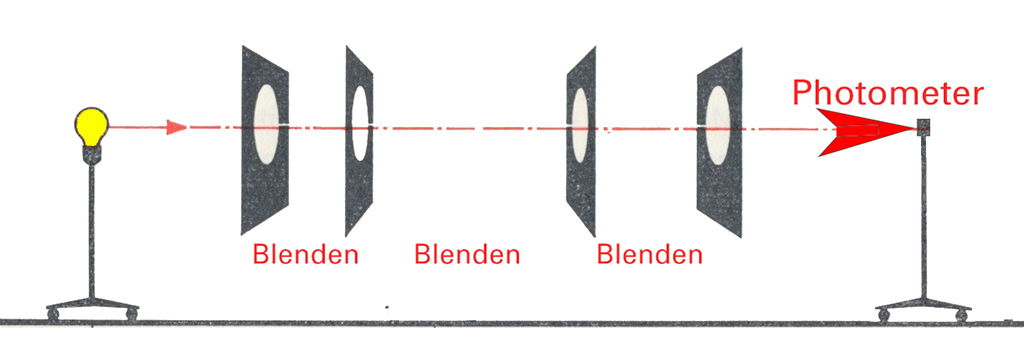

Die Größe Beleuchtungsstärke macht Sinn, wenn …

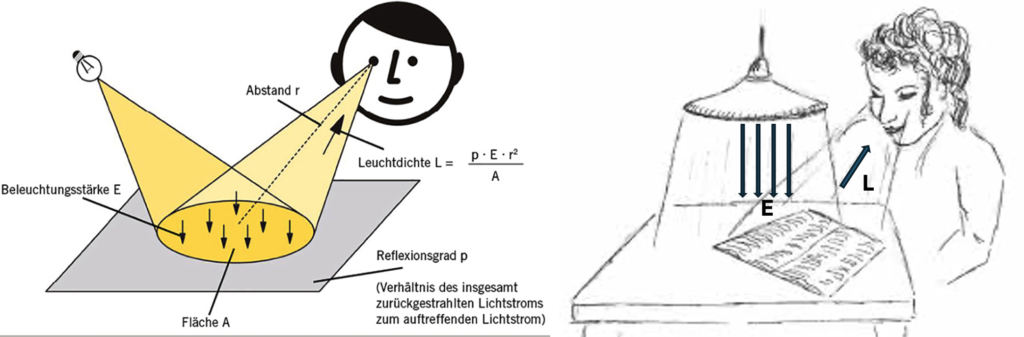

Der Begriff Beleuchtungsstärke stammt aus dem Labor und gilt genau genommen nur in der Art, wie sie dort benutzt wird. Beleuchtungsstärke ist der an einem Punkt ankommende Lichtstrom (rechts im Bild). Wenn dort ein Photometer hängt, liest man den Wert ab. Wenn dort ein Objekt hängt, das so reflektiert wie nach dem Lambertschen Gesetz, entsteht eine Leuchtdichte

L = ρ • E

Wobei L für Leuchtdichte steht und ρ für den Reflexionsgrad.

Dieselbe Formel verwendet man aber auch, um die Leuchtdichte des Papiers anzugeben, das z.B. unter sehr verschiedenen Beleuchtungen liegt, die unten skizziert sind.

Wenn man die Beleuchtungsstärke an einem Punkt links oder rechts im Bild misst und dort einen Wert X liest, rechnet man mal die Leuchtdichte eines dort befindlichen Objekts nach diesem Wert. Das ist aber nur dann zulässig, wenn das Objekt richtungsunabhängig reflektiert. Ansonsten kann der abgelesene Wert alles Mögliche bedeuten, nur nicht die errechnete Leuchtdichte.

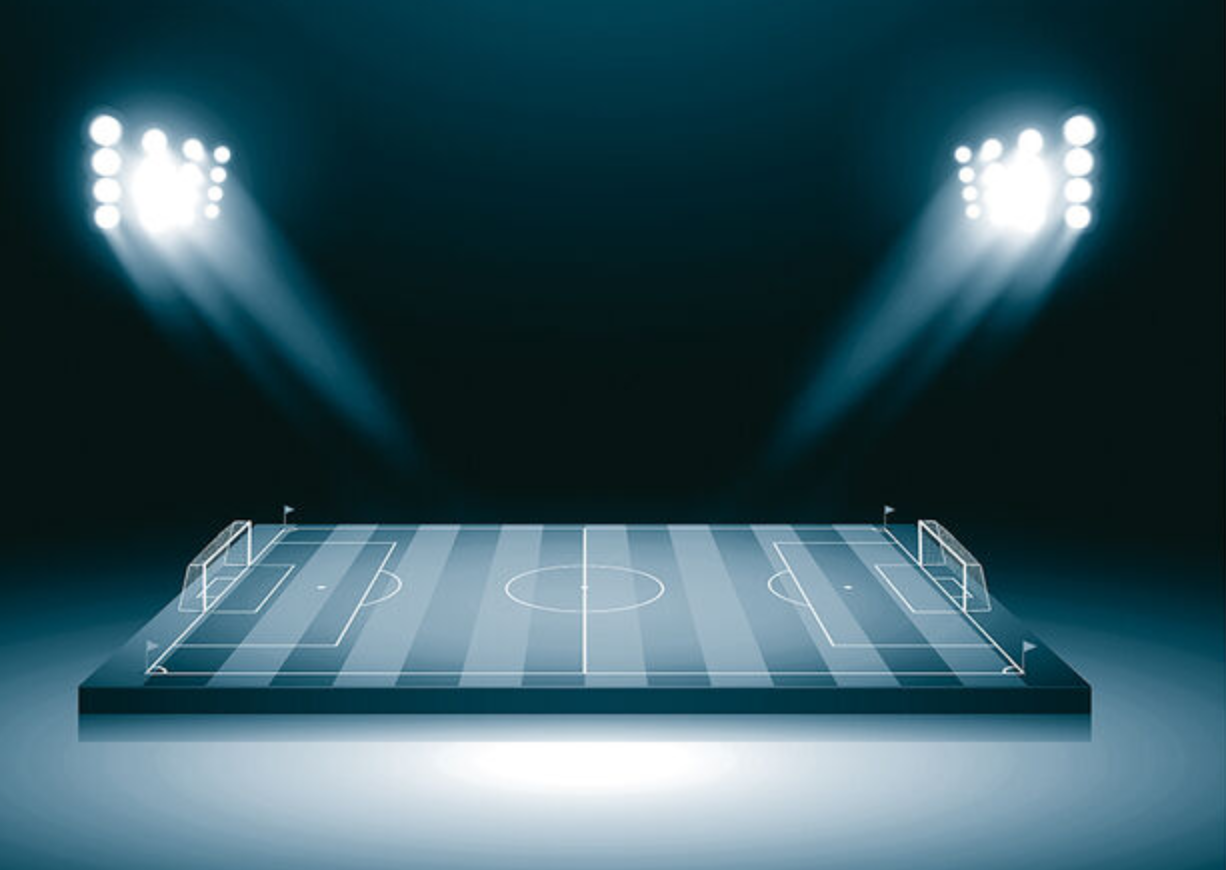

Man liegt mit der Bewertung einer Beleuchtungsstärke umso weiter daneben, je weiter sich die Beleuchtung von einer idealen Halbkugel mit gleicher Abstrahlung unterscheidet. Der eklatanteste praktische Fall liegt bei älteren Sportstätten vor, die mit vier Masten beleuchtet werden. Bei diesen hat die auf dem Feld gemessene Beleuchtungsstärke mit der tatsächlich relevanten Leuchtdichte (Richtung zur Hauptkamera des Fernsehens) so gut wie nichts zu tun. Dies habe ich 1973 mit simultanen Messungen der Beleuchtungsstärke und Leuchtdichte in einem Stadion nachgewiesen. Kurz gesagt: An 13 von 100 Messpunkten versagt die Größe der Beleuchtungsstärke bei der Angabe der gemessenen Leuchtdichte. Stand heute gelten aber die “Anforderungen an die horizontale Beleuchtungsstärke nach Sportarten gemäß DIN EN 12193:2008-04”

Wenn man das Licht aus diesen vier Masten an einer bestimmten Stelle des Spielfeldes zusammenzählen will, um daraus eine sinnvolle Größe für die Leuchtdichte zu erhalten, die für die Kameras und Menschen relevant ist, muss der Rasen ein Lambert-Strahler sein. Dass er das bestimmt nicht ist, kann man als Fussballfan ein paar Mal in jeder Woche am Fernseher erleben. Wie der Rasen in einem Stadion wirklich reflektiert, ist hier skizziert:

Dieser Effekt ist seit etwa 60 Jahren bekannt und gehört mittlerweile zum Erscheinungsbild eines Fussballstadions. Er wird mit Hilfe von besonderen Einrichtungen hergestellt.

Dass die Horizontalbeleuchtungsstärke bei Sportarten wie Fussball nicht nur wenig Bedeutung hat, war dem deutschen Fernsehen in den 1960ern bekannt. Deswegen verlangte es für die Olympiasportstätten in München Vertikalbeleuchtungsstärken. Dennoch blieb es bis heute nicht nur bei den unsinnigen Anforderungen. Die Praxis liegt noch schlimmer daneben.

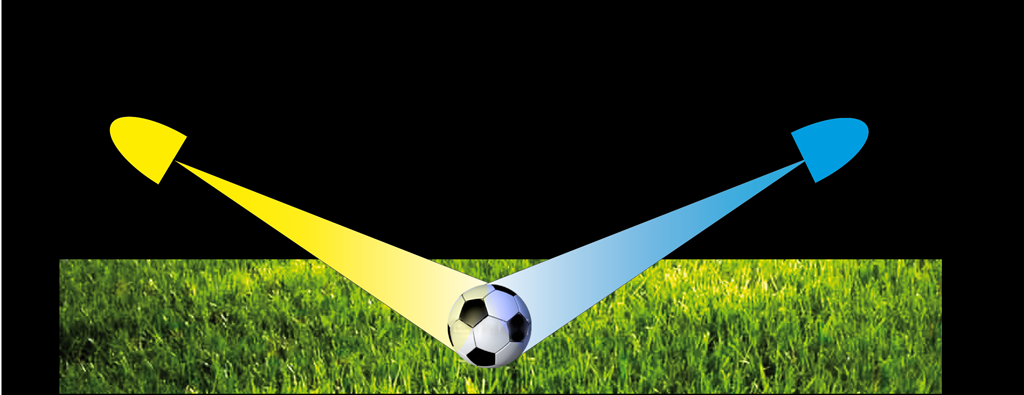

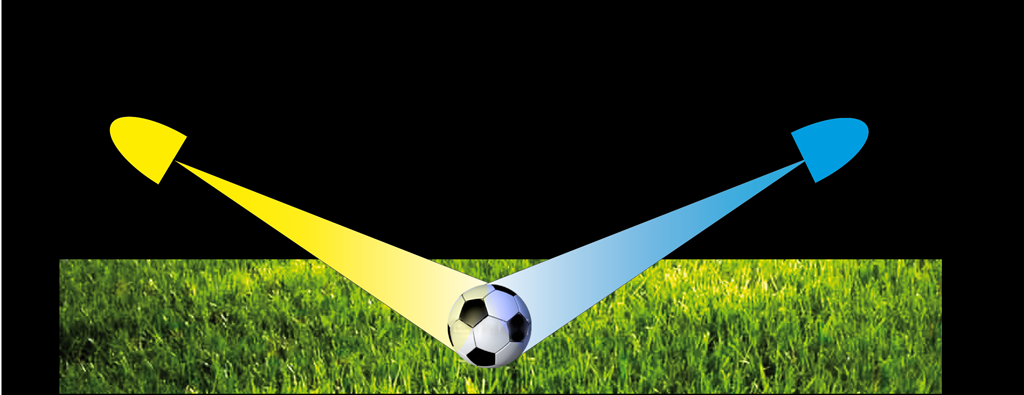

Die Annahme, dass eine Horizontalbeleuchtungsstärke bei den vorliegenden Lichtverteilungen Sinn mache, der die Vorstellung einer Lambertschen Reflexion zugrunde liegt, enthebt die Notwendigkeit, sich Gedanken über die Ebene zu machen, in der das Licht einfällt. Das untere Bild zeigt einen Ball, der von zwei Seiten beleuchtet wird.

Die beiden Scheinwerfer links und rechts werden in der Berechnung ihrer Wirkung einfach zusammengezählt. Wenn ein Mensch oder eine Kamera diesen Ball von links aufnimmt, nützt ihnen der Lichteinfall von rechts garantiert nicht. Somit ist der Kontrast des Balls zu seinem Hintergrund halb so hoch wie berechnet.

Das scheinbar unlösbare Problem der Bildschirmreflexionen

Reflexionen auf Bildschirmen sind seit ihrer Einführung im Büro in den 1960ern ein Thema. Ein Nachweis dafür, dass sie auch heute relevant sind, liefert ein Blick in die Arbeitsstättenverordnung, bei der ein ganzes Kapitel der Gestaltung und dem Betrieb von Bildschirmarbeitsplätzen gewidmet ist. Wie die Beleuchtung von Arbeitsstätten damit erfolgreich umgehen könnte, steht in DIN EN 12464-1: “EN ISO 9241-307 enthält Anforderungen an die visuellen Eigenschaften von Displays bezüglich unerwünschter Reflexionen.”

Offenbar hat aber niemand einen Blick in ISO 9241-307 geworfen. Denn dort stehen keine Anforderungen. Anforderungen können auch nicht dort stehen, was man am Titel der Norm erkennen kann: „DIN EN ISO 9241-307:2009-06 Ergonomie der Mensch-System-Interaktion - Teil 307: Analyse- und Konformitätsverfahren für elektronische optische Anzeigen” .

Tatsächlich sollte die gesamte Normenreihe ISO 9241-30X dazu dienen, die ergonomischen Eigenschaften von Monitoren zu normen. Der Teil ISO 9241-303 heißt dieser Aufgabe entsprechend “Ergonomie der Mensch-System-Interaktion - Teil 303: Anforderungen an elektronische optische Anzeigen”. Doch die Autoren dieser Norm sind in die gleiche Falle getappt wie die Autoren der Norm für die Beleuchtung von Sportstätten. Sie gingen davon aus, dass sich eine Beleuchtung durch die Horizontalbeleuchtungsstärke charakterisieren lasse. Sie rechneten diese Größe lediglich in die Ebene des Bildschirms um. So gelten 2026 die “Anforderungen an elektronische optische Anzeigen” für eine bestimmte Beleuchtungsstärke im Büro, z.B. 300 lx oder 500 lx. Wenn die Norm anwendbar wäre, wären Monitore für diese Beleuchtungsstärken zertifiziert worden. Ein Monitor, der nur in Räumen ordentlich funktioniert, deren Beleuchtungsstärke 500 lx oder weniger beträgt?

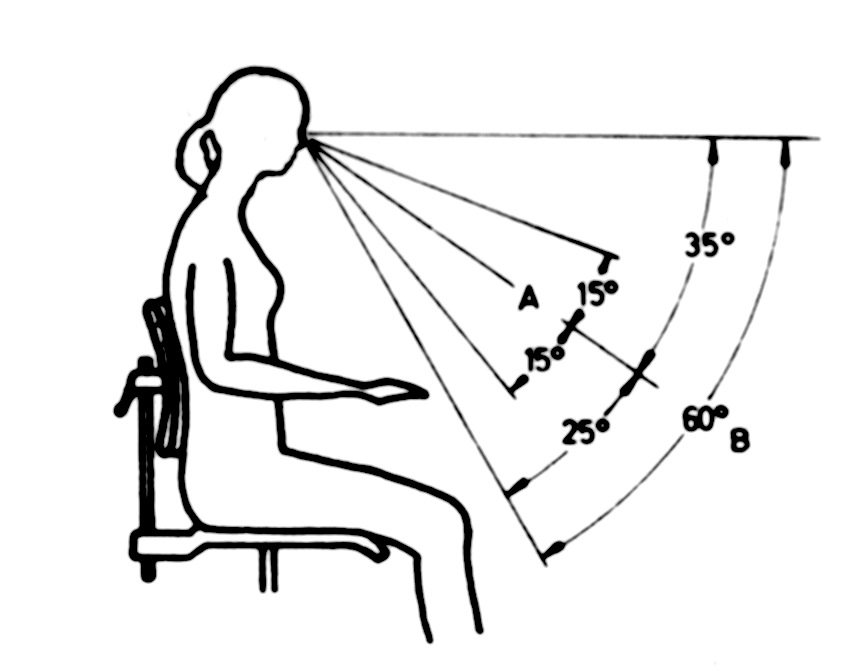

Reflexionen auf optischen Anzeigen gibt es aber immer. Ob sie für den Benutzer überhaupt relevant sind, hängt von seiner Position und von den Leuchtdichten der Flächen ab, die der Benutzer gespiegelt sehen kann. So wird der Benutzer des zu Beginn des Kapitels abgebildeten Computers auch bei 5000 lx seinen Bildschirm gut lesen können. Wenn er 50 cm daneben sitzt, wird das Bild ihn stören, auch wenn die Beleuchtungsstärke nur 100 lx beträgt.

Ein Foto eines kleinen Monitors (< 25 cm in der Breite) mit Reflexionen darauf zeigt, dass die Beleuchtungsstärke im Raum gegenüber der Verteilung von Leuchtdichten fast völlig irrelevant ist.

Eigentlich braucht es keine Bilder, um zu wissen, dass die Beleuchtungsstärke nur eine geringe Rolle spielt. Wäre dem so, würde kein Navigationsgerät in Autos tagüber funktionieren, auch kein großes Display, wie es heute in allen Autos der Fall ist. Denn tagsüber liegt die Beleuchtungsstärke in Fahrzeugen weit jenseits von den Werten in Büroräumen. Man benutzt aber in beiden Fällen eine ähnliche Technik.

Das ist nur ein Beispiel, wie eine Vorstellung, die auf der Lambertschen Reflexionscharakteristik beruht, einen ganzen Normenausschuss in die Irre geführt hat.[1]

Anordnung der Leuchtenreihen in Arbeitsstätten

Die Gründe, warum man in Deutschland (aber auch in vielen anderen Ländern) die Leuchten in Arbeitsräumen in Reihen parallel zur Fensterfront hängt, sind längst vergessen. Man macht es seit mindestens 40 Jahren so.

Was würde sich ändern, wenn ,man sich nicht daran hielte? Man kann sich den Spaß erlauben und einen kleinen Büroraum (Breite 3,60 m, 3 Modulmaße a 1,20 m) mit zwei Leuchtenreihen senkrecht zur Fensterfront anordnen. Dann würde das, was man auf den nächsten Bildern sieht, um 90° gedreht in zweifacher Ausfertigung über die ganze Breite des Arbeitsplatzes möglich sein und sich bei jeder Körperbewegung in Richtung des Monitors mitbewegen.

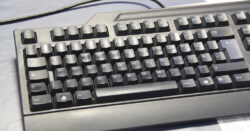

Um solche Effekte zu vermeiden, geben die Beleuchtungsnormen immer vor, bestimmte Maßnahmen zur Verminderung der Reflexblendung zu treffen. Deren Aufzählung begann in der ältesten mir vorliegenden Norm, DIN 5035-1:1962 (Entwurf) so: “Blendung hervorgerufen durch Spiegelung von Leuchten in beleuchteten Gegenständen (Reflexblendung) kann im allgemeinen durch geeignete Wahl der Lichteinfallsrichtung, in manchen Fällen durch entsprechende Behandlung der Oberfläche (mattes Papier, matter Kopierstift, Tasten von Schreibmaschinen aus nicht speigelndem Material und dergleichen vermieden werden.” Wenn man sich nicht auf dergleichen verlassen wollte, konnte man dem Rat der Norm folgen, der da hieß: “Allgemein kann Reflexblendung durch Erhöhung des diffusen Anteils der Beleuchtung gemildert werden.”

Da man sich 1962 schon auf die kommende Änderung des Bürohausbaus freute – man dachte , 1980 würden alle Büroarbeitsplätze im Großraumbüro angesiedelt sein -, war die Sache mit der Lichteinfallsrechnung nicht gerade der große Hit. Eine “durch Erhöhung des diffusen Anteils der Beleuchtung” wäre problemlos und effizient, indem man Indirektbeleuchtung einführte. Aber gegen diese hatte die Lichttechnik immer was. So blieb die einzige beherzigte Empfehlung “entsprechende Behandlung der Oberfläche (mattes Papier, matter Kopierstift, Tasten von Schreibmaschinen aus nicht speigelndem Material und dergleichen” übrig. Man verordnete allen alle Tischoberflächen, Arbeitsgeräte und Materialien matt zu machen. Mattes Papier kann man kaufen, auch wenn man nicht selten glänzendes braucht. Wie soll ein Arbeitgeber aber Schreibmaschinen kaufen, die der Beleuchtung passen?

Im Entwurf von DIN 5035-1:1969 war nicht viel anderes zu lesen: “Reflexblendung lässt sich durch Festlegen einer geeigneten Lichteinfallsrichtung, Erhöhung des diffusen Anteils der Beleuchtung oder durch Anwendung großer Leuchtflächen verringern. Ferner sollen Arbeitsflächen, Papier, Schriften, Tasten von Schreibmaschinen und dergleichen möglichst matte Oberflächen haben.”

Als die Norm 1972 erschien, wurden die diffusen Anteile nicht größer, sondern kleiner, weil man statt Plexiglasabdeckungen (= Diffusoren) nunmehr Raster verwendete. Da die Lampen auch effizienter wurden, wuchs die Leuchtdichte der Reflexe. Insgesamt wurden die leuchtenden Teile kleiner, somit die Blendung stärker.

In der letzten Ausgabe der DIN 5035-1:1990 war die Vermeidung der Reflexblendung zu einem längeren Abschnitt geworden. Auch hier beginnt die Aufzählung der Maßnahmen mit “Anordnung von Leuchten und Arbeitsplätzen”: “Durch geeignete Anordnung sind Leuchten und Arbeitsplätze einander so zuzuordnen, daß für den arbeitenden Menschen möglichst keine störenden Lichtreflexe auf dem Sehobjekt entstehen können. Für ebene, waagerecht liegende Sehobjekte ist dies bei seitlicher Lichteinfalssrichtung gegeben.” Und die Sehobjekte, die nicht matt flach vor einem liegen? “Oberflächen, in denen sich Leuchten spiegeln können, sollen matt oder entspiegelt gestaltet sein.” Solche Oberflächen sind nach der Norm Oberflächen von Arbeitsplätzen, Papier, Schreibmaterialien wie Tinte, Tusche usw., Tasten von Schreibmaschinen, EDV-Terminals usw., Bildschirmgeräte.

Kurz gesagt, um eine störungsfreie Beleuchtung zu genießen, müssen die gesamte Umwelt und alle Geräte matt gestaltet sein. Wer das nicht schafft, ist selber schuld. Was ist, wenn Computerhersteller “glossy” Displays anbieten, die heute bei drei von vier Handys hübsch glänzen?

Die Lichttechnik wollte aber auch selber etwas tun und gab dies vor: “Leuchten, die für den arbeitenden Menschen Lichtreflexe auf dem Sehobjekt erzeugen können, sollen für die kritischen Ausstrahlungsrichtungen niedrige Leuchtdichten haben.” Das würde unter zwei Bedingungen helfen:

- Man berücksichtigt alle Richtungen, die störanfällig sind.

- Man misst die Leuchtdichte, die die Störung verursacht.

Leider ist beides nicht geschehen. Die Normer postulierten, nur der Bereich zwischen 20° und 30° von der Vertikalen unter der Leuchte wäre störend, als würden die arbeitenden Menschen in Normhaltungen unter den Leuchten sitzen. Und die Messung der Leuchtdichte ist fehlerhaft. Man misst die Lichtstärke in einer gegebenen Richtung und berechnet daraus die mittlere Leuchtdichte unter der Annahme, dass die gesamte Leuchtenfläche Licht abstrahlt. Das gilt für Spiegelrasterleuchten nicht.

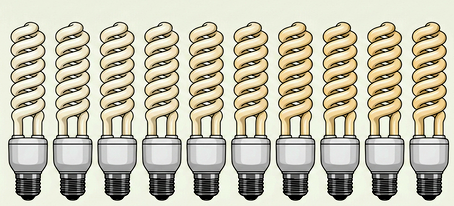

Zu guter Letzt war, bei einem etwa gleichbleibenden Katalog an Methoden, die Leuchtdichte der benutzten Lampen durch den Fortschritt der Technik in einem unvorstellbaren Maß gewachsen. Hier ein Vergleich der Lampendurchmesser, wobei die Leuchtdichte in dem Maße wächst, wie der Lampenquerschnitt geschrumpft ist (gelbe Fläche gegen die rote)

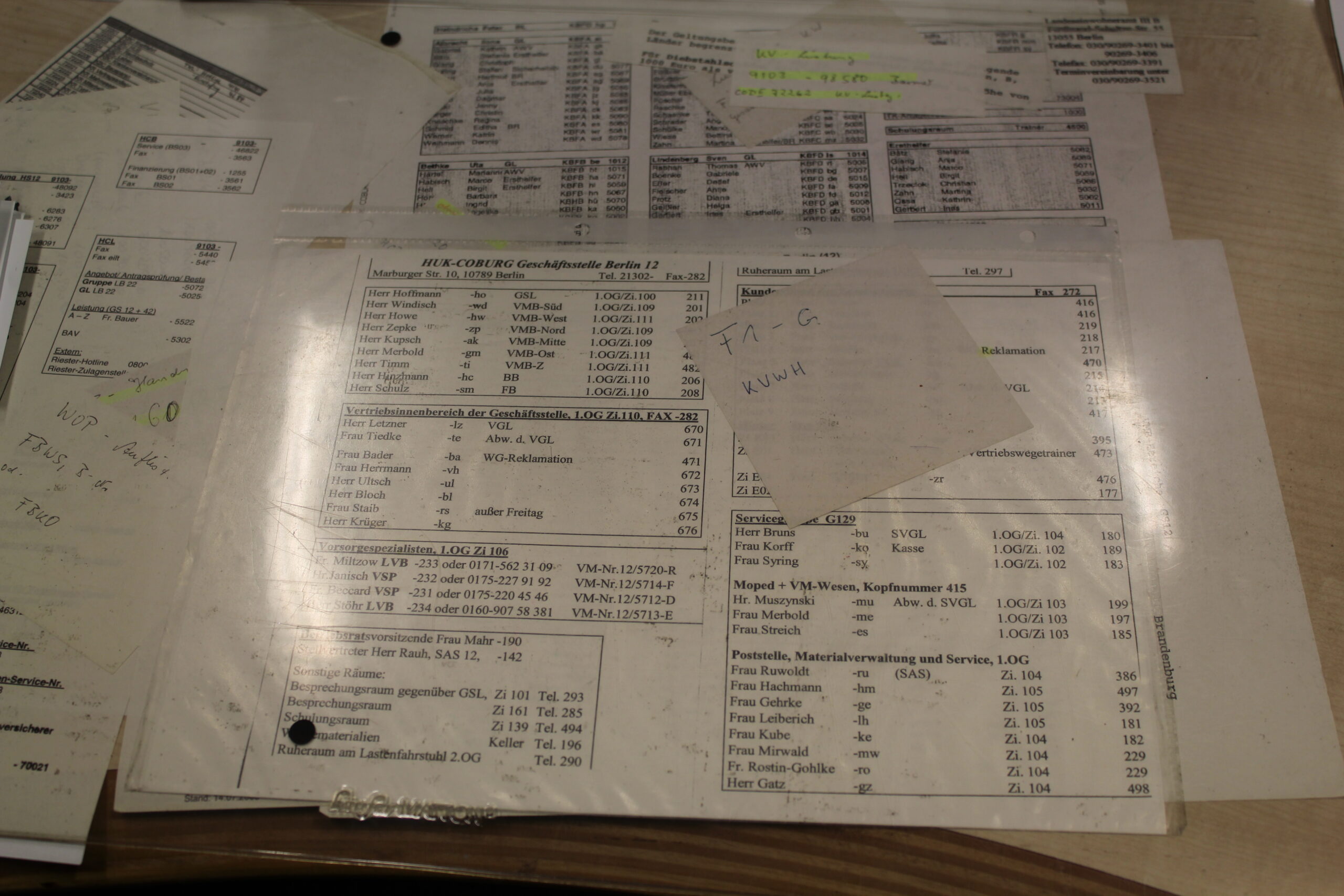

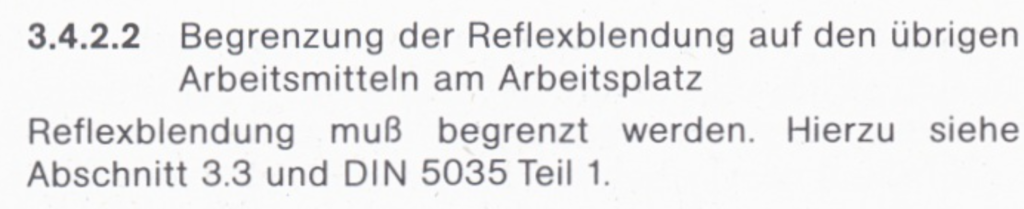

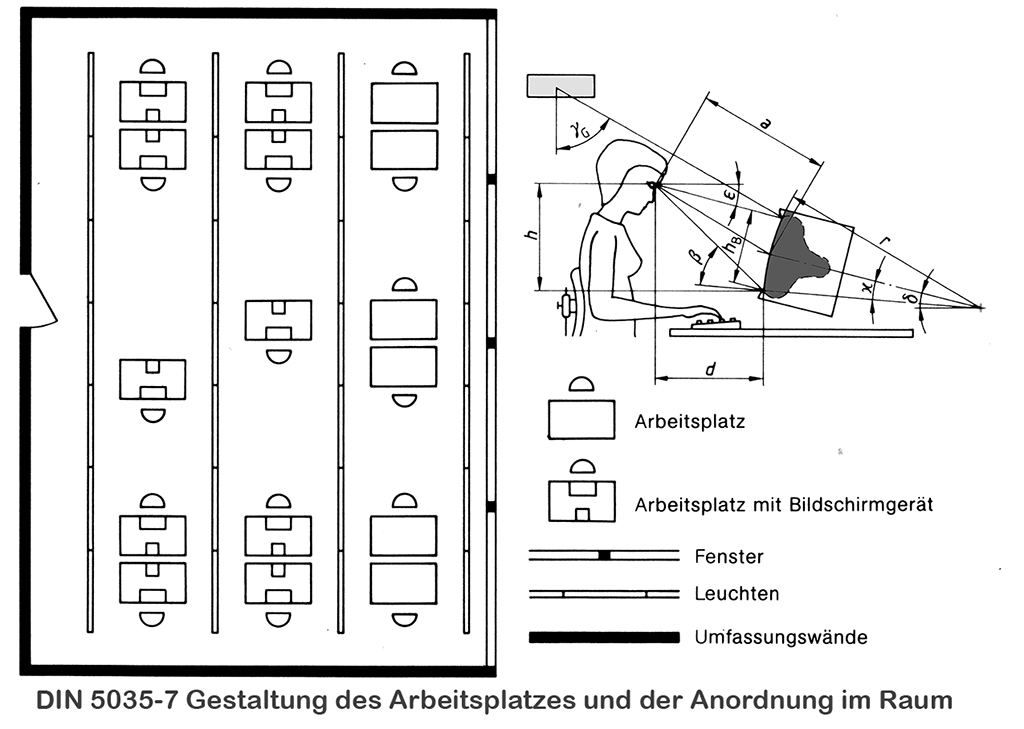

Der wahre Hammer kam aber mit DIN 5035-7:1988. Obwohl die Autoren dieser Norm teilweise die gesamte Geschichte der Normenreihe DIN 5035 kannten, weil sie sie selbst geschrieben hatten, war die “Begrenzung der Reflexblendung” mittlerweile auf zwei Seiten angewachsen, beschrieben wurde aber auf diesen zwei Seiten akribisch, wie man dem neuen Gütekriterium dient, das da hieß: “Vermeidung störender Spiegelungen heller Flächen auf dem Bildschirm”. Und das, was man seit Jahrzehnten immer wieder neu formuliert, aber weitgehend beibehalten hatte, war plötzlich fast zu einer Fußnote geschrumpft. Weil es so schön aussieht, zeige ich die in Faximile.

Reflexblendung muss begrenzt werden. Basta! Es gibt nur ein Problem, und dies hatte der Initiator dieser Norm sogar selbst veröffentlicht. Wenn jemand die Norm DIN 5035-7 anwendet, kann man die Reflexblendung auf dem Bildschirm vielleicht mindern, aber die auf allen anderen Oberflächen, Tastaturen, Tischen, Telefonen wird stärker. Das ist unvermeidbar, weil diese Norm eine Beleuchtung mit tiefstrahlenden Leuchten vorschrieb, die jegliche diffuse Beleuchtung unterdrückte. Da die Raumflächen auch abgedunkelt werden sollten, wurde der diffuse Anteil an der Beleuchtung noch geringer.

Auf die Idee, den Bildschirm zu entspiegeln, statt die ganze Beleuchtung und den Raum umzugestalten, kam man wundersamerweise nicht. Diese Lösung war aber allen Autoren der Norm aus einem Forschungsbericht des Arbeitsministeriums aus dem Jahr 1978 bekannt, den ich geschrieben hatte. Diese Arbeit sollte als Grundlage der Normung der Bildschirmarbeitsplätze dienen und ist praktisch in jedes Regelwerk eingeflossen, das seitdem zu diesem Bereich entstanden ist, auch in viele ausländische regelwerke. Den Anfang machten die “Sicherheitsregeln für Bildschirmarbeitsplätze im Bürobereich” der deutschen Berufsgenossenschaften im Jahr 1980. Im Jahr 1990 kam die europäische Bildschirmrichtlinie dazu, die die Sicherheit und Gesundheit des arbeitenden Menschen zum Ziel hat. Diese wurde in Deutschland 1996 in die Bildschirmarbeitsverordnung umgesetzt. Im Jahr 2016 wurde sie in die Arbeitsstättenverordnung umgesetzt. Die diesbezügliche Anforderung hieß

- Der Bildschirm muß so ausgeführt sein, daß Spiegelungen und Reflexionen weitgehend vermieden werden und sich nicht mehr störend bemerkbar machen. (1980)

- Der Bildschirm muss frei von Reflexen und Spiegelungen sein, die den Benutzer stören können. (1990)

- Der Bildschirm muß frei von störenden Reflexionen und Blendungen sein. (1996)

- Bildschirme müssen frei und leicht dreh- und neigbar sein sowie über reflexionsarme Oberflächen verfügen. Bildschirme, die über reflektierende Oberflächen verfügen, dürfen nur dann betrieben werden, wenn dies aus zwingenden aufgabenbezogenen Gründen erforderlich ist. (2016 – heute)

Hätte man also das Wissen um die Lambertsche Reflexion richtig gewertet und angewandt, hätte man sich den ganzen Unsinn mit der Beleuchtung zum Entspiegeln der Bildschirme ersparen können. Das sonderbare Gütekriterium “Vermeidung störender Spiegelungen heller Flächen auf dem Bildschirm” wäre uns auch erspart geblieben.

Das alles ist aber nicht so schlimm wie eine weitere Konsequenz, die im nächsten Abschnitt dargestellt wird.

Wenn große Teile des Arbeitsraums leer stehen müssen …

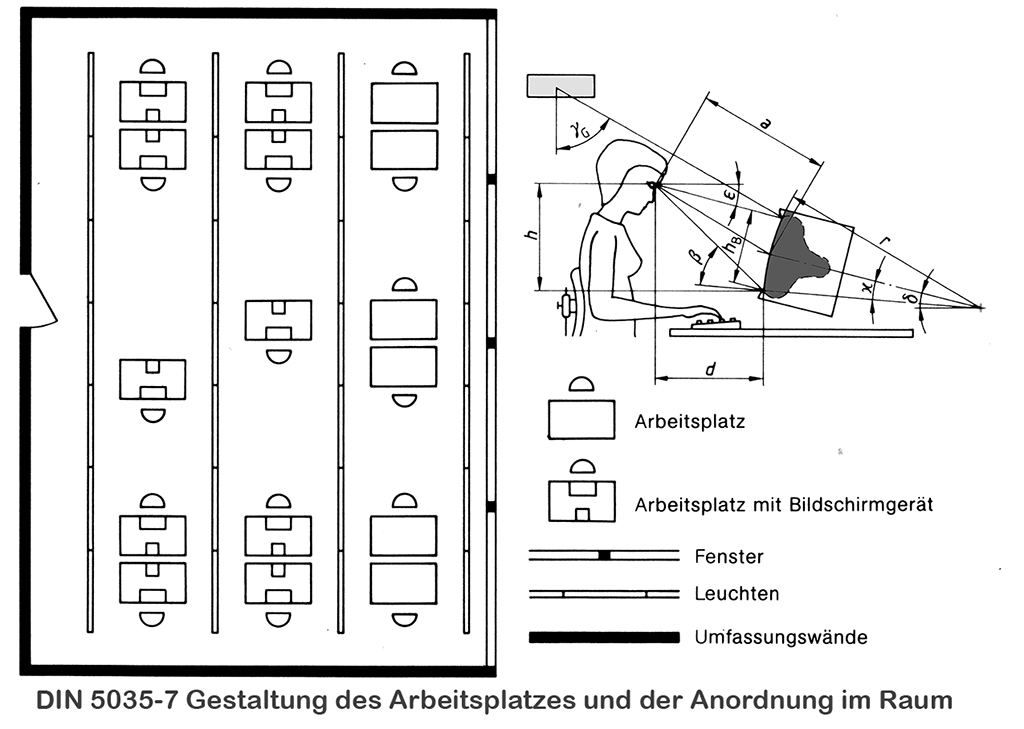

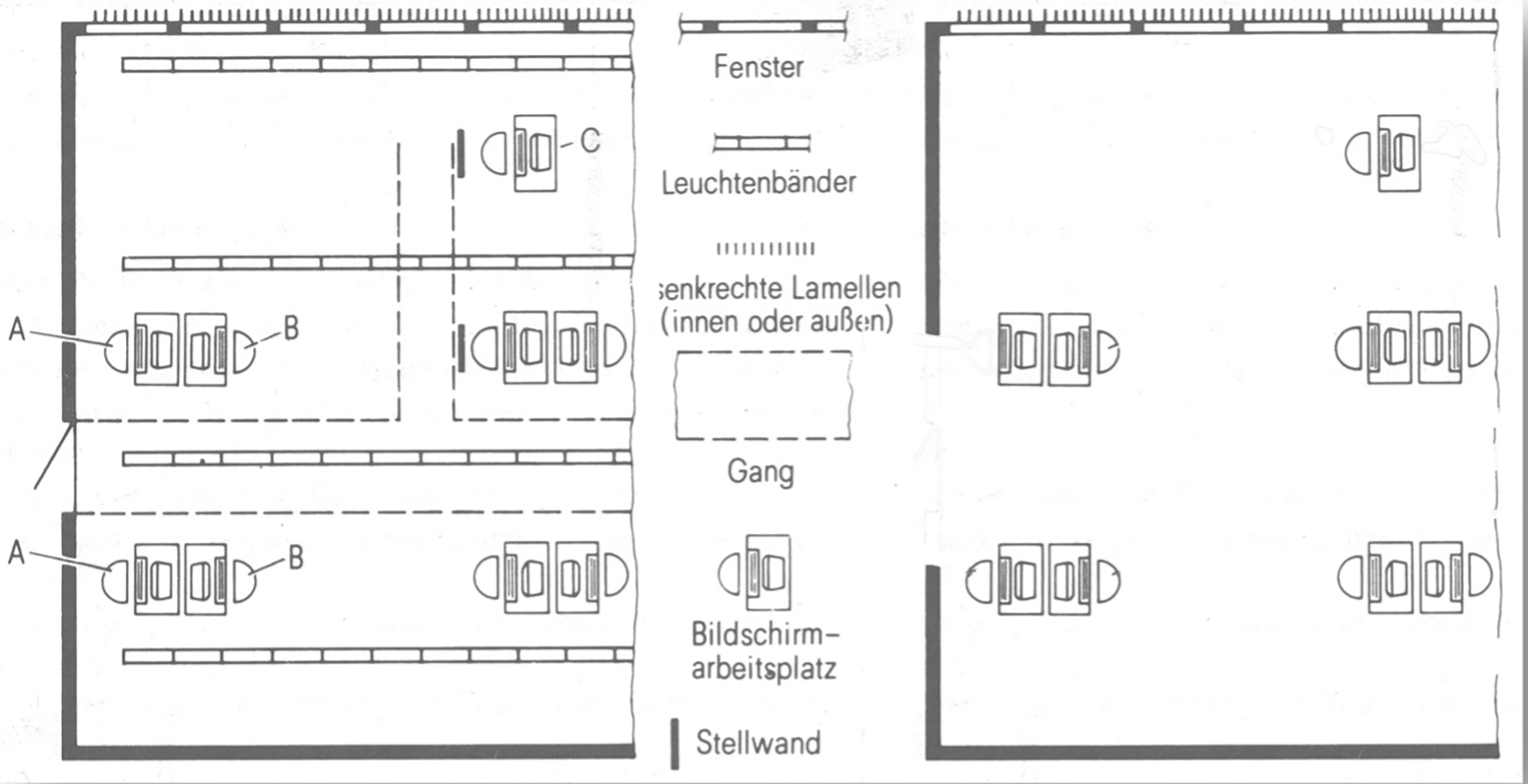

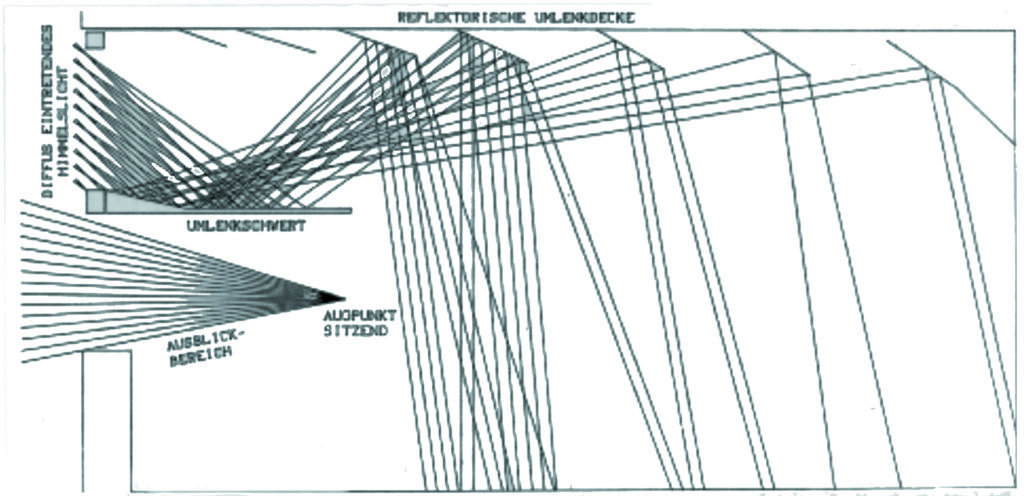

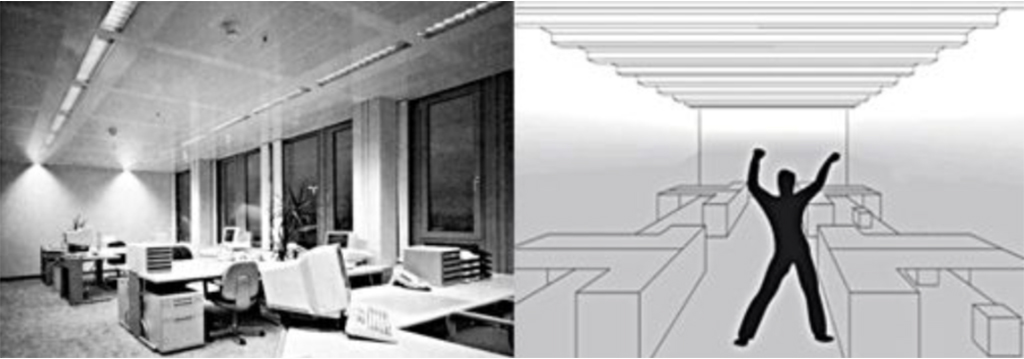

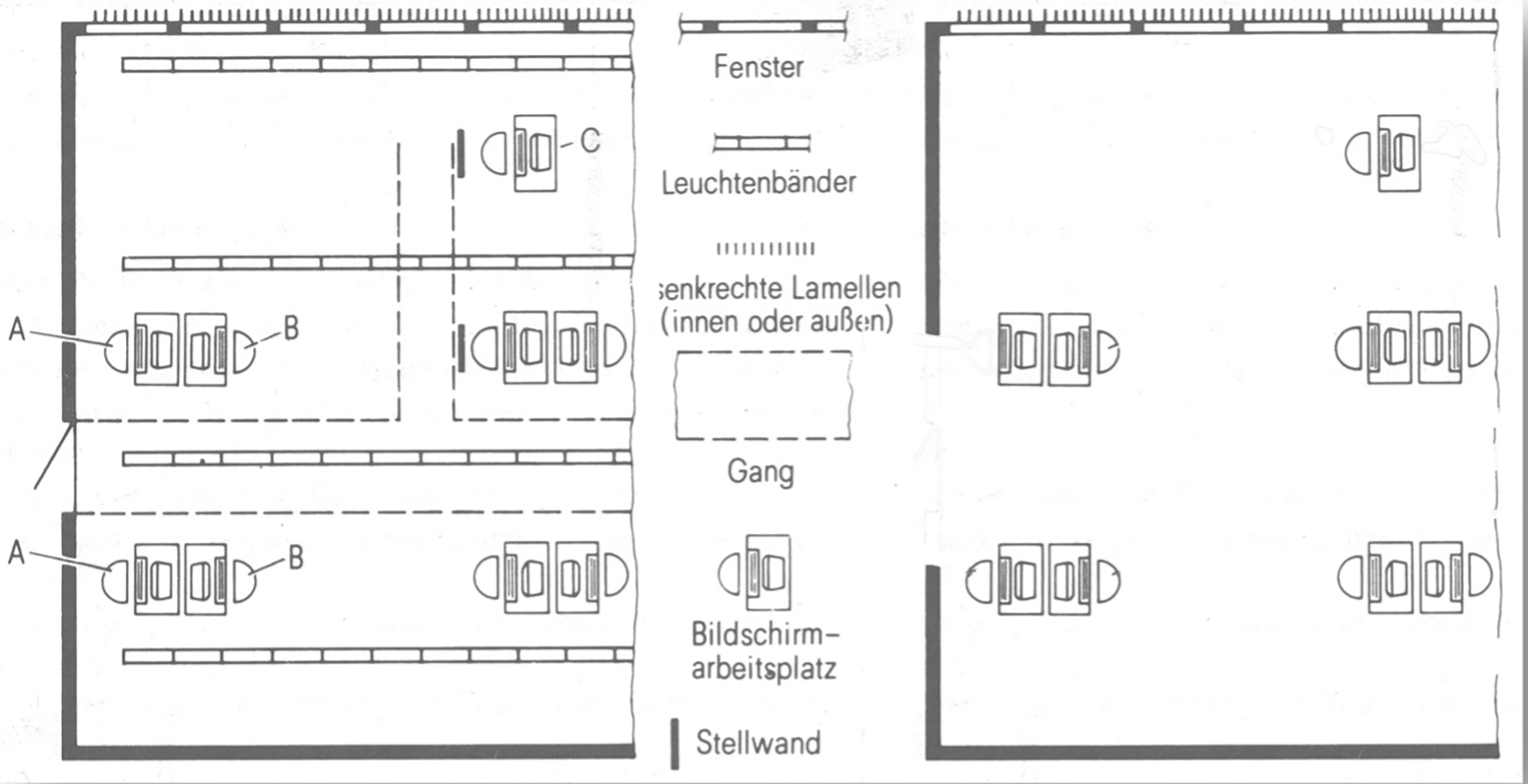

Dieses Thema wird im Kapitel Wenn nur ein Wenn man die störenden Elemente aus dem Bild links entfernt, sieht man deutlich den Anteil der Raumfläche, der besiedelbar wäre, wenn man eine Allgemeinbeleuchtung realisiert. des Arbeitsraums benutzbar ist ausführlich diskutiert. Hier erfolgt eine kurze Erwähnung. Wenn man die seit Jahrzehnten propagierte Maßnahme zur Vermeidung der Reflexblendung, Anordnung der Arbeitsplätze, erweitert, wie in DIN 5035-7:1988 geschehen, um auch die Entspiegelung der Bildschirme in die Betrachtungen einzubeziehen, musste man sehr viel mehr berücksichtigen als nur die Anordnung flacher Tische. Man musste nicht weniger als die empfohlene Beleuchtungsart ändern. Wurde seit 1972 die Allgemeinbeleuchtung als Regel empfohlen, musste man jetzt auch die arbeitsplatzorientierte Allgemeinbeleuchtung als gleichwertig zulassen.[2]

Weiterhin mussten die Bildschirmarbeitsplätze in das Rauminnere verbannt werden, was das untere Bild verdeutlicht. Einen besseren Beweis dafür, dass das Konzept während des Tages schlecht aufgeht, gibt es kaum: diese Empfehlung. Sie wirkt nur dann, wenn die dominierende Beleuchtung künstlich ist. Das ist in den meisten deutschen Büros zwischen Ende März und Anfang Oktober nicht der Fall. Wenn ein Raum ordentlich gebaut ist, braucht man in diesem Zeitraum zu 90% der Zeit kein künstliches Licht.

Die – angeblich – erforderlichen Bedingungen für einen störungsfreien Betrieb würden dann realisiert, wenn die Arbeitsplätze in einem engen Bereich aufgestellt würden.

Die Bestimmung dieses Bereichs sollte in Abhängigkeit von der Röhrenkrümmung erfolgen, die man auch für die Abstrahlcharakteristik von Leuchten heranzog.

Bilder wie diese aus DIN 5035-7 verschleiern etwas Wichtiges durch die Eintragung der Leuchtenreihen. Entfernt man sie aus solchen Bildern, wird der Unsinn, der hinter solchen Ideen steckt, sehr deutlich. Dies habe ich in dem unteren Bild dargestellt.

Links sieht man einen Raum mit diversen Einträgen, die man in Natura nicht sieht, rechts ist der Raum von allen Elementen befreit. Wenn man die störenden Elemente aus dem Bild links entfernt, sieht man deutlich den Anteil der Raumfläche, der besiedelbar wäre, wenn man eine Allgemeinbeleuchtung realisiert. Kein Unternehmen kann sich leisten, einen solchen Unsinn umzusetzen. Sollte es doch eine Firma geben, die die Kosten tragen will, wird die Belegschaft nicht mitspielen. Niemand will auf einsamen Inseln in einem fast leeren Raum arbeiten.

Wenn sich der übermäßige Flächenverbrauch zu den weiteren unerfüllbaren Anforderungen wie von Tinte bis zum Computer alle Gegenstände im Arbeitsraum matt zu gestalten hinzukommt, können die Betriebe nur eins: ignorieren. Und dies geht zu Lasten der arbeitenden Menschen. Denn die durch die Beleuchtung vorgeblich zu lösenden Probleme sind real, nur die Lösungen sind untauglich.

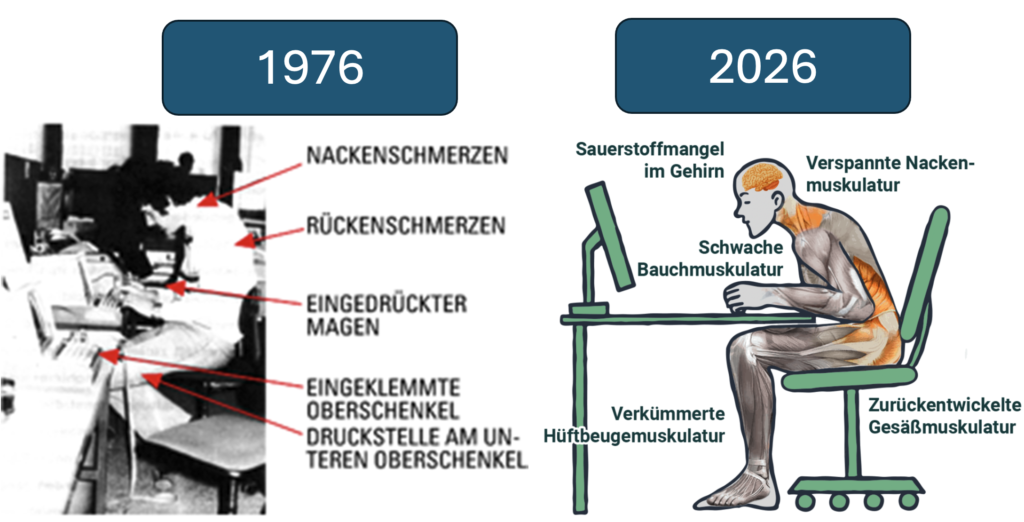

Wenn man Meldungen wie diese in der Zeitung liest, sollte man immer wieder an das Licht denken:

In einer Umfrage, bei der sich 78% der Befragten mit ihrem Raum zufrieden zeigten, wollte nur 1% (!) im Großraum arbeiten.

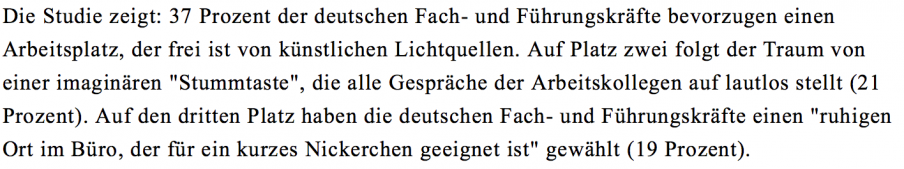

Noch heftiger fällt das Urteil von deutschen Managern aus. Nach ihrem wichtigsten Kriterium für ihren Arbeitsplatz gefragt, wünschen sich 37% einen Arbeitsplatz frei von künstlichen Lichtquellen. Das größte Problem der Büromenschen nach ergonomischen Studien, Lärm im Büro, kommt weit abgeschlagen auf Platz 2.

Wie hätte man denn agieren müssen?

Arbeitsplätze mit Problemen, für die es keine oder mäßig erfolgreiche Lösungen gibt, sind nicht selten. Das liegt manchmal an den Problemen, manchmal an dem lieben Geld. Zuweilen liegt es sogar daran, dass die störende Wirkung Folge einer erwünschten Lösung ist. So gibt es für Problem Nummer 1 im Büro, Lärm, eine einfache Lösung: Einzelzimmer. Diese Büroform ist aber nicht die beliebteste, sondern das Doppelzimmer. Aber in keiner anderen Büroform kann es nach akustischen Messungen lauter werden. Das Doppelzimmer ist aus verschiedenen Gründen beliebt.

Daher sollte man mit Lösungen vorsichtig sein, wenn Fachleute nicht zu denen greifen. Aus diesem Grunde habe ich einige Jahrzehnte mit Beleuchtung experimentiert, bis ich mir eine finale Meinung gebildet habe.

Hätte man der Reflexblendung mit dem Wissen begegnet, das 1962 in der Beleuchtungsnorm gestanden hat, Erhöhung des diffusen Anteils an Beleuchtungsstärke hilft, wären die meisten Probleme nicht entstanden. Wir haben dies in der Studie Licht und Gesundheit bis 1990 mit Untersuchungen an 2.000 Arbeitsplätzen und Befragungen von ca. 900 Personen ermittelt. Anschließend haben wir 1.500 Arbeitsplätze mit neu entwickelter Beleuchtung ausgestattet, um den Nachweis zu führen, dass die Verbesserungen tatsächlich auf die Eigenschaften der Beleuchtung zurückzuführen sind.

Man kann die notwendige Maßnahme mit Indirektbeleuchtung oder mit (teilweise) leuchtenden Decken realisieren. Das Entscheidende ist, dass die leuchtenden Flächen eine geringe Leuchtdichte besitzen. Wer eine vernünftige Indirektbeleuchtung realisiert, braucht keine Anforderungen an die Aufstellung der Arbeitsplätze, die kaum jemand erfüllen kann außer auf Zeichnungen. Vor allem muss man nicht fordern, dass von der Tinte bis zum Computerterminal alles matt sein soll. Wer soll denn das realisieren?

Man hätte einfach einsehen müssen, dass das Lambertsche Gesetz ein mathematisches Konstrukt ist, dem die wenigsten physikalischen Materialien bzw. deren Oberflächen genügen. Von betrieben Dinge zu verlangen, die sie nicht realisieren können, kann nur Scheinlösungen hervorbringen.

Was die Bildschirme angeht, hätte man unter Beachtung ihrer Reflexionscharakteristika feststellen können, dass ihr Verhalten so weit von einer Lambertschen Reflexion abweicht, dass eine Lösung auf der Basis einer fest installierten Beleuchtung nicht gefunden werden kann. Die einzig gangbare Lösung, Bildschirme zu entspiegeln und Reflexe zusätzlich durch einen hellen Hintergrund relativ unsichtbar zu machen, war 1975 von mir formuliert und 1980 vom Arbeitsschutz akzeptiert worden. Warum musste ein Jahrzehnt später eine „lichttechnische“ Lösung gesucht werden?

Wann werden wir das Phantom los?

Ein mathematisches Modell kann man leider nicht loswerden. Wenn es eine gute Lösung beschreibt, kann man versuchen, sich dem Ideal anzunähern. Mir schwebt in dieser Hinsicht das Beispiel der Kugel vor. Diese ist mathematisch absolut rund in allen Richtungen. Reale Kugeln sind nicht rund, sie weichen etwas vom Ideal ab. Mit üblichen Kugeln kann man hinreichend gute Kugellager bauen. Will man sehr leise Kugellager bauen, müssen die Kugeln runder sein. Diese kann man auch fertigen. Es wird nur teurer. Braucht man Kugeln, die sehr nahe an die mathematische Form der Kugel kommen, muss man sie selektieren. Ähnlich verfährt man heute auch bei LEDs. Früher war das Vorgehen bei Transistoren üblich.

Was wir loswerden müssen, ist, dass man Beleuchtungen normt oder erstellt, die nur unter unerfüllbaren Bedingungen gut funktionieren. Zwar ist jeder Hersteller frei, die Einsatzbedingungen seines Produktes vorzugeben. Wenn man allerdings zu viel voraussetzt, kann es sein, dass die Anwender zu einfachen Mitteln greifen. So herrscht heute bei Standard-LED-Leuchtmitteln (Retrofits) ein extremer Preisdruck durch asiatische Massenware. Wenn man sich nach einer langen Planung eh Ärger einhandelt, greift man gleich zu Billigware.

Zudem ziehen viele Menschen vor, möglichst selten im Büro zu weilen. Die Unternehmen müssen ihre Mitarbeitenden mit einer angenehmen Umgebung ins Büro locken. Trotz aller Bemühungen haben wir in Deutschland derzeit ca. 8 % Büroleerstand. Wenn man sich die Bürokonzepte anguckt, mit denen man das Bürohaus für die arbeitenden Menschen schmackhaft machen will, liest man sehr häufig „Stehleuchten, Tischlampen statt Deckenlicht“, „keine Deckenbeleuchtung“ oder „keine Neonlampen an der Decke“. Was sich Menschen wünschen, habe ich unter Licht für New Work dargelegt.

[1] Da diese Normenreihe zwar nicht anwendbar ist, aber dennoch in Deutschland aus rechtlichen Gründen angewendet werden muss, hat mein Ausschuss für den Gebrauch der Prüfstellen in Deutschland einen Standard produzieren müssen, der eine Prüfung dennoch möglich macht.

[2] Zu dem Begriff Allgemeinbeleuchtung ist zu bedenken, dass es diese ohnehin nicht gegeben hat. Wenn man Allgemeinbeleuchtung definiert als eine Beleuchtung, die an allen Stellen des Raums etwa gleich gute Sehbedingungen schafft und gleichzeitig empfiehlt, Arbeitsplätze der Anordnung der Leuchten entsprechend zu platzieren, gesteht man, dass es keine Allgemeinbeleuchtung gibt.