Die Wahrheit ist selten rein und nie einfach.

Oscar Wilde

Blendung und „natürliche“ Farben - Das waren die Themen der letzten beiden Blogs. Doch die Beschreibung von Erscheinungen, mit denen der Techniker nicht gerade meisterhaft umgehen kann, ist damit nicht komplett. Erst richtig schwierig wird es, wenn man den Begriff oder die Erscheinung Glanz dazu nimmt.

Aber zuerst zu dem „Techniker“. Dieser ist ein Mensch, der einen Beruf ausübt, dessen Name vom griechischen Wort techne stammt. Und die heißt so viel wie Kunst, Gewerbe, Geschick, List, Betrug. Nicht eines davon, sondern alle zusammen. List und Betrug darf man allerdings nicht im Sinne des Strafrechts nehmen, sondern im Sinne von Geschick. Der Techniker überlistet Natur, Materialien, Naturgesetze u.ä., um etwas zu erzielen. So kann ein Mensch fliegen, ohne dass ihm Flügel wachsen.

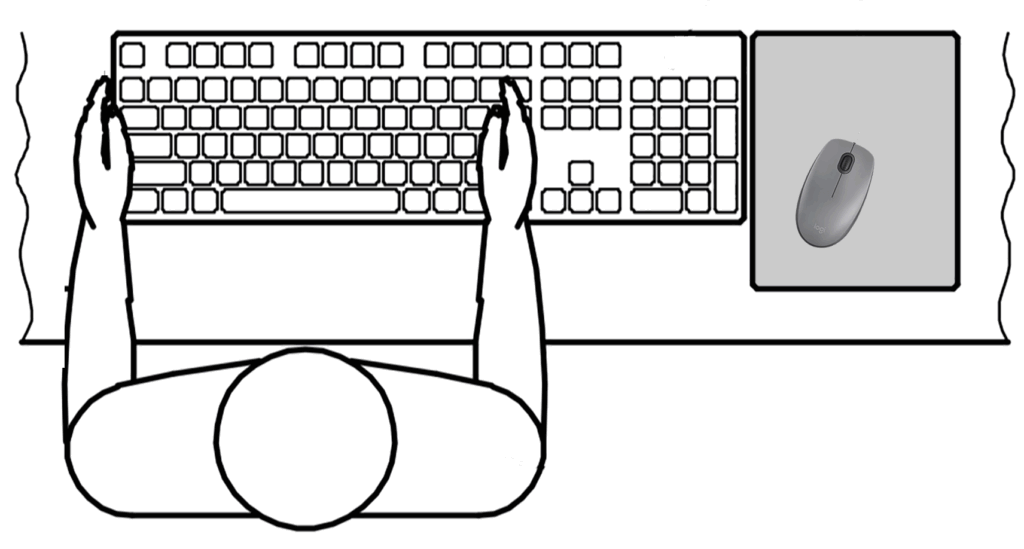

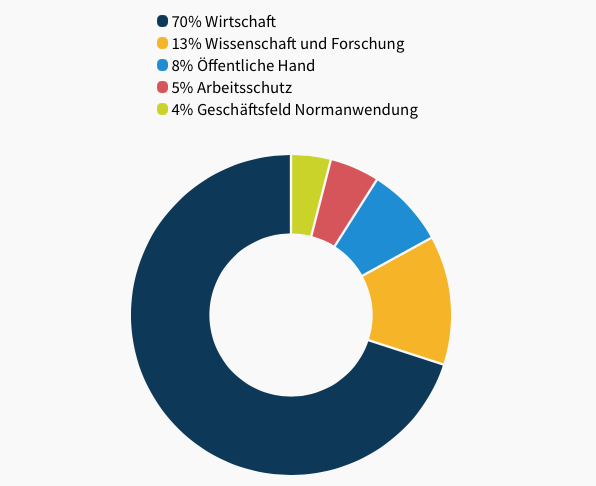

Wenn der Techniker mit Glanz umgehen soll und dabei gewissenhaft objektive Größen benutzen, handelt er als Physiker, dessen Welt viel regelhafter ist als die des Technikers. Dies musste ich in meinen jungen Jahren tun, und die Sache war bitter ernst. Die Menschen, die am Computer arbeiteten, hatten Probleme mit den Augen, die sie auch heute haben, aber damals schimpften sie mehr. Also musste ich die sog. visuellen Probleme der Menschen ermitteln und Lösungen dafür finden. Diese wurden nicht in den Sand geschrieben, sondern in Normen, die heute 50 Jahre danach immer noch ihre Wirkung entfalten.

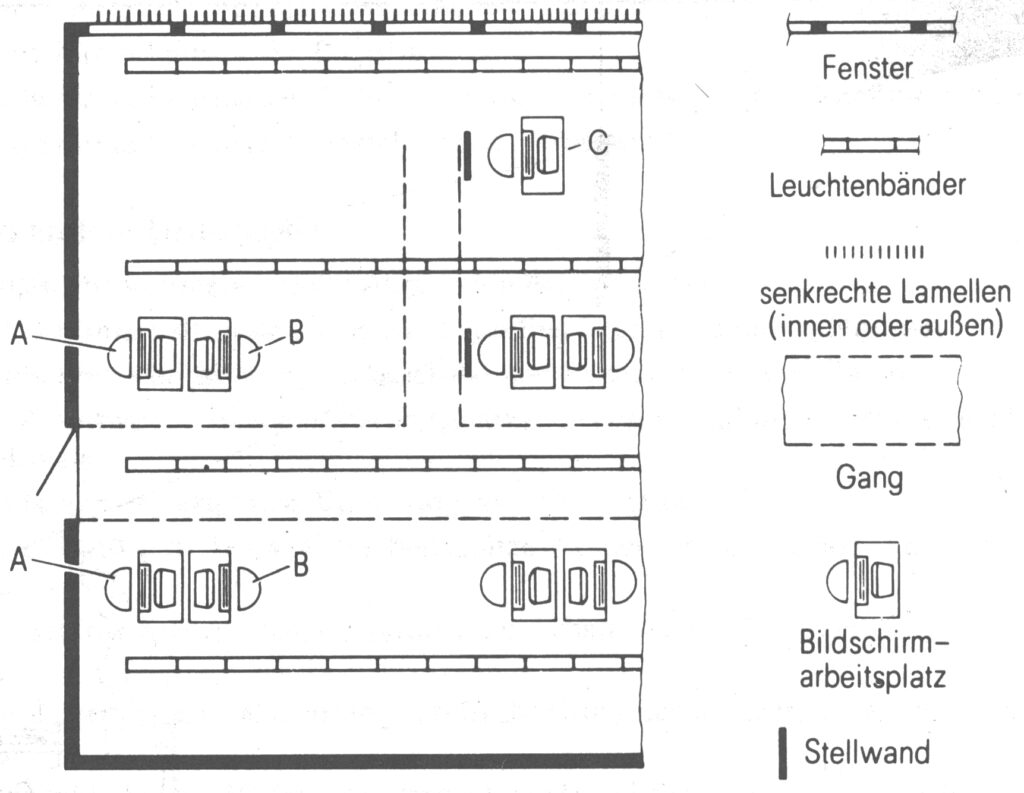

Eine meiner Diagnosen war, dass die Bildschirme glänzten. Ergo schrieb ich in den Normenentwurf, die dürfen nicht glänzen. Nun bestand die Arbeitswelt nicht nur aus glänzenden Bildschirmen. Wenn die nicht glänzen dürfen, warum dürfen andere? Also schrieb ich in den Normenentwurf, dass alle Teile des Arbeitsplatzes aus matten Oberflächen bestehen müssen. Die Vorstellung musste ich nicht einmal selbst entwickeln. Sie stand in der Beleuchtungsnorm DIN 5035 und verbot den Glanz schon vor über 50 Jahren.

Ein Mitglied unseres Normenausschusses nahm dann diesen Entwurf in seinen Betrieb und legte ihn seinen Büroorganisatoren vor. Deren Meinung war verheerend: eine Welt ohne Glanz. Matt wie platt.

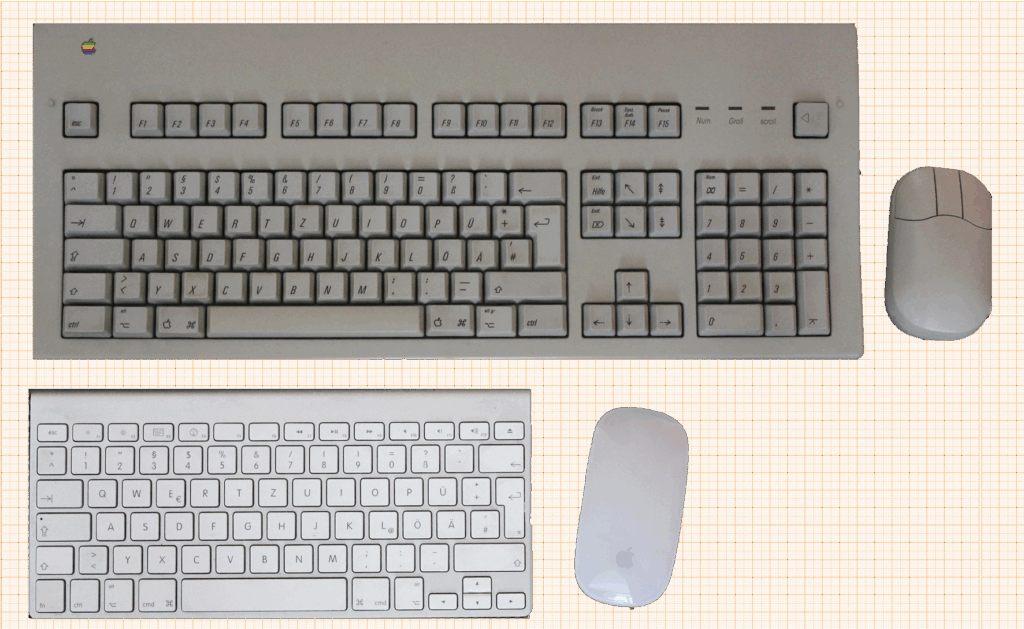

Die besagten Herren waren noch gnädig. Große Computerfirmen gingen dagegen aggressiv vor. Sie hatten aber mit Zitronen gehandelt, denn dafür, dass Bildschirme glänzen sollen, gab es keine Begründung. Also floss die Idee in Normen, später in Sicherheitsregeln und ganz zuletzt in Arbeitsschutzvorschriften wie die EU-Richtlinie für die Arbeit mit Bildschirmen von 1990. Auch der Bundesarbeitsminister verschreibt den Betrieben in der ASR A6 (Bildschirmarbeit) von 2024: „Grundsätzlich sind an Bildschirmarbeitsplätzen Bildschirme mit entspiegelten (matten) Displays und matten Gehäuseoberflächen zu verwenden.“ Er lässt nur wenige Ausnahmen zu.

Die fehlende Begründung für glänzende Bildschirme kam später, als Computer auch Videos abspielen konnten. Auf matten Bildschirmen sahen schicke Filme gar nicht so schick aus. So bauten unbotmäßige Computerhersteller Laptops mit glänzenden Bildschirmen. Denn man kann nicht dauernd das Display wechseln, wenn man mal Büroarbeit macht und mal einen Porno einzieht.

Das Problem besteht bis heute, aber mit anderen Begründungen. Der technische Fortschritt hat zu Monitoren geführt, die weniger glänzen als die Vorschrift erlaubt. Aber Handys lassen sich schwer verkaufen, wenn ihre Displays tot aussehen. Da diese aber das ganze Gesicht vom Handy ausmachen, glänzen die dummen Dinger um die Wette. So auch mein iPhone, wenn es als Display für meine Drohne dienen soll, die bei Kaiserwetter den Berliner Wannsee ablichten will. Da ich kaum noch was sehe, haut die Drohne manchmal ab. Sie kommt eine halbe Stunde später reumütig wieder, wenn ihr Akku leer ist. Ob das sich auch ukrainische Drohnenpiloten leisten können? Zum Teufel mit dem Glanz, wenn mein Leben auf dem Spiel steht.

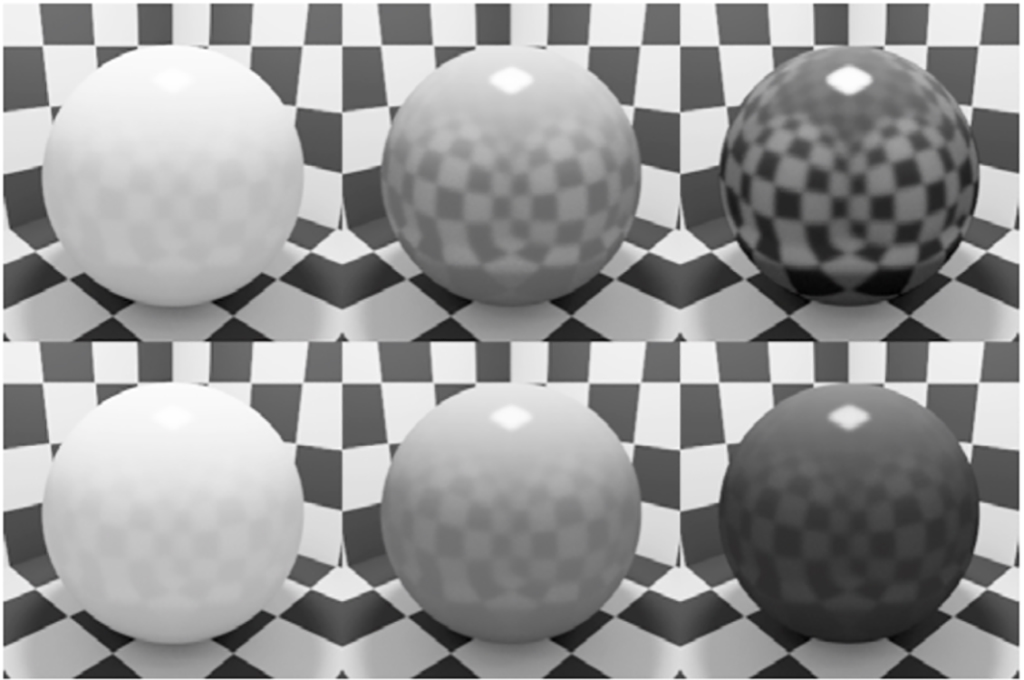

Die Probleme mit dem Glanz waren vermutlich vor meiner Geburt schon bekannt gewesen. Ich habe Farbe studiert bei einer der wenigen Koryphäen, denen es gelungen ist, ein Farbsystem aufzustellen (Anm.: Es war nicht Goethe). Sein wichtigstes Werk im Bereich der Farbsystematik ist das DIN-Farbsystem DIN 6164 (auch bekannt als DIN-Farbenkarte oder DIN-Farbenatlas). Er war Physiker und Farbmetriker und gilt als einer der führenden Vertreter der Farbwissenschaft in Deutschland im 20. Jahrhundert. Auch ihn wurmte die Frage des Glanzes, weil der Glanz nicht nur die vor dem Bildschirm stört. Er zerstört die Farben. Egal, wie ein Objekt aussieht, rot, grün oder lila, der Glanz ist fast immer weiß oder farblos.

Unter unserem Lehrer versuchten mehrere Kollegen, fast alle Ingenieure, eine Dissertation zu dem Thema zu schreiben. So entstand die Bezeichnung Glanzleiche. Die ist nicht ein optisch präpariertes Opfer in einem Tatort, sondern eine Doktorarbeit, von der man bereits zu Beginn sagte, dass die nichts wird.

Warum aber, wenn eine Arbeit von einer begnadeten Koryphäe betreut wird und von intelligenten Menschen ausgeführt? Die Gründe habe ich im Kapitel Warum sich die Forschung auf der Stelle dreht ausführlich erklärt. In diesem Kapitel geht es um Blendung, bei deren Erforschung man sich seit 120 Jahren die Zähne ausbeisst. Darin wird auch erklärt, dass Glanz eine Blendung ist. Er verhindert, dass man Dinge so sieht, wie sie sind. Weder ein Mensch noch eine Kamera können unter einer glänzenden Stelle erkennen, was darunter liegt. Und Blendung ist immer etwas, was das Erkennen erschwert. Glanz ist eine Form der Blendung, die man aber nicht so nennt. Das aus gutem Grund, denn Blendung klingt negativ, Glanz ist aber …?

Das Teuflische ist, dass der Glanz zu den vier Eigenschaften gehört, die uns das Erkennen eines physikalischen Objekts vollständig erklären: Helligkeit, Farbe, Glanz und Form. Hiervon wird nur die Form nicht von Physikern oder Technikern behandelt. Die anderen drei lernt man, wenn man Lichttechnik oder Farbenlehre studiert. Dummerweise hängen Farbe und Helligkeit eng zusammen. Und Glanz wird erheblich von der Form bestimmt. Und dies in Tateinheit mit Farbe.

Somit kann man Glanz als eine Erscheinung sehen, die uns das Sehen ermöglicht und aber auch erschwert bis unmöglich macht. Ob wir dies positiv oder negativ sehen, hängt von uns und unserer Situation ab und nicht von den physikalischen Eigenschaften. Bei manchen Dingen liegen positiv und negativ nur Millimeter auseinander, so z.B. auf schönen Frauengesichtern, wo positiv (Lipgloss) von negativ (glänzende Nasenspitze) eng beieinander liegen.

Es gibt auch Fälle, wo die Störung des Sehens den Gesamteindruck prägt und somit deren Beseitigung die Gesamterscheinung zerstört. So benutzt der Fotograf Catchlights, um den Augen Tiefe, Ausdruck und "Leben" zu verleihen. Ohne diesen Glanz wirken die Augen oft matt, leer oder „tot". Dasselbe gilt für Exponate in Galerien, die mit einer Scheibe geschützt werden müssen. Wenn diese mattiert ist, sind die Bilder tot. Portraitfotografen setzen Catchlights, wenn ein Gesicht ohne solche aufgenommen worden ist. Man kann den Effekt nachstellen, indem man Gesichter mit Glanzpunkten bearbeitet und diese entfernt.

Das Ganze hat selbst einen prägenden Effekt auf Wissenschaft und Technik. Der Glanz von Oberflächen hat einen signifikanten Einfluss auf Wissenschaft und Technik, insbesondere in den Bereichen Materialwissenschaft, Optik und Messtechnik. Möbel, Stoffe, Bekleidung, Kunstdruck und nicht zu vergessen Autos.

Wenn eine Sache so wichtig ist, müsste es von Fachleuten auf dem Gebiet nur so wimmeln. Dem ist nicht so. Die Szene wurde über mehrere Jahrzehnte von Richard S. Hunter (1906–1991) beherrscht, der schon in den 1930ern eine prägende Persönlichkeit war. Er war der Gründer des Unternehmens Hunter Associates Laboratory, Inc. (HunterLab), das weltweit Glanz- und Farbmessgeräte herstellt und damit maßgeblich zur Verbreitung seiner Messstandards beigetragen hat. Aber er war zuvor am National Bureau of Standards (NIST) tätig, wo er seine Methode entwickelte. Dazu gehörte auch ein Farbraum, der seinen Namen trägt: Hunter L, a, b Farbraum.

Hunter gelang es, die menschliche Wahrnehmung auf die Messung zu übertragen. Seine Geräte zielten darauf ab, die visuelle Wahrnehmung des menschlichen Auges (speziell im Hinblick auf kleine Farbunterschiede und Glanzeffekte) objektiv zu quantifizieren. Damit wurden HunterLab-Geräte zu einem unverzichtbaren Werkzeug, um die Produktkonsistenz über Lieferketten hinweg zu gewährleisten.

Hunter war keine Glanzleiche. Er hatte im Dezember 1927 seine Karriere als "Minor Laboratory Apprentice" (kleiner Laborlehrling) begonnen beim National Bureau of Standards (NBS), heute bekannt als NIST. Als wir zu Beginn des 21. Jahrhunderts eine vom Arbeitsminister beauftragte Studie zu Oberflächen von IT-Produkten durchführten (Einfluss von optischen Oberflächeneigenschaften von IT-Produkten auf Benutzer, BAUA Forschungsbericht Fb1066, 2006), war Hunter der Lieferant der meisten Erkenntnisse auf dem Gebiet. Und er war einer der Autoren der Studie, die Anlass für diesen Forschungsbericht war.

So konnten wir getrost schreiben:

„Maßgeblich für die Empfindung ist aber nicht die physikalische Verteilung des Lichts, sondern dessen situationsabhängige Beurteilung:

- Glanz wird absichtlich erzeugt, um das Erscheinungsbild eines Gegenstands mit Leben zu erfüllen;

- Glanz wird vermieden, um einen Gegenstand ungestört betrachten zu können.

Hunter hatte bereits 1936 zutreffend geschildert, dass es nicht nur einen Glanz gäbe, sondern viele:

- Spiegelglanz": Helligkeitsempfindung in Verbindung mit gerichteter Reflexion auf einer Fläche (Original: specular gloss)

- „Kontrastglanz": Helligkeitsempfindung infolge relativ unterschiedlicher Helligkeit von spiegelnden und diffus reflektierenden Teilen der Fläche (Original: contrast gloss)

- „Bildschärfeglanz": Empfundene Schärfe der reflektierten Objekte (je schärfer, desto störender) (Original: DOI gloss (DOI: distinctness of image))

- Haze" (ohne Übersetzung, könnte Dunst oder Eintrübung heißen): Haloartig empfundener Schleier in der Nähe der spiegelnden Stelle

- „Sheen" (ohne Übersetzung, könnte Schein oder Schimmer heißen): Glanzerscheinung auf matten Oberflächen unter streifendem Lichteinfall bzw. -ausfall

- „Absence-of-texture gloss" (ohne Übersetzung, könnte Strukturlosigkeit heißen): Empfundene Gleichmäßigkeit und Strukturlosigkeit (einer ansonsten mit Struktur versehenen Fläche).

Nicht jeder Physiker kapituliert vor dem Elend, Empfindungen messen zu müssen. Es dauert manchmal halt lange …

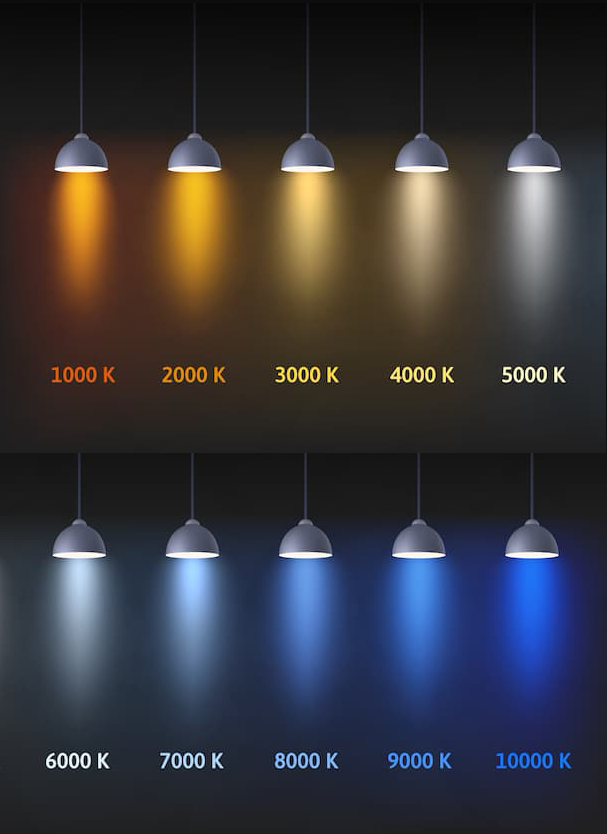

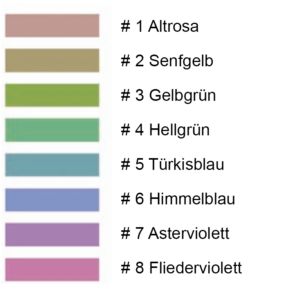

Nichts dergleichen ist wahr. Es werden diese trüben Farbmuster nach Meinung der Prüfer wiedergegeben, von denen niemand weiß, wo sie sitzen. Keine einzige gesättigte Farbe geht in die Prüfung ein. Zu guter Letzt sollen die Originale der gezeigten Farbmuster unauffindbar sein. Wenn Sie also demnächst im Baumarkt eine Lampe kaufen, sollten Sie wissen, was die Angabe CRI bzw. Ra bedeutet bzw. nicht bedeutet.

Nichts dergleichen ist wahr. Es werden diese trüben Farbmuster nach Meinung der Prüfer wiedergegeben, von denen niemand weiß, wo sie sitzen. Keine einzige gesättigte Farbe geht in die Prüfung ein. Zu guter Letzt sollen die Originale der gezeigten Farbmuster unauffindbar sein. Wenn Sie also demnächst im Baumarkt eine Lampe kaufen, sollten Sie wissen, was die Angabe CRI bzw. Ra bedeutet bzw. nicht bedeutet.

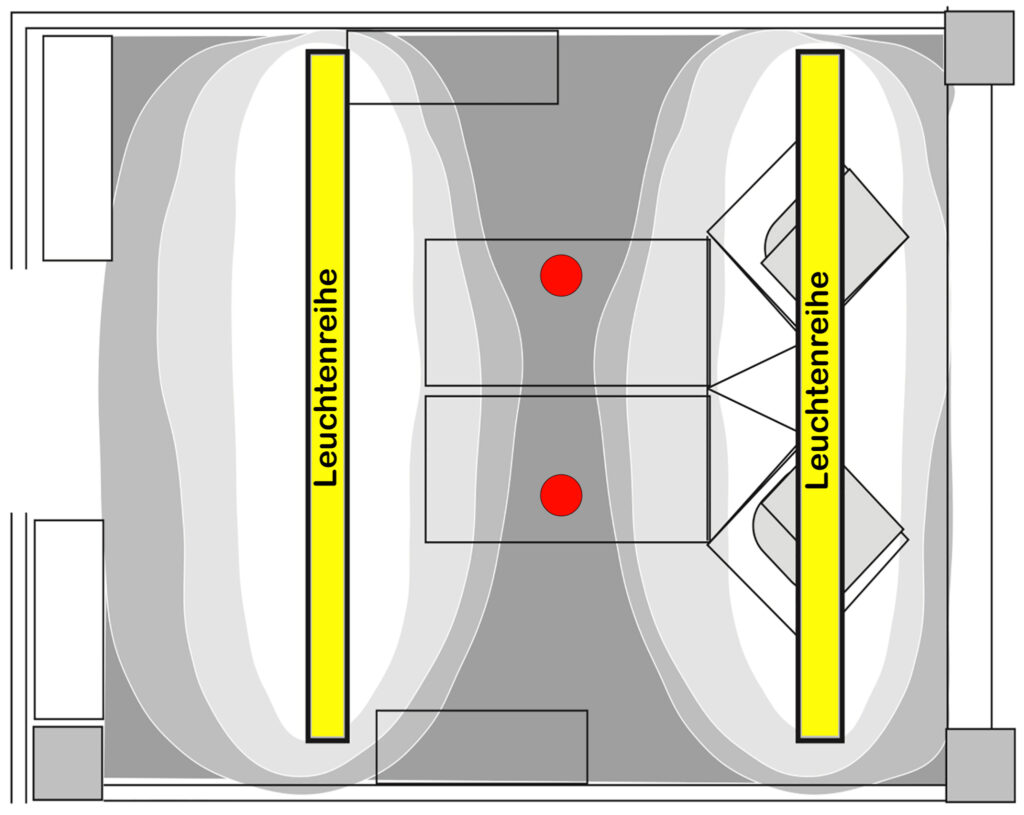

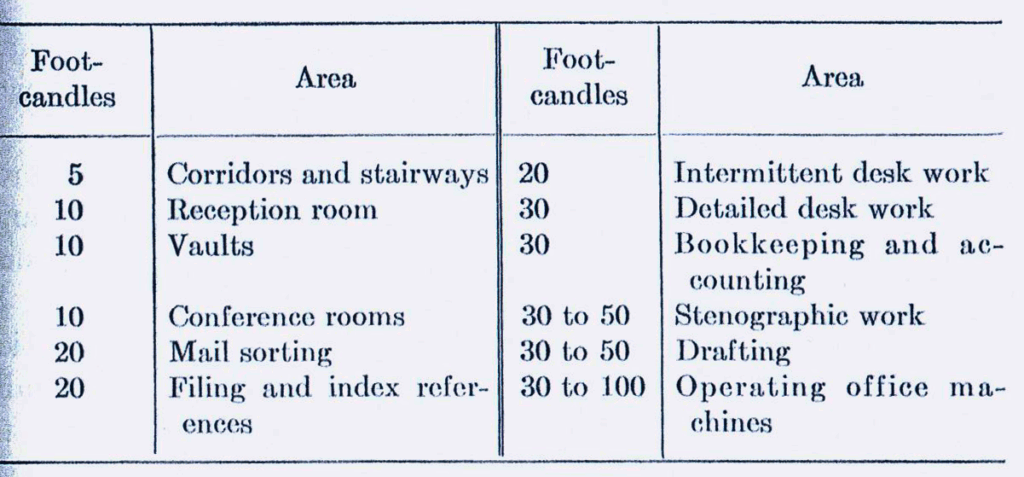

Der erste der Missetäter ist das liebe Geld. Dessen Bedeutung erklärte mir ein Leuchtenentwickler, als ich ihm (und seinesgleichen) vorwarf, Lichtteppiche zu planen. Er seufzte und sagte: “Wir wären froh, wenn die Bauherren Licht wie Teppiche behandelten. Mit einem festen Budget und bereits früh in der Planung.“ Und er erklärte weiter, dass bei der Planung eines Bürohauses der Teppich recht oben anstünde und etwa mit dem vierfachen Wert pro Quadratmeter wie Licht verplant würde. So falsch lag er damit nicht. Man kann zwar keine Qualität erwarten, wenn man sinnlos Geld ausgibt. Aber von selbst entsteht auch keine Qualität.

Der erste der Missetäter ist das liebe Geld. Dessen Bedeutung erklärte mir ein Leuchtenentwickler, als ich ihm (und seinesgleichen) vorwarf, Lichtteppiche zu planen. Er seufzte und sagte: “Wir wären froh, wenn die Bauherren Licht wie Teppiche behandelten. Mit einem festen Budget und bereits früh in der Planung.“ Und er erklärte weiter, dass bei der Planung eines Bürohauses der Teppich recht oben anstünde und etwa mit dem vierfachen Wert pro Quadratmeter wie Licht verplant würde. So falsch lag er damit nicht. Man kann zwar keine Qualität erwarten, wenn man sinnlos Geld ausgibt. Aber von selbst entsteht auch keine Qualität.

Über das Phoebus-Kartell wie über die geplante Obsoleszenz kursieren unzählige Legenden oder Gerüchte. Ich habe versucht, den wahren Kern verständlich zu machen, damit sich jeder seine Meinung bilden kann. Dazu schrieb ich in

Über das Phoebus-Kartell wie über die geplante Obsoleszenz kursieren unzählige Legenden oder Gerüchte. Ich habe versucht, den wahren Kern verständlich zu machen, damit sich jeder seine Meinung bilden kann. Dazu schrieb ich in